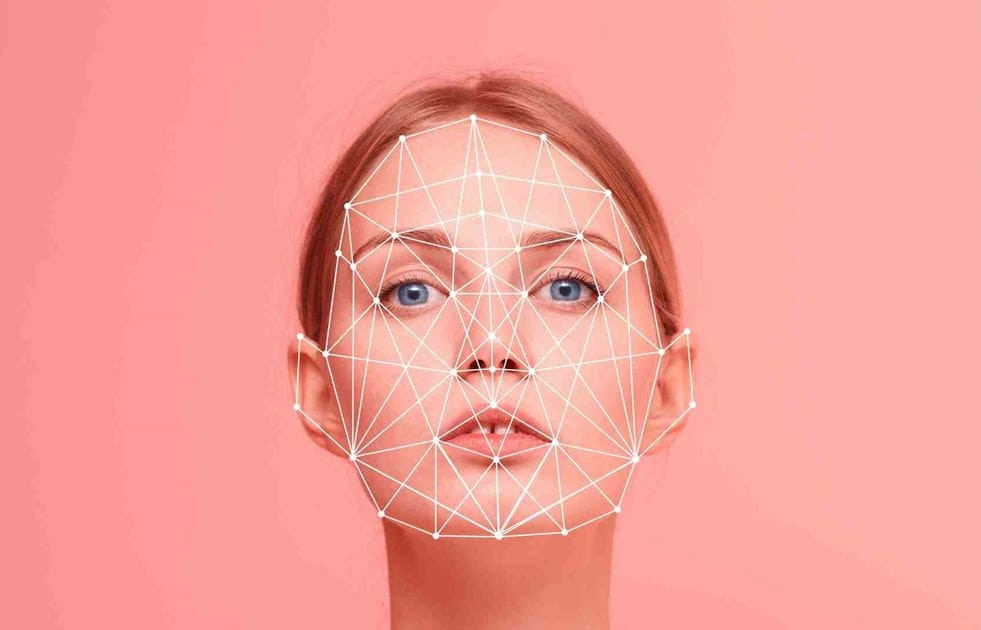

Deepfake est un terme créé par la combinaison de « Deep Learning » et de « Fake ». En termes simples, il s'agit d'une technologie permettant de simuler et de créer de faux contenus audio, image ou même vidéo .

Depuis le développement fulgurant de l'intelligence artificielle (IA) , le problème des deepfakes est devenu de plus en plus répandu, provoquant des vagues de désinformation dans la presse. Par conséquent, l'authentification proactive de l'origine des images et des vidéos est un enjeu urgent pour les plus grands fabricants mondiaux d'appareils photo.

Sony, Canon et Nikon devraient lancer des appareils photo numériques prenant en charge les signatures numériques directement sur leurs appareils photo hybrides (ou reflex numériques). L'intégration de ces signatures numériques sur les appareils photo est une mesure extrêmement importante, permettant de prouver l'origine et l'intégrité des images.

Ces signatures numériques incluent des informations sur la date, l'heure, le lieu et le photographe, et sont infalsifiables. Ceci est particulièrement important pour les photojournalistes et autres professionnels dont le travail nécessite une authentification.

Trois géants de l'industrie de l'appareil photo se sont mis d'accord sur une norme mondiale pour les signatures numériques, compatible avec l'outil de vérification en ligne Verify. Lancé par une coalition d'agences de presse internationales, d'entreprises technologiques et de fabricants d'appareils photo, cet outil permettra de vérifier gratuitement l'authenticité de toute image. Si des images sont créées ou modifiées à l'aide de l'IA, Verify les signalera comme « Aucune vérification de contenu ».

L’importance des technologies anti-deepfakes découle de l’augmentation rapide des deepfakes de personnalités célèbres telles que l’ancien président américain Donald Trump et le Premier ministre japonais Fumio Kishida.

De plus, des chercheurs de l’Université Tsinghua en Chine ont développé un nouveau modèle d’IA générative capable de générer environ 700 000 images par jour.

Outre les fabricants d'appareils photo, d'autres entreprises technologiques se joignent à la lutte contre les deepfakes. Google a lancé un outil permettant d'apposer un filigrane numérique sur les images générées par l'IA, tandis qu'Intel a développé une technologie qui analyse les variations de teint sur les photos pour en déterminer l'authenticité. Hitachi travaille également sur une technologie visant à prévenir la fraude à l'identité en ligne.

La nouvelle technologie devrait être disponible début 2024. Sony prévoit de promouvoir la technologie auprès des médias et a déjà effectué des essais sur le terrain en octobre 2023. Canon collabore avec Thomson Reuters et le Starling Data Preservation Lab (un institut de recherche fondé par l'Université de Stanford et l'Université de Californie du Sud) pour affiner davantage la technologie.

Les fabricants d’appareils photo espèrent que cette nouvelle technologie contribuera à restaurer la confiance du public dans les images, qui à leur tour façonnent notre perception du monde.

(selon OL)

Payé 5 000 $ à Facebook pour diffuser une vidéo d'arnaque à l'investissement deepfake

De nouveaux logiciels malveillants prennent le contrôle des smartphones, les vidéos deepfake deviennent de plus en plus sophistiquées

Les vidéos Deepfake deviennent de plus en plus sophistiquées et réalistes

Que faire pour éviter de tomber dans le piège des appels vidéo Deepfake qui escroquent les transferts d'argent ?

Les deepfakes sont exploités pour mettre les visages des victimes dans des vidéos pornographiques

Source

Comment (0)