ด้วยเพียงอีเมลที่ดูเหมือนจะไม่เป็นอันตราย ผู้ช่วย Microsoft Copilot AI ก็สามารถเปิดเผยข้อมูลที่เป็นความลับได้โดยอัตโนมัติโดยที่ผู้ใช้ไม่ต้องดำเนินการใดๆ

บริษัทด้านความปลอดภัยทางไซเบอร์อย่าง Aim Security เปิดเผยการค้นพบช่องโหว่ด้านความปลอดภัยที่ร้ายแรงใน Microsoft 365 Copilot ซึ่งเป็นโปรแกรมผู้ช่วย AI ที่ติดตั้งอยู่ในชุดโปรแกรมสำนักงาน เช่น Word, Excel, Outlook, PowerPoint และ Teams การค้นพบดังกล่าวทำให้เกิดความกังวลเกี่ยวกับการโจมตีตัวแทน AI

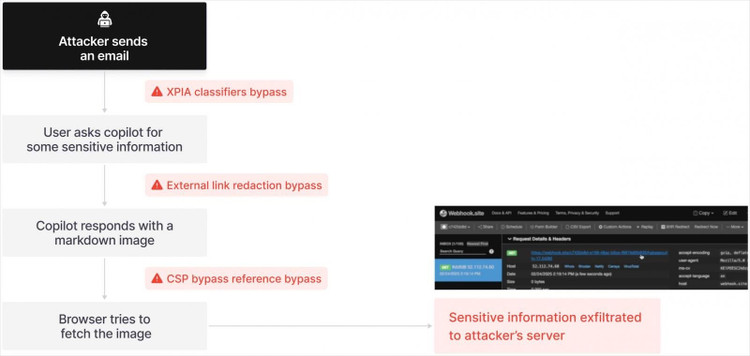

แฮกเกอร์เพียงแค่ส่งอีเมลที่มีลิงก์ไปให้ผู้ใช้ จากนั้น Copilot จะดำเนินการเองโดยที่ผู้ใช้ไม่จำเป็นต้องเปิดอีเมล

ช่องโหว่ดังกล่าวซึ่ง Aim Security เรียกว่า EchoLeak ช่วยให้ผู้โจมตีสามารถเข้าถึงข้อมูลสำคัญได้โดยไม่ต้องดำเนินการใดๆ จากผู้ใช้ ถือเป็นการโจมตีแบบ “ไม่ต้องคลิก” ครั้งแรกที่ทราบต่อตัวแทน AI ซึ่งเป็นระบบที่ใช้โมเดลภาษาขนาดใหญ่ (LLM) เพื่อดำเนินการงานโดยอัตโนมัติ

ครั้งแรกที่ AI ถูกโจมตี

ในกรณีของ Microsoft Copilot ผู้โจมตีจะส่งอีเมลที่มีลิงก์ที่ซ่อนอยู่ไปยังผู้ใช้ เนื่องจาก Copilot สแกนอีเมลโดยอัตโนมัติในเบื้องหลัง จึงอ่านและดำเนินการคำสั่งเหล่านี้โดยไม่ต้องให้ผู้รับโต้ตอบด้วย ด้วยเหตุนี้ AI จึงสามารถถูกควบคุมเพื่อเข้าถึงและขโมยเอกสาร สเปรดชีต และข้อความภายใน และส่งต่อข้อมูลกลับไปยังแฮกเกอร์ได้

“เราขอขอบคุณ Aim Security ที่ระบุและรายงานปัญหาอย่างมีความรับผิดชอบ เพื่อที่เราจะได้แก้ไขปัญหาได้ก่อนที่ลูกค้าจะได้รับผลกระทบ การอัปเดตผลิตภัณฑ์ได้รับการปรับใช้แล้ว และผู้ใช้ไม่จำเป็นต้องดำเนินการใดๆ” โฆษกของ Microsoft ยืนยันกับ Fortune

อย่างไรก็ตาม ตามที่ Aim Security ระบุ ปัญหาอยู่ลึกลงไปในการออกแบบพื้นฐานของเอเจนต์ AI Adir Gruss ผู้ก่อตั้งร่วมและ CTO ของ Aim Security กล่าวว่าช่องโหว่ EchoLeak เป็นสัญญาณว่าระบบ AI ในปัจจุบันกำลังทำผิดพลาดด้านความปลอดภัยเหมือนในอดีต

“เราพบช่องโหว่หลายจุดที่ทำให้ผู้โจมตีสามารถทำการโจมตีแบบ Zero Click บนโทรศัพท์ได้ แต่คราวนี้เป็นการโจมตีระบบ AI” Gruss กล่าว เขาบอกว่าทีมงานใช้เวลาประมาณสามเดือนในการวิเคราะห์และย้อนวิศวกรรม Microsoft Copilot เพื่อพิจารณาว่าจะสามารถจัดการ AI ได้อย่างไร

แม้ว่า Microsoft จะตอบกลับและติดตั้งแพตช์แล้ว แต่ Gruss กล่าวว่าการแก้ไขที่กินเวลานานถึง 5 เดือนนั้น "ถือว่านานมากเมื่อเทียบกับความรุนแรงของปัญหา" เขาอธิบายว่าสาเหตุส่วนหนึ่งเป็นเพราะแนวคิดช่องโหว่ยังใหม่ และทีมวิศวกรของ Microsoft ใช้เวลาในการระบุและดำเนินการ

ข้อบกพร่องด้านการออกแบบในอดีตปรากฏขึ้นอีกครั้ง คุกคามอุตสาหกรรมเทคโนโลยีทั้งหมด

ตามที่ Gruss กล่าว EchoLeak ไม่เพียงแต่ส่งผลต่อ Copilot เท่านั้น แต่ยังสามารถนำไปใช้กับแพลตฟอร์มที่คล้ายคลึงกัน เช่น Agentforce (Salesforce) หรือโปรโตคอล MCP ของ Anthropic ได้อีกด้วย

“ถ้าฉันเป็นผู้นำบริษัทที่ใช้เอเจนต์ AI ฉันคงกลัวมาก นี่เป็นข้อบกพร่องด้านการออกแบบที่สร้างความเสียหายให้กับอุตสาหกรรมเทคโนโลยีมาหลายทศวรรษ และตอนนี้มันกลับมาพร้อมกับ AI” Gruss กล่าว

สาเหตุหลักของปัญหานี้คือตัวแทน AI ในปัจจุบันไม่สามารถแยกแยะระหว่างข้อมูลที่เชื่อถือได้และไม่น่าเชื่อถือได้ Gruss เชื่อว่าวิธีแก้ปัญหาในระยะยาวคือการออกแบบวิธีการสร้างตัวแทน AI ใหม่ทั้งหมด โดยให้มีความสามารถในการแยกแยะระหว่างข้อมูลที่ถูกต้องและข้อมูลที่เป็นอันตรายได้อย่างชัดเจน

ปัจจุบัน Aim Security กำลังจัดเตรียมมาตรการบรรเทาปัญหาชั่วคราวสำหรับลูกค้าบางรายที่ใช้เอเจนต์ AI อย่างไรก็ตาม นี่เป็นเพียงการแก้ไขปัญหาชั่วคราวเท่านั้น และการออกแบบระบบใหม่จะช่วยให้มั่นใจได้ว่าข้อมูลของผู้ใช้จะได้รับความปลอดภัย

“บริษัท Fortune 500 ทุกแห่งที่ฉันรู้จักต่างก็กลัวที่จะนำเอเจนต์ AI ไปใช้ในการผลิต พวกเขาอาจจะกำลังทดลองอยู่ แต่ช่องโหว่เช่นนี้ทำให้พวกเขาต้องทำงานตลอดเวลาและทำให้การสร้างสรรค์นวัตกรรมล่าช้าลง” CTO ของ Aim Security กล่าว

ที่มา: https://khoahocdoisong.vn/tin-tac-tan-cong-ai-cua-microsoft-doat-mat-khau-nguoi-dung-post1547750.html

![[ภาพ] นายกรัฐมนตรี Pham Minh Chinh ต้อนรับผู้นำบริษัทสวีเดนหลายแห่ง](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/6/14/4437981cf1264434a949b4772f9432b6)

การแสดงความคิดเห็น (0)