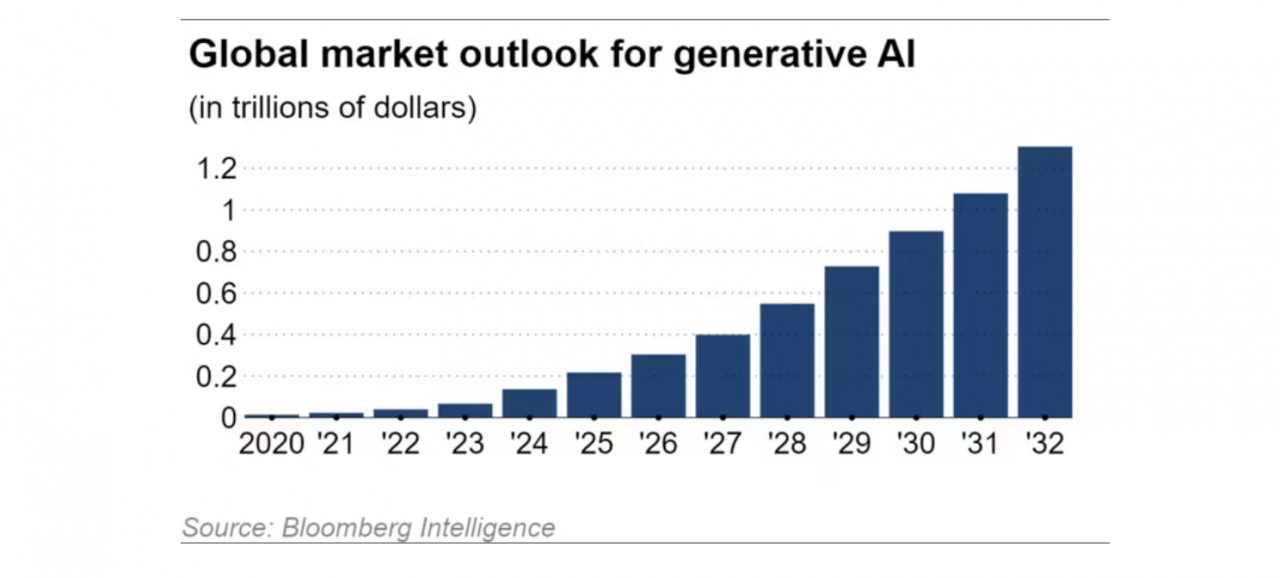

Der globale Markt für synthetische KI wächst nach Schätzungen von Bloomberg Intelligence jährlich um 42 % und dürfte bis 2032 ein Volumen von 1,3 Billionen US-Dollar erreichen, also etwa das 32-fache des Volumens von 40 Milliarden US-Dollar im Jahr 2022.

Vorreiter sind US-amerikanische Technologieunternehmen wie OpenAI, Google und Amazon – Technologiegiganten mit viel Geld und Talent.

Trotz intensiver Konkurrenz habe sich VinGroup für die Entwicklung einer eigenen Version entschieden und dabei vietnamesische Daten verwendet, um eine KI mit höherer Genauigkeit als die ausländischer Konkurrenz zu schaffen, sagte Vu Ha Van, Mathematikprofessor an der Yale University und wissenschaftlicher Leiter von VBD.

Bisher wurden generative KI-Programme hauptsächlich mit englischen Daten trainiert. Das bedeutet, dass es relativ wenige Daten aus Vietnam gibt, was die Genauigkeit dieser Programme in Bezug auf die lokale Kultur, Geschichte und Gesetze verringert.

Das große Sprachmodell (LLM) von ViGPT soll aus 1,6 Milliarden Parametern bestehen, einige Prozent der Größe von GPT-4 von OpenAI.

Mehr Parameter bedeuten normalerweise eine höhere Intelligenz. Laut der allgemeinen KI-Bewertung, die speziell auf den vietnamesischen Markt zugeschnitten ist, übertraf ViGPT jedoch viele ausländische Konkurrenten und erreichte den zweithöchsten Wert nach ChatGPT.

Die VinFast Group wird KI-Technologie bei der Produktion von Elektrofahrzeugen einsetzen. Fahrer können das Fahrzeug über vietnamesische Sprachbefehle steuern. Die Gruppe plant außerdem, KI in den Bereichen Finanzen, Versicherungen und Logistik einzusetzen.

Das KI-Entwicklungsrennen in Asien

Schätzungsweise sprechen nur etwa 5 % der Weltbevölkerung Englisch als Muttersprache. Das bedeutet, dass ein enormer potenzieller Bedarf an KI für Nicht-Muttersprachler besteht.

In Japan entwickeln Unternehmen KI, die Japanisch generiert. Im August startete der Elektronikriese NEC einen Dienst mit einem Cotomi-LLM. Der Telekommunikationskonzern NTT wird im März einen Dienst auf Basis eines anderen LLM, Tsuzumi, einführen. Auch der japanische Mobilfunkanbieter SoftBank entwickelt ein eigenes LLM.

„Das Verständnis japanischer Geschäftspraktiken verschafft uns Vorteile in Bezug auf die Benutzerfreundlichkeit, beispielsweise beim Beantworten von E-Mails und beim Ausführen von Callcenter-Arbeiten auf natürlichere Weise“, sagte Junichi Miyakawa, Präsident von SoftBank.

Der Wettlauf um die Entwicklung eigener KI wird durch die Risiken einer übermäßigen Abhängigkeit von den USA befeuert, insbesondere im Hinblick auf die internationale Wettbewerbsfähigkeit und die nationale Sicherheit. Zudem bestehen Bedenken, dass der Einsatz von KI-Programmen aus anderen Ländern zu Datenlecks führen und sensible Informationen gefährden könnte.

Professor Van sagte, dass die Entwicklung neuer Technologien nicht ausländischen Unternehmen überlassen werden sollte, da immer mehr Studenten KI zum Lernen nutzen, was bedeutet, dass Innovationen einen enormen Einfluss auf die jüngere Generation haben.

In China, das technologisch mit den USA konkurriert, entwickeln Baidu, Tencent Holdings und die Alibaba Group Holding innovative KI. Baidus Ernie Bot hatte Ende letzten Jahres über 100 Millionen Nutzer.

„Das generative Großsprachenmodell, das wir jetzt entwickeln, wird besser für die chinesische Sprache und den chinesischen Markt geeignet sein“, sagte Robin Li, Vorsitzender und CEO von Baidu.

Im vergangenen August stellte der südkoreanische Internetdienstanbieter Naver HyperClova X vor, eine synthetische KI, die speziell auf die koreanische Sprache zugeschnitten ist. Das Programm wird in die Suchmaschine und die Online-Shopping-Plattform des Unternehmens integriert, um Nutzern zu helfen, die gewünschten Ergebnisse effizienter zu finden.

Laut Naver ist seine koreanische Datenbank 6.500 Mal größer als die koreanische Datenbank von ChatGPT, was zu einem natürlicher lesbaren Text und einer reibungsloseren Spracherkennung führt.

Singapur kündigte im vergangenen Monat Pläne zur Entwicklung von LLMs an, die auf Indonesisch, Malaysisch und Thailändisch zugeschnitten sind. Solche Initiativen stehen jedoch vor Herausforderungen, wie dem Mangel an Daten, die für das Training in weniger verbreiteten Sprachen benötigt werden, und der Frage der Rentabilität der Entwicklung solcher Modelle.

[Anzeige_2]

Quelle

Kommentar (0)