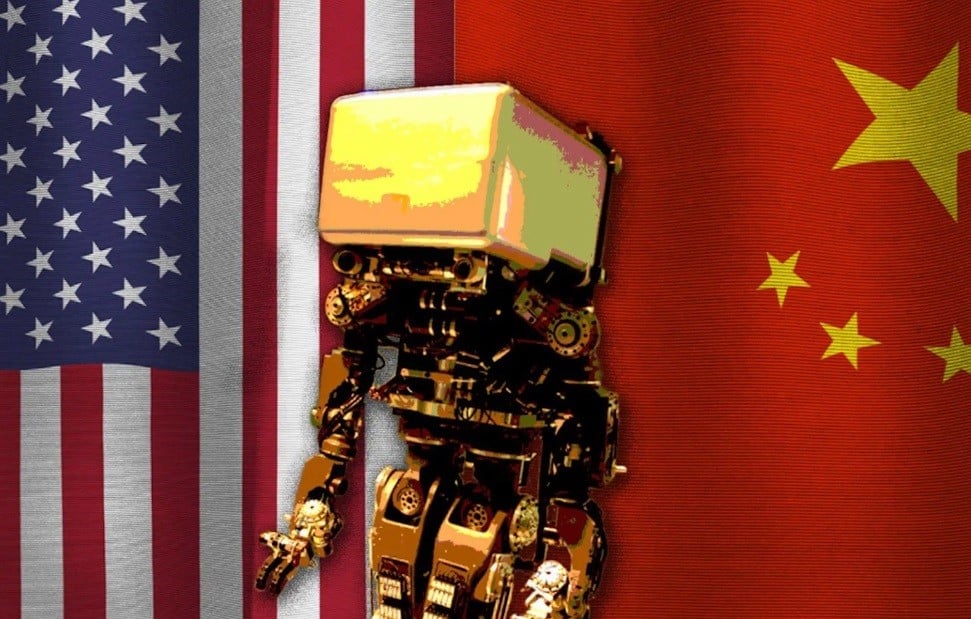

Наблюдатели по-разному оценивают соглашение между США и Китаем относительно применения искусственного интеллекта (ИИ) в армии .

|

| Наблюдатели разделились во мнениях относительно соглашения между США и Китаем о применении искусственного интеллекта (ИИ) в военных целях. (Источник: Asia Times) |

После встречи президента США Джо Байдена и председателя КНР Си Цзиньпина 16 ноября (по вьетнамскому времени) в кулуарах саммита Азиатско- Тихоокеанского экономического сотрудничества (АТЭС) 2023 года в Сан-Франциско, штат Калифорния (США), две страны достигли многих важных результатов, включая соглашение о возобновлении военных коммуникаций, сотрудничестве в борьбе с наркотиками (особенно фентанилом) и обсуждении рисков и мер по управлению безопасностью искусственного интеллекта (ИИ).

«Мы соберём экспертов для обсуждения рисков и вопросов безопасности, связанных с использованием искусственного интеллекта», — заявил президент США Джо Байден на пресс-конференции после американо-китайского саммита. «Когда я работаю с лидерами по всему миру , все они говорят о влиянии искусственного интеллекта. Это конкретные шаги в правильном направлении, позволяющие определить, что необходимо, что опасно, а что приемлемо».

Администрация Байдена недавно опубликовала свой первый указ об искусственном интеллекте и активно продвигает мировые стандарты использования ИИ в армии. Китай также продемонстрировал готовность к диалогу, в частности, запретив использование ИИ в системах управления и контроля (C2) своего ядерного арсенала.

Хотя в заявлении президента Байдена и Белого дома не говорилось прямо о связи между ИИ и ядерным оружием, эксперты перед встречей заявили, что это важная тема для обсуждения между США и Китаем.

«Китай заинтересован в участии в обсуждении по установлению правил и норм для ИИ, и мы должны приветствовать это», — заявила Бонни Глейзер, руководитель Индо-Тихоокеанской программы Германского фонда Маршалла.

Проблема не только в отношениях между США и Китаем.

После того, как SCMP со ссылкой на анонимные источники заявила: «Президент США Джо Байден и председатель КНР Си Цзиньпин готовы взять на себя обязательство запретить использование ИИ в автономных системах оружия, включая использование беспилотных летательных аппаратов (БПЛА), а также управление и развертывание ядерных боеголовок», общественное мнение усилило надежды на совместное заявление США и Китая по этому вопросу.

Однако нет никаких признаков того, что Китай или США согласятся на обязательные ограничения своей свободы действий в области ИИ.

Это проблема не только США и Китая. С февраля 2023 года, после того как США опубликовали «Политическое заявление об ответственном использовании искусственного интеллекта в военных целях», страна работает над формированием глобального консенсуса по разработке и использованию военного ИИ, который распространяется не только на автономное оружие, такое как БПЛА, но и на приложения, использующие алгоритмы для анализа разведданных или логистического программного обеспечения.

Цель США — противостоять призывам многих активистов движения за мир и неприсоединившихся стран ввести обязательный запрет на «роботов-убийц», тем самым создав для США и их союзников возможность «ответственно» использовать ИИ — технологию, которая быстро развивается и может широко применяться во многих областях.

Также в феврале 2023 года Пентагон провел масштабный пересмотр своей политики в отношении военного ИИ и автономных систем. Посол Бонни Дениз Дженкинс, заместитель госсекретаря США по контролю над вооружениями и международной безопасности, представила «Политическое заявление об ответственном использовании искусственного интеллекта и автономности в военных делах» на саммите «Ответственный искусственный интеллект в военных целях» (REAIM) в Гааге в феврале 2023 года.

Целью настоящего Заявления является изложение согласованного на международном уровне подхода США к тому, как военные могут ответственно включать ИИ и автономность в военные операции.

С тех пор многие другие страны выразили свою поддержку США, включая ключевых союзников, таких как Австралия, Великобритания, Франция, Германия и Южная Корея, а также таких стран, как Венгрия, Ливия и Турция. 14 ноября информационное агентство «Ёнхап» сообщило, что США и 45 других стран опубликовали совместное заявление, в котором подчеркнули «ответственное» использование ИИ в военных целях.

Встреча двух лидеров вызвала неоднозначную реакцию, в том числе на соглашение между США и Китаем о военном применении искусственного интеллекта. Одни считают его необходимым, другие же считают, что Вашингтон теряет своё преимущество. Кристофер Александер, директор по анализу Pioneer Development Group, поставил под сомнение необходимость этого соглашения, отметив, что США потеряют своё нынешнее стратегическое преимущество.

«Это плохое решение. Китай отстаёт от США в области технологий искусственного интеллекта. Поэтому заключение сделки означает, что администрация Байдена теряет своё стратегическое преимущество», — заявил г-н Александер.

Комментатор Сэмюэл Мангольд-Ленетт также усомнился в том, что Китай будет соблюдать такое соглашение, указав на несоблюдение им Парижского соглашения по климату. Между тем, Фил Сигел, основатель Центра CAPTRS, заявил, что такое соглашение необходимо, хотя, по его мнению, в него должны быть включены и такие крупные страны, как Россия.

Чего хочет Пекин?

Неудивительно, что Китай пока не принял подход США. «Дипломатическая стратегия страны по-прежнему сосредоточена на конкуренции и противодействии усилиям США по установлению будущих стандартов управления ИИ, особенно в военной сфере», — заявил эксперт по ИИ Тун Чжао.

Кроме того, по словам эксперта, при управлении новыми военными технологиями Китай зачастую выступает против одобрения «ответственных» мероприятий, считая это «политической концепцией, лишенной ясности и объективности».

«Очевидно, мы хотели бы, чтобы США чётко и решительно поддержали создание правовых инструментов, ограничивающих автономные системы оружия. Мы считаем, что политических указаний и заявлений недостаточно, как и большинства стран», — заявила Кэтрин Коннолли, исследователь из Stop Killer Robots, международной группы неправительственных организаций, которая стремится запретить смертоносное автономное оружие.

В последнее время Группа правительственных экспертов (ГПЭ) по автономному оружию провела в Женеве несколько обсуждений по смежным вопросам с целью предложить разработку и применение свода законов, регулирующих этот тип оружия, аналогичного ранее применяемому к химическому оружию. Однако эти усилия пока не увенчались успехом из-за отсутствия консенсуса между странами.

Итак, движение против оружия ИИ предложило проект резолюции Генеральной Ассамблее ООН в Нью-Йорке. Вместо призыва к немедленному запрету, который, безусловно, провалится, в резолюции, предложенной Австрией, просто «просится к Генеральному секретарю ООН запросить мнения государств-членов».

В результате 1 ноября 2023 года Генеральная Ассамблея Организации Объединённых Наций приняла резолюцию L.56, первую резолюцию по автономным системам оружия, в которой подчёркивается «настоятельная необходимость решения международным сообществом проблем и проблем, связанных с автономными системами оружия». Представители бизнеса, учёные и неправительственные организации представили доклады и официально внесли этот вопрос в повестку дня ООН.

Резолюция L.56 была принята 164 голосами «за», 5 — «против» и 8 воздержавшихся. Из них Китай воздержался.

Исследователь Кэтрин Коннолли заявила, что тот факт, что США и большинство стран проголосовали «за», является положительным знаком, но, к сожалению, Китай воздержался.

Однако Китай не согласен с некоторыми аспектами резолюции, касающимися её характеристик и определений. Фактически, Пекин склонен использовать единое, узкое определение «автономного оружия», включающее только системы, которые после развёртывания «не находятся под контролем человека и не могут быть остановлены». Это позволяет Китаю заявлять о поддержке запрета, хотя на самом деле он исключает подавляющее большинство автономных систем, которые в настоящее время исследуются и разрабатываются многими военными.

Резолюция Генеральной Ассамблеи ООН не является обязательной, но если США смогут привлечь другие страны, такие как Великобритания, Франция и, возможно, ЕС, к комплексным усилиям, может быть достигнут прогресс в установлении правил в этой области, заявил ученый Джеймс Льюис.

До сих пор международное обсуждение необязательной «политической декларации» фактически вынудило Вашингтон приуменьшить свои амбиции, удалив абзац, касающийся предоставления ИИ возможности управлять ядерным оружием.

Источник

Комментарий (0)