Selon The Hacker News , Wiz Research - une startup de sécurité cloud - a récemment découvert une fuite de données dans le référentiel GitHub de Microsoft AI, qui aurait été accidentellement exposée lors de la publication d'un groupe de données de formation open source.

Les données divulguées comprennent une sauvegarde des postes de travail de deux anciens employés de Microsoft avec des clés secrètes, des mots de passe et plus de 30 000 messages internes de l'application Teams.

Le dépôt, appelé « robust-models-transfer », est désormais inaccessible. Avant sa suppression, il contenait du code source et des modèles d'apprentissage automatique liés à un article de recherche de 2020.

Wiz a déclaré que la violation de données était due à un jeton SAS trop vulnérable, une fonctionnalité d'Azure permettant aux utilisateurs de partager des données difficiles à suivre et à révoquer. L'incident a été signalé à Microsoft le 22 juin 2023.

En conséquence, le fichier README.md du référentiel demandait aux développeurs de télécharger des modèles à partir d'une URL de stockage Azure, fournissant par inadvertance l'accès à l'ensemble du compte de stockage, exposant ainsi des données privées supplémentaires.

Outre l'accès excessif, le jeton SAS était également mal configuré, permettant un contrôle total plutôt qu'un accès en lecture seule, selon les chercheurs de Wiz. En cas d'exploitation, un attaquant pourrait non seulement visualiser, mais aussi supprimer et écraser tous les fichiers du compte de stockage.

En réponse au rapport, Microsoft a déclaré que son enquête n'avait révélé aucune preuve d'exposition des données clients, ni de risque pour d'autres services internes suite à l'incident. L'entreprise a souligné que les clients n'avaient aucune action à entreprendre et a indiqué avoir révoqué les jetons SAS et bloqué tout accès externe aux comptes de stockage.

Pour atténuer ces risques, Microsoft a étendu son service d'analyse secrète afin de détecter les jetons SAS potentiellement dotés de privilèges limités ou excessifs. Microsoft a également identifié un bug dans le système d'analyse qui signalait les URL SAS du référentiel comme des faux positifs.

Les chercheurs affirment qu'en raison du manque de sécurité et de gouvernance des jetons de compte SAS, la précaution consiste à éviter de les utiliser pour un partage externe. Les erreurs de génération de jetons peuvent être facilement contournées et exposer des données sensibles.

En juillet 2022, JUMPSEC Labs avait révélé une menace qui pourrait exploiter ces comptes pour accéder aux entreprises.

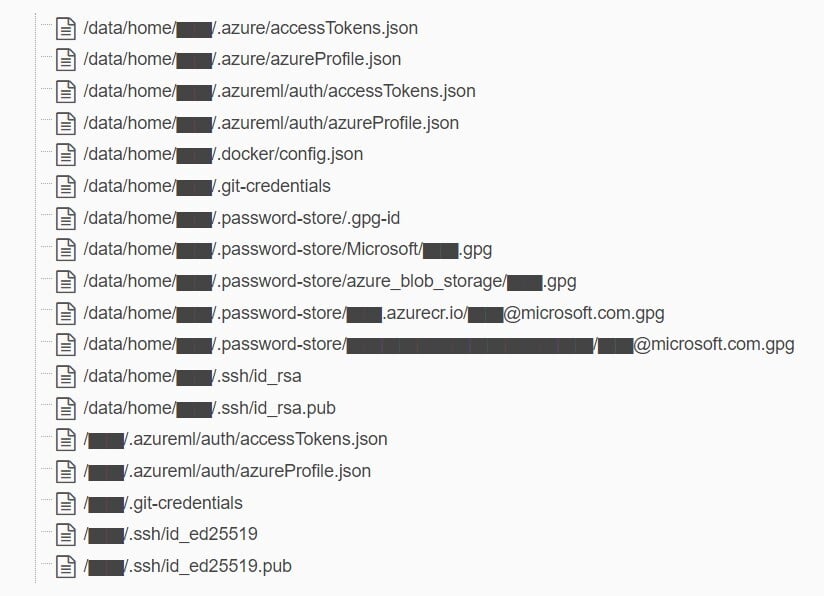

Fichiers sensibles trouvés lors d'une sauvegarde par Wiz Research

Il s'agit de la dernière faille de sécurité en date chez Microsoft. Il y a deux semaines, l'entreprise a également révélé que des pirates informatiques chinois avaient pénétré et volé des clés de sécurité. Les pirates ont piraté le compte d'un ingénieur de l'entreprise et accédé au référentiel de signatures numériques de l'utilisateur.

Ce dernier incident illustre les risques potentiels liés à l'introduction de l'IA dans les grands systèmes, déclare Ami Luttwak, directeur technique de Wiz CTO, qui affirme que l'IA offre un potentiel considérable aux entreprises technologiques. Cependant, alors que les data scientists et les ingénieurs s'empressent de mettre en œuvre de nouvelles solutions d'IA, les volumes massifs de données qu'ils traitent nécessitent des contrôles de sécurité et des mesures de protection supplémentaires.

Alors que de nombreuses équipes de développement doivent travailler avec des quantités massives de données, partager ces données avec leurs pairs ou collaborer sur des projets open source publics, les cas comme celui de Microsoft deviennent de plus en plus difficiles à suivre et à éviter.

Lien source

![[Photo] Le secrétaire général To Lam assiste au 80e anniversaire de la diplomatie vietnamienne](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/25/3dc715efdbf74937b6fe8072bac5cb30)

Comment (0)