|

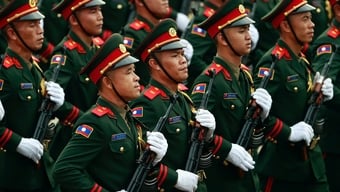

Anthropic เพิ่งอัปเดตนโยบายใหม่ ภาพ: GK Images |

เมื่อวันที่ 28 สิงหาคม Anthropic บริษัท AI ได้ประกาศปรับปรุงข้อกำหนดการใช้บริการและนโยบายความเป็นส่วนตัวของผู้ใช้ โดยผู้ใช้สามารถเลือกที่จะนำข้อมูลของตนไปใช้เพื่อปรับปรุง Claude และเสริมสร้างการป้องกันการละเมิดต่างๆ เช่น การหลอกลวงและการฉ้อโกง

ประกาศนี้จะเผยแพร่ไปยังแชทบอทตั้งแต่วันที่ 28 สิงหาคมเป็นต้นไป ผู้ใช้มีเวลาหนึ่งเดือนในการยอมรับหรือปฏิเสธข้อกำหนด นโยบายใหม่จะมีผลบังคับใช้ทันทีหลังจากการยอมรับ หลังจากวันที่ 28 กันยายน ผู้ใช้จะต้องเลือกใช้งาน Claude ต่อไป

บริษัทระบุว่าการอัปเดตนี้มีจุดมุ่งหมายเพื่อช่วยให้สามารถส่งมอบโมเดล AI ที่มีประสิทธิภาพและมีประโยชน์มากขึ้น การปรับแต่งตัวเลือกนี้ทำได้ง่าย และสามารถทำได้ทุกเมื่อในการตั้งค่าความเป็นส่วนตัว

การเปลี่ยนแปลงเหล่านี้กำลังเกิดขึ้นกับแพ็กเกจ Claude Free, Pro และ Max ซึ่งรวมถึง Claude Code ซึ่งเป็นเครื่องมือการเขียนโปรแกรมของ Anthropic บริการที่ครอบคลุมภายใต้ข้อกำหนดเชิงพาณิชย์จะไม่มีผลบังคับใช้ รวมถึง Claude for Work, Claude Gov, Claude for Education หรือการใช้งาน API รวมถึงการใช้งานผ่านบุคคลที่สาม เช่น Amazon Bedrock และ Vertex AI ของ Google Cloud

Anthropic ระบุในบล็อกโพสต์ว่า การเข้าร่วมจะช่วยให้ผู้ใช้ปรับปรุงความปลอดภัยของโมเดล เพิ่มความสามารถในการตรวจจับเนื้อหาที่เป็นอันตรายได้อย่างแม่นยำ และลดความเสี่ยงในการระบุการสนทนาที่ไม่เป็นอันตรายโดยไม่ได้ตั้งใจ นอกจากนี้ Claude เวอร์ชันในอนาคตยังจะได้รับการปรับปรุงทักษะต่างๆ เช่น การเขียนโปรแกรม การวิเคราะห์ และการใช้เหตุผล

สิ่งสำคัญคือผู้ใช้ต้องสามารถควบคุมข้อมูลของตนเองได้อย่างเต็มที่ และไม่ว่าจะอนุญาตให้แพลตฟอร์มใช้ข้อมูลดังกล่าวในหน้าต่างป๊อปอัปหรือไม่ก็ตาม บัญชีใหม่สามารถตั้งค่านี้ได้ในระหว่างขั้นตอนการลงทะเบียน

|

หน้าต่างป๊อปอัพเงื่อนไขใหม่ในแชทบอท ภาพ: Anthropic |

ระยะเวลาการเก็บรักษาข้อมูลได้เพิ่มขึ้นเป็นห้าปี ซึ่งครอบคลุมทั้งการสนทนาใหม่หรือการสนทนาต่อเนื่อง หรือเซสชันการเขียนโค้ด รวมถึงการตอบกลับจากแชทบอท ข้อมูลที่ถูกลบจะไม่ถูกนำไปใช้ในการฝึกโมเดลในอนาคต หากผู้ใช้ไม่เลือกที่จะให้ข้อมูลสำหรับการฝึก พวกเขาจะยังคงใช้นโยบายการเก็บรักษาข้อมูล 30 วันเดิมต่อไป

ในการอธิบายนโยบายนี้ Anthropic กล่าวว่าวงจรการพัฒนา AI มักกินเวลาหลายปี และการรักษาความสอดคล้องของข้อมูลตลอดกระบวนการฝึกอบรมยังช่วยให้แบบจำลองมีความสอดคล้องกัน การเก็บข้อมูลที่ยาวนานขึ้นยังช่วยพัฒนาระบบจำแนกประเภท ซึ่งเป็นระบบที่ใช้ระบุพฤติกรรมที่ไม่เหมาะสม เพื่อตรวจจับรูปแบบที่เป็นอันตราย

“เพื่อปกป้องความเป็นส่วนตัวของผู้ใช้ เราใช้เครื่องมือและกระบวนการอัตโนมัติร่วมกันเพื่อกรองหรือปกปิดข้อมูลสำคัญ เราไม่ขายข้อมูลผู้ใช้ให้กับบุคคลที่สาม” บริษัทระบุ

Anthropic มักถูกยกย่องว่าเป็นหนึ่งในผู้นำด้าน AI ที่ปลอดภัย Anthropic ได้พัฒนาระเบียบวิธีที่เรียกว่า Constitutional AI ซึ่งกำหนดหลักการและแนวทางทางจริยธรรมที่แบบจำลองต้องปฏิบัติตาม นอกจากนี้ Anthropic ยังเป็นหนึ่งในบริษัทที่ได้ลงนามในพันธสัญญา Safe AI กับ รัฐบาล สหรัฐอเมริกา สหราชอาณาจักร และกลุ่มประเทศ G7

ที่มา: https://znews.vn/cong-ty-ai-ra-han-cuoi-cho-nguoi-dung-post1580997.html

![[ภาพ] นายกรัฐมนตรีเริ่มเดินทางเข้าร่วมการประชุมสุดยอด SCO 2025 ที่ประเทศจีน](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/31/054128fff4b94a42811f22b249388d4f)

การแสดงความคิดเห็น (0)