Il est temps que chaque utilisateur devienne un « bouclier numérique », soit vigilant, alerte et responsable de chaque clic et partage.

Avantages et limites de l'IA

L'intelligence artificielle n'a jamais été aussi proche de la réalité. Quelques clics, une simple commande, permettent de créer des voix, des images et même des vidéos d'un réalisme saisissant. L'IA permet de gagner du temps, de réduire les coûts de production de contenu et d'ouvrir l'ère des médias numériques flexibles.

Cependant, la capacité à simuler de manière réaliste est devenue une arme à double tranchant. Récemment, les réseaux sociaux ont vu apparaître en permanence des vidéos créées grâce à la technologie deepfake, dans lesquelles les visages de responsables de police, des images de forces de l'ordre travaillant sur des affaires sensibles… ont été copiés, doublés et déformés pour semer l'incompréhension et diviser.

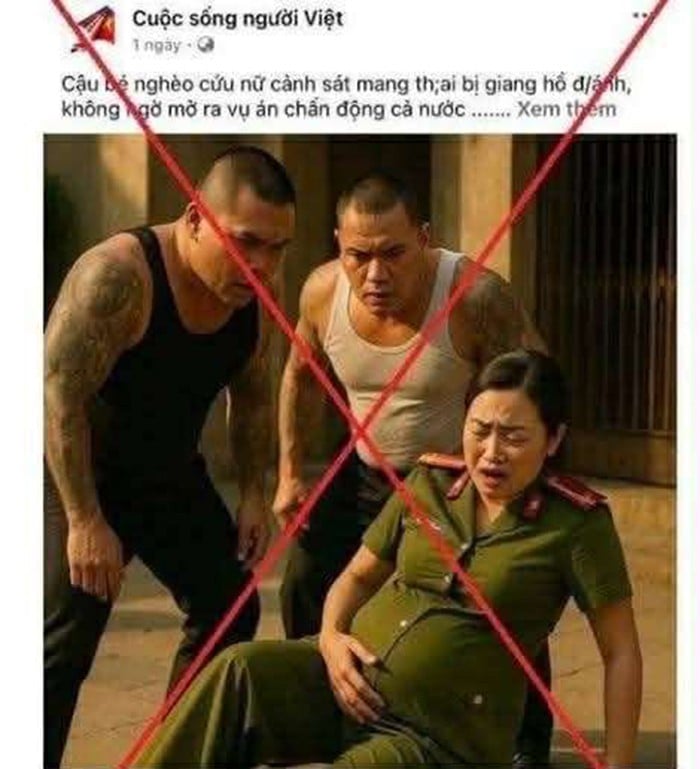

Des images mises en scène comme celle-ci apparaissent de plus en plus sur les réseaux sociaux.

Dans une vidéo circulant sur TikTok, l'image d'un agent de la circulation en service était accompagnée d'un dialogue offensant, accompagné du hashtag « amende pour le spectacle », insinuant que l'agent abusait de son pouvoir à des fins personnelles. De nombreux utilisateurs, notamment les jeunes, ont facilement cru à ce contenu, car l'image était si réaliste, la voix si proche de la bouche qu'il était extrêmement difficile de distinguer le vrai du faux.

Pour avoir simplement voulu « montrer » son talent en matière d'IA, un jeune YouTubeur de Dien Bien a dû payer le prix fort : une amende administrative et des excuses publiques. Dans l'après-midi du 24 janvier, la police provinciale de Dien Bien a annoncé que le service de cybersécurité et de prévention des crimes liés aux hautes technologies avait infligé une amende administrative de 7,5 millions de VND à Tong Van T. (né en 2001, résidant dans le district de Muong Ang) pour avoir utilisé l'IA afin de créer une fausse vidéo au contenu déformé et insulté la police de la circulation.

Plus précisément, le 7 janvier, T. a publié sur le compte YouTube « Tuyền Vlog » une vidéo de plus de trois minutes au titre choquant : « Alors que je traînais, j'ai été poursuivi par la police routière ». Dans ce clip, des images et des situations ont été mises en scène grâce à l'IA, simulant des poursuites de la police routière, avec des effets spéciaux et des commentaires diffamatoires à l'encontre des autorités.

En collaboration avec la police, T. a admis que l'intégralité du contenu de la vidéo était une contrefaçon destinée à « divertir » et à démontrer la capacité d'utiliser l'IA. Outre l'amende, les autorités ont demandé à T. de retirer la fausse vidéo susmentionnée et de présenter des excuses publiques aux forces de l'ordre sur sa chaîne YouTube personnelle.

À l'ère de l'explosion des technologies numériques , et notamment du développement rapide de l'intelligence artificielle, des forces hostiles et réactionnaires n'hésitent pas à exploiter cet outil pour créer des images et des histoires inventées de toutes pièces afin de déformer et de diffamer l'image des forces de sécurité publique vietnamiennes. La photo qui a récemment circulé sur les réseaux sociaux, montrant une femme enceinte en uniforme de police menacée par deux hommes aux allures de « gangsters », illustre parfaitement cette ruse.

La photo générée par l’IA est devenue virale sur les réseaux sociaux récemment.

À première vue, on pourrait croire qu'il s'agit d'une scène réelle, accompagnée d'un titre sensationnaliste du genre : « Un pauvre garçon sauve une policière enceinte d'un passage à tabac par des gangsters et ouvre une enquête inattendue qui choque tout le pays… ». Or, il s'agit en réalité d'une simple mise en scène, tirée peut-être d'un film ou d'un produit de divertissement, ou pire, d'une image créée par l'IA pour tromper les émotions du lecteur et l'amener à s'apitoyer sur l'authenticité des activités des forces de l'ordre.

Plus inquiétant encore, la diffusion de tels contenus porte non seulement atteinte à la réputation et à l'image des Forces populaires de sécurité publique, qui veillent jour et nuit à la sécurité et à l'ordre public, mais constitue également une forme sophistiquée de guerre psychologique. Lorsque la confiance de la population envers les autorités est érodée par de fausses images, l'objectif profond des forces hostiles, à savoir diviser le grand bloc d'unité nationale, se concrétise progressivement.

Par conséquent, chaque citoyen doit accroître sa vigilance, faire preuve d’esprit critique et de compétences pour identifier les fausses informations, et dénoncer et réfuter résolument les faux contenus, contribuant ainsi à protéger les fondements idéologiques et à maintenir la stabilité sociale contre la vague actuelle d’informations toxiques sur le cyberespace.

À Hô-Chi-Minh-Ville, une vidéo de près d'une minute est soudainement devenue virale sur les réseaux sociaux. On y voit un policier en uniforme extorquer des aveux à un contrevenant dans un bureau. Dans la vidéo, l'individu, soupçonné d'être un policier, affiche une attitude brutale, criant et réprimandant sans cesse, voire utilisant des mots grossiers, suscitant l'indignation du public.

Cependant, immédiatement après la diffusion virale de la vidéo, la police de Hô-Chi-Minh-Ville a rapidement enquêté et confirmé qu'il s'agissait d'un deepfake sophistiqué. Selon les conclusions, le visage de la vidéo a été extrait d'un enregistrement d'une réunion interne des forces de police, puis utilisé par des individus malintentionnés pour l'intégrer à une scène mise en scène, faisant croire à tort à un acte réel.

En particulier, l'audio qui l'accompagne comprend une voix menaçante et insultante qui n'est en réalité pas les vrais mots d'un officier mais une voix d'IA synthétisée, programmée et éditée pour tromper les émotions du spectateur.

Cet incident est un exemple typique de l'utilisation de la technologie deepfake pour déformer et diffamer les Forces populaires de sécurité publique, une astuce de plus en plus exploitée par les forces réactionnaires et antigouvernementales dans le cyberespace. Il convient de noter que, s'ils ne sont pas rapidement dénoncés, ces faux produits peuvent avoir de graves conséquences : ébranler la confiance des citoyens envers les forces de l'ordre, inciter à la résistance au sein de la communauté et créer les conditions propices à la propagation de faux arguments. Ceci constitue un avertissement clair quant à l'urgence d'améliorer la capacité des médias à réfuter, détecter et combattre les fausses informations, et appelle chaque citoyen à la vigilance et à ne pas se précipiter pour partager ou commenter des contenus non vérifiés provenant de sources officielles.

Dans une autre affaire récente, liée au traitement des infractions dans un centre de contrôle technique du Sud, des individus hostiles ont diffusé une fausse vidéo d'un chef de la police provinciale prenant la défense des agents fautifs. Cette vidéo a été diffusée sur Telegram et les réseaux sociaux sous le titre « soutenu par des forces puissantes », mais il s'agissait en réalité d'un produit de l'IA, n'apparaissant dans aucune conférence de presse ni document officiel.

Une tendance dangereuse se propage discrètement dans le cyberespace : des individus malintentionnés utilisent l'IA pour créer de fausses vidéos à des fins de fraude et de chantage. Récemment, de nombreuses personnes ont été victimes de montages de leurs images, notamment celles de personnalités prestigieuses comme des avocats, des médecins et des hommes d'affaires, dans des vidéos publicitaires visant à « récupérer l'argent escroqué en ligne ».

Dans ces clips, l'IA imite la voix et le visage de l'avocat, inspirant ainsi confiance aux spectateurs, leur permettant ainsi de fournir facilement des informations personnelles ou de transférer de l'argent à l'escroc. Plus dangereux encore, certains individus utilisent également la technologie deepfake pour insérer le visage de la victime dans des vidéos à caractère sexuel, puis les envoyer à leur conjoint ou à leurs collègues dans le but de les menacer et de les contraindre à transférer de l'argent pour « garder le secret ».

Un incident choquant s'est produit en mars 2025 : à Hanoï, une victime a été sommée de transférer des dizaines de millions de dongs après avoir reçu une fausse vidéo pornographique à son image. Parallèlement, à Hô-Chi-Minh-Ville, une autre personne a été victime de chantage, exigeant jusqu'à 2 milliards de dongs pour empêcher la diffusion de la vidéo sensible. Le ministère de la Sécurité publique est intervenu, identifiant de nombreux groupes criminels transnationaux, principalement originaires de Chine et d'Asie du Sud-Est, derrière ces lignes, qui utilisent des cartes SIM, des portefeuilles électroniques et des plateformes de réseaux sociaux frauduleux pour dissimuler leur identité.

Il ne s'agit plus d'une escroquerie à petite échelle, mais d'une forme de « guerre psychologique high-tech », exploitant la peur de l'honneur et des relations sociales pour faire pression sur la victime. Si l'on ne redouble pas de vigilance et ne maîtrise pas l'identification des informations et des comportements inhabituels, n'importe qui peut devenir la proie de criminels utilisant les hautes technologies. Face à cette vague de falsification sophistiquée, chaque citoyen doit rester vigilant, éviter de partager ses informations personnelles sans discernement et être prêt à dénoncer les actes illégaux, contribuant ainsi à sa propre sécurité et à celle de la communauté.

Un « bouclier numérique » communautaire est nécessaire pour lutter contre la menace des deepfakes.

Selon le Département de la radio, de la télévision et de l'information électronique (ministère de la Culture, des Sports et du Tourisme), en 2024, les plateformes numériques au Vietnam ont dû supprimer plus de 4 000 vidéos contenant des informations fausses et déformées, dont la plupart étaient des produits créés à partir de technologies d'IA telles que le deepfake, le clone de voix... TikTok à lui seul - une plateforme populaire auprès des jeunes - a été invité à supprimer plus de 1 300 clips deepfake, principalement liés aux forces de police, au gouvernement et à la politique sociale.

À l'ère de l'explosion technologique, l'intelligence artificielle ouvre des perspectives révolutionnaires, mais elle comporte aussi des dangers sans précédent, notamment les deepfakes au contenu déformé, qui portent atteinte à la réputation des organismes publics. Une enquête du MICRI Media Research Institute révèle que 62 % des utilisateurs des réseaux sociaux au Vietnam ne sont pas capables de distinguer le vrai du faux sans être avertis par les médias traditionnels ou les autorités. Il s'agit d'un « lacune cognitive » que les forces du mal exploitent à fond pour diffuser de fausses informations et perturber la psychologie sociale.

Tong Van T. au poste de police.

Selon le général de division, professeur agrégé et expert en criminologie, le Dr Do Canh Thin, utiliser l'IA pour créer de fausses vidéos de dirigeants, éditer de fausses déclarations ou déformer les actions professionnelles des forces de police est une technique nouvelle, mais particulièrement dangereuse. « Le deepfake n'est pas simplement un produit de divertissement, mais une forme moderne de guerre de l'information, capable de détruire la confiance, de provoquer une instabilité sociale et très difficile à contrôler », a déclaré le général de division Do Canh Thin.

En réalité, les vidéos manipulées par l'IA ne sont pas inoffensives, mais abordent souvent des sujets sensibles comme le traitement des infractions, les enquêtes criminelles, la lutte contre la corruption, etc., ce qui sème la confusion et la méfiance à l'égard des forces de l'ordre. Plus inquiétant encore, de nombreuses vidéos sont partagées sur des plateformes majeures comme YouTube et TikTok, cumulant des centaines de milliers de vues avant d'être supprimées, créant ainsi un effet viral négatif.

L'expert en médias numériques Hoang Minh prévient : « Un simple partage ou un simple « J'aime » sans précaution peut vous faire propager de fausses informations. Chaque internaute doit comprendre que tout comportement sur Internet a des conséquences réelles. »

Dans ce contexte, il est plus que jamais nécessaire de construire un « bouclier numérique » à partir de la communauté elle-même : vigilance, immunité informationnelle et responsabilité vis-à-vis de l’environnement réseau. La technologie est peut-être neutre, mais la manière dont les gens l’utilisent déterminera si l’IA deviendra un moteur de développement ou une force destructrice de la confiance sociale. Maintenir le front idéologique et protéger l’image du soldat de la Sécurité publique populaire, c’est protéger les fondements de la sécurité nationale, une mission qui incombe non seulement au secteur fonctionnel, mais à chaque citoyen à l’ère numérique.

Source : https://baolangson.vn/tinh-hai-mat-cua-ai-5050403.html

![[Photo] Le 9e Congrès du Parti de la Maison d'édition politique nationale Vérité](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/6/24/ade0561f18954dd1a6a491bdadfa84f1)

![[Photo] Le secrétaire général To Lam rencontre le groupe des jeunes députés de l'Assemblée nationale](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/6/24/618b5c3b8c92431686f2217f61dbf4f6)

![[Photo] Gros plan du Thu Thiem modernisé, reliant une nouvelle vie au District 1](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/6/24/d360fb27c6924b0087bf4f288c24b2f2)

Comment (0)