Según The Hacker News , Wiz Research, una startup de seguridad en la nube, descubrió recientemente una fuga de datos en el repositorio de GitHub de Microsoft AI, que se dice que se expuso accidentalmente al publicar un grupo de datos de entrenamiento de código abierto.

Los datos filtrados incluyen una copia de seguridad de las estaciones de trabajo de dos ex empleados de Microsoft con claves secretas, contraseñas y más de 30.000 mensajes internos de la aplicación Teams.

El repositorio, llamado "robust-models-transfer", ya no está disponible. Antes de su desmantelamiento, contenía código fuente y modelos de aprendizaje automático relacionados con un artículo de investigación de 2020.

Wiz afirmó que la filtración de datos se produjo debido a un token SAS extremadamente vulnerable, una función de Azure que permite a los usuarios compartir datos difíciles de rastrear y revocar. El incidente se reportó a Microsoft el 22 de junio de 2023.

En consecuencia, el archivo README.md del repositorio instruía a los desarrolladores a descargar modelos desde una URL de Azure Storage, proporcionando inadvertidamente acceso a toda la cuenta de almacenamiento y exponiendo así datos privados adicionales.

Además del acceso excesivo, el token SAS también estaba mal configurado, lo que permitía un control total en lugar de solo lectura, según los investigadores de Wiz. De ser explotado, un atacante no solo podría ver, sino también eliminar y sobrescribir todos los archivos de la cuenta de almacenamiento.

En respuesta al informe, Microsoft afirmó que su investigación no halló evidencia de exposición de datos de clientes ni de que otros servicios internos estuvieran en riesgo como resultado del incidente. La compañía enfatizó que los clientes no necesitan tomar ninguna medida y afirmó haber revocado los tokens SAS y bloqueado todo acceso externo a las cuentas de almacenamiento.

Para mitigar riesgos similares, Microsoft amplió su servicio de análisis de secretos para buscar tokens SAS con privilegios limitados o excesivos. También identificó un error en el sistema de análisis que marcaba las URL de SAS en el repositorio como falsos positivos.

Los investigadores afirman que, debido a la falta de seguridad y gobernanza de los tokens de las cuentas SAS, la precaución es evitar su uso para compartirlos externamente. Los errores de generación de tokens pueden eludirse fácilmente y exponer datos confidenciales.

Anteriormente, en julio de 2022, JUMPSEC Labs reveló una amenaza que podría explotar estas cuentas para obtener acceso a empresas.

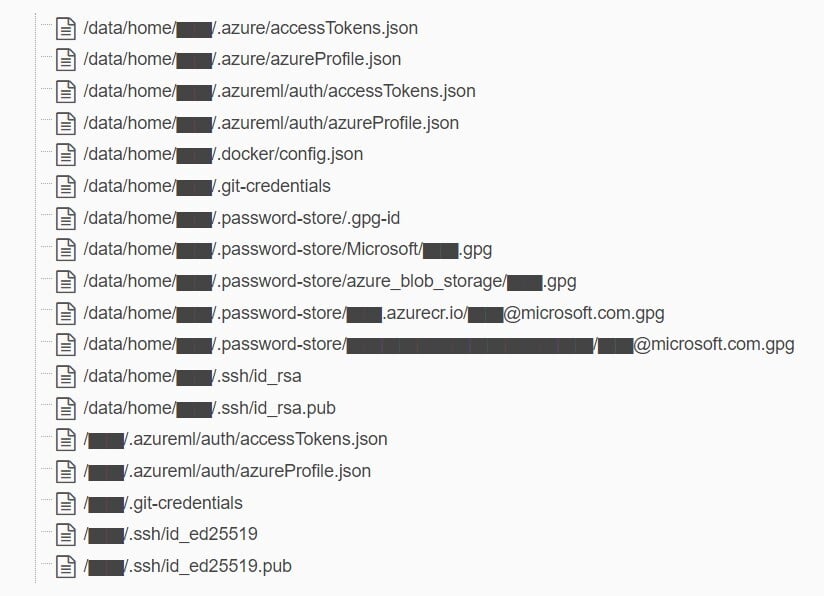

Archivos confidenciales encontrados en la copia de seguridad de Wiz Research

Esta es la última brecha de seguridad de Microsoft. Hace dos semanas, la compañía también reveló que hackers chinos habían accedido a claves de alta seguridad. Los hackers se apoderaron de la cuenta de un ingeniero de la corporación y accedieron a su repositorio de firmas digitales.

El último incidente muestra los riesgos potenciales de introducir IA en grandes sistemas, afirma Ami Luttwak, director de tecnología de Wiz CTO, quien afirma que la IA ofrece un enorme potencial para las empresas tecnológicas. Sin embargo, a medida que los científicos e ingenieros de datos se apresuran a implementar nuevas soluciones de IA, la enorme cantidad de datos que procesan requiere controles y medidas de seguridad adicionales.

Dado que muchos equipos de desarrollo necesitan trabajar con enormes cantidades de datos, compartirlos con sus pares o colaborar en proyectos públicos de código abierto, casos como el de Microsoft son cada vez más difíciles de rastrear y evitar.

[anuncio_2]

Enlace de origen

![[Foto] El Secretario General To Lam asiste al 80 aniversario de la diplomacia de Vietnam](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/25/3dc715efdbf74937b6fe8072bac5cb30)

Kommentar (0)