|

เสียงของคนดังบางคนถูกนำมาใช้ในการวิจารณ์เกม ภาพ: Meta |

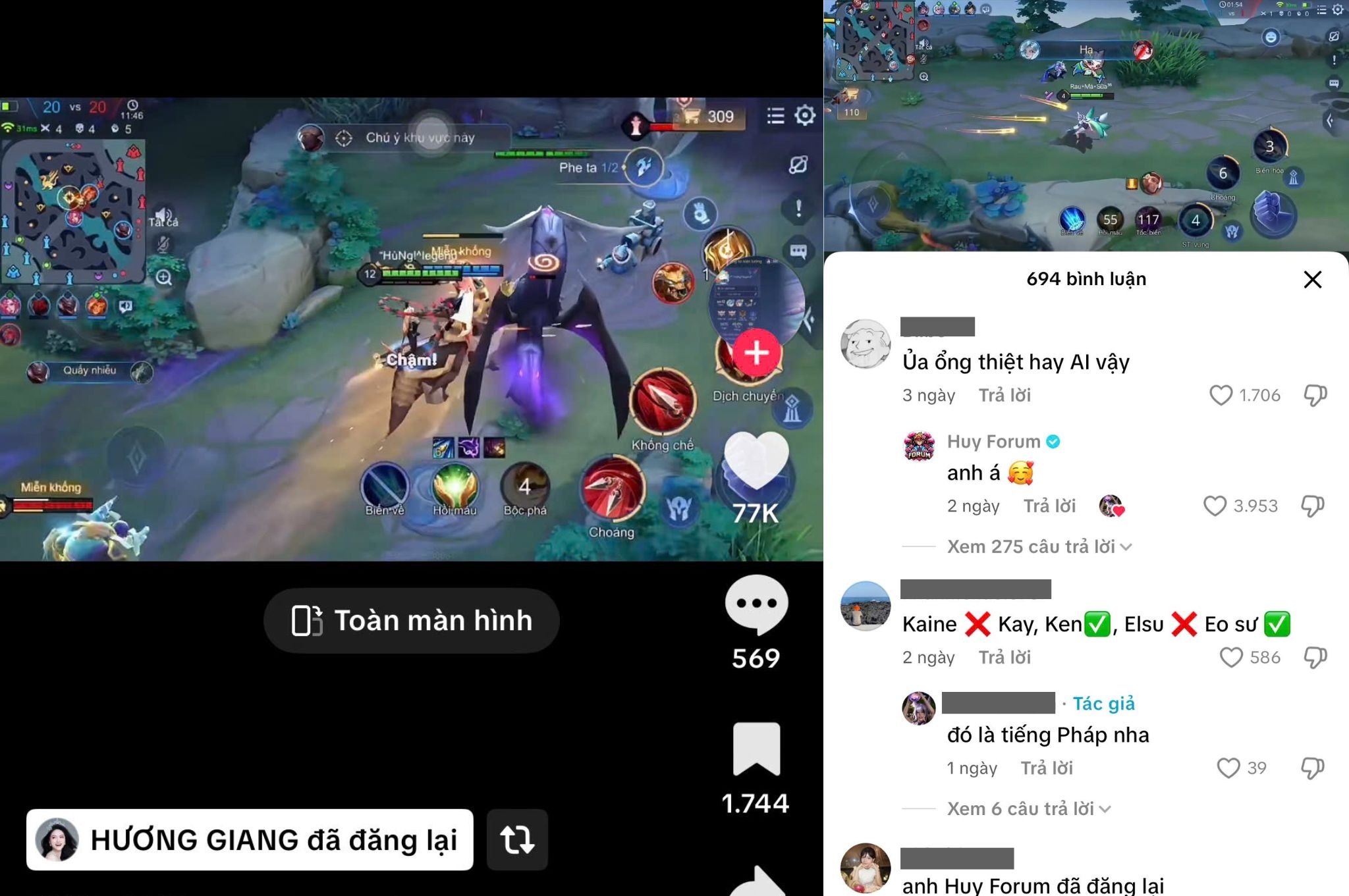

เมื่อไม่นานมานี้ บนโซเชียลมีเดีย โดยเฉพาะ TikTok มักมีวิดีโอบันทึกหน้าจอขณะเล่นเกมปรากฏขึ้นมาหลายชุด แต่เสียงพากย์ที่ได้ยินส่วนใหญ่มาจากคนดัง ศิลปินบางคนได้พากย์เสียงตัวเอง เช่น Huong Giang, Bich Phuong, Phuong My Chi หรือ TikTokers เช่น Huy Forum, Tho Nguyen, Jenny Huynh เพื่อวิเคราะห์และแสดงความคิดเห็นเกี่ยวกับเกม Lien Quan Mobile กีฬา ...

อย่างไรก็ตาม ไม่มีศิลปินคนใดพากย์เสียง ในวิดีโอนี้ เลย แต่ผู้ใช้กลับใช้ AI เลียนแบบเสียงของตนเอง ผู้ใช้รายนี้ใช้เครื่องมือที่ชื่อว่า Minimax เพื่อแปลงข้อความเป็นเสียงพูดตามคำแนะนำจากบัญชีหนึ่ง

Minimax Technology เป็นบริษัท AI สัญชาติจีนที่มีชื่อเสียงด้านความสามารถในการโคลนเสียงจากการบันทึกเสียงสั้นๆ Minimax ร่วมกับแพลตฟอร์มอื่นๆ เช่น OpenAI TTS และ ElevenLabs ได้ลดอุปสรรคทางเทคนิคลง ทำให้ทุกคนสามารถสร้างเสียงของใครก็ได้

Minimax ได้รับการสนับสนุนจากบริษัทขนาดใหญ่ เช่น Tencent, Alibaba และกองทุนร่วมลงทุนอีกมากมาย ลูกค้าของบริษัทอยู่ในหลากหลายอุตสาหกรรม เช่น เกม การศึกษา การเงิน และความบันเทิง ซึ่งมีวัตถุประสงค์ร่วมกัน เช่น การพากย์วิดีโอเกม การคอมเมนต์ไฮไลท์กีฬา และการเพิ่มเนื้อหาลงในวิดีโอตลก

คลิปสั้นๆ ที่ใช้เสียงของคนดังสามารถกลายเป็นกระแสไวรัลและกลายเป็นเทรนด์ได้ง่ายๆ ผู้ชมจะรู้สึกแปลกใหม่และน่าสนใจเมื่อได้ยินคนดังคนโปรดแสดงความคิดเห็นเกี่ยวกับเกมหรือพูดประโยคที่กำลังเป็นกระแส

คนส่วนใหญ่มองว่านี่เป็นเสียง AI และจงใจแสดงความคิดเห็นชื่นชมเสียงของคนดัง บุคคลจริงบางคน เช่น Huong Giang และ Huy Forum ก็แสดงความยินดีเมื่อเสียงของพวกเขาถูกนำไปใช้อย่างตลกขบขันและนำเนื้อหาไปโพสต์ซ้ำ

|

ทั้ง Huong Giang และ Huy Forum ต่างรีโพสต์วิดีโอ AI โดยใช้เสียงของพวกเขา ภาพ: TikTok |

ด้วยวิดีโอที่มีอยู่เพียงไม่กี่รายการ ผู้ใช้เพียงแค่กรอกเนื้อหาที่ต้องการเลียนแบบ แล้วรอสักครู่ก็จะได้วิดีโอเวอร์ชันเต็ม ด้วยเหตุนี้ จึงมีการสร้างบัญชีใหม่จำนวนมากขึ้น เช่น การใช้ไวยากรณ์ของชื่อคนดังประกอบกับชื่อเกม เพื่อโพสต์วิดีโอดังกล่าว "แทบไม่มีคนดังคนไหนเลยที่ไม่เล่น Lien Quan" ผู้แสดงความคิดเห็นคนหนึ่งกล่าวติดตลก

แม้จะนำเสนอความบันเทิงสู่โลกออนไลน์ แต่ผู้ใช้บางรายก็ใช้ประโยชน์จากฟีเจอร์นี้เพื่อวัตถุประสงค์ที่มุ่งร้าย การหลอกลวงผ่าน Deepvoice มีความซับซ้อนมากขึ้นเรื่อยๆ โดยใช้เสียงของคนที่คุณรักในสถานการณ์ฉุกเฉินเพื่อบังคับให้โอนเงินทันที

ในเวียดนาม การหลอกลวงประเภทหนึ่งที่ได้รับความนิยมในช่วงไม่นานมานี้ คือ การโทรหาผู้ปกครองเพื่อแจ้งว่าบุตรหลานของตนประสบอุบัติเหตุและจำเป็นต้องโอนเงินเพื่อเข้ารับการผ่าตัดทันที

ในต่างประเทศ กรรมการบริษัทในสหราชอาณาจักรถูกหลอกเอาเงินไปกว่า 240,000 ดอลลาร์ หลังจากได้ยิน "เจ้านาย" ของเขาขอให้โอนเงินทางโทรศัพท์ พนักงานฝ่ายการเงินในฮ่องกงคนหนึ่งถูกหลอกให้โอนเงิน 3.3 ล้านดอลลาร์ หลังจากได้รับโทรศัพท์จาก "กรรมการ" ของเขา

ในประเทศจีน Minimax และบริษัทปัญญาประดิษฐ์เสียงอื่นๆ มักกำหนดเงื่อนไขว่า "ห้ามใช้เสียงมนุษย์จริงโดยไม่ได้รับอนุญาต" แต่ในความเป็นจริงแล้วการควบคุมนั้นทำได้ยากมาก เทคโนโลยีนี้ค่อนข้างคล้ายกับ Deepfake ที่ใช้ใบหน้าคนดัง แต่ในกรณีนี้ เสียงที่ใช้สำหรับการโฆษณาที่ผิดกฎหมาย แถลงการณ์ที่ก่อให้เกิดข้อโต้แย้ง และข่าวปลอม

ศิลปินนานาชาติมากมาย อาทิ Drake และ The Weeknd ได้ออกมาแสดงความคิดเห็นเมื่อเพลง "AI cover" ที่ใช้เสียงของพวกเขากลายเป็นไวรัล ปัญหาการละเมิดความเป็นส่วนตัวและการเผยแพร่ข่าวปลอมโดยใช้ AI ก็กำลังก่อให้เกิดข้อถกเถียงในหลายประเทศทั่วโลก โดยมีเป้าหมายเพื่อสร้างกรอบทางกฎหมายที่เหมาะสม

การโคลนเสียง นอกจากการพากย์เสียงสำหรับวิดีโอบันเทิงดังที่กล่าวมาแล้ว ยังสามารถใช้เพื่อวัตถุประสงค์เชิงบวกได้อีกด้วย เช่น การสร้างเสียงของบุคคลอันเป็นที่รักที่เสียชีวิตไปแล้ว หรือการสนับสนุนผู้ที่สูญเสียเสียง อย่างไรก็ตาม ผู้ที่ใช้เสียงดังกล่าวควรได้รับแจ้งเกี่ยวกับเหตุการณ์ที่เกิดขึ้น เพื่อควบคุมและลดความเสี่ยงของการถูกละเมิดอย่างมีประสิทธิภาพ

ที่มา: https://znews.vn/su-that-ve-clip-phuong-my-chi-huong-giang-binh-luan-game-post1579300.html

![[ภาพ] เลขาธิการโต ลัม เข้าร่วมงานฉลองครบรอบ 80 ปี การทูตเวียดนาม](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/25/3dc715efdbf74937b6fe8072bac5cb30)

การแสดงความคิดเห็น (0)