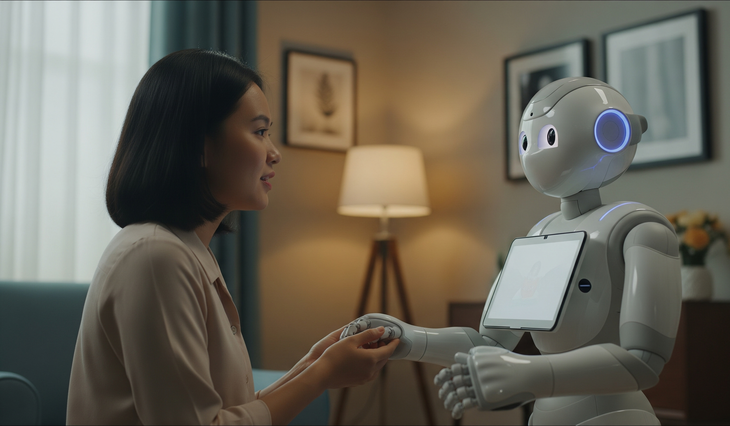

Изображение человека, доверяющего свои мысли психотерапевтическому роботу

Терапия раньше была путешествием, которое требовало от человека внимательного и эмоционального слушания. Но с развитием искусственного интеллекта и технологий обработки естественного языка появляется новое поколение терапевтических роботов.

Не нужно посещать клинику, не нужен настоящий врач, достаточно телефона или планшета, чтобы начать «чат» с роботом. Но это также поднимает вопрос: может ли обратная связь от машин действительно быть успокаивающей?

Психотерапевтические роботы становятся умнее

Взрыв больших языковых моделей (LLM), таких как GPT, Claude или Gemini, позволил терапевтическим роботам общаться на естественном языке, давая последовательные и эмпатические ответы. Такие стартапы, как Wysa, Woebot или Replika, разработали чат-приложения на базе искусственного интеллекта, которые могут распознавать эмоции в тексте и подстраивать свои ответы под настроение пользователя.

За, казалось бы, простыми разговорами скрывается сложная система обработки языка , которая сочетает машинное обучение и анализ настроений. Модели ИИ обучаются на миллионах анонимных разговоров, а также на основах поведенческой психологии.

Когда пользователь отправляет сообщение типа «Я чувствую усталость и безнадежность», система не только отвечает утешительными словами, но и может распознать признаки эмоционального стресса и предложить методы когнитивной коррекции.

Помимо обработки текста, некоторые системы также интегрируют ИИ, который анализирует речь, чтобы распознавать уровни стресса по скорости речи, интонации или частоте тишины. Отсюда роботы могут «распознавать» тонкие изменения эмоций, даже если пользователь этого не говорит.

Ответы также становятся более естественными и больше не стереотипными, как у старых чат-ботов, благодаря моделям, которые постоянно обучаются на основе предыдущего поведения при взаимодействии.

Технология облачных вычислений синхронизирует все данные, поэтому, используете ли вы телефон или компьютер, общение в чате будет безупречным. ИИ не просто полагается на то, что говорит пользователь, он также учится на истории чата, времени взаимодействия, частоте эмоциональных ключевых слов и т. д., чтобы адаптировать свой стиль ответа к каждому человеку . Вот почему многие люди чувствуют, что их терапевтический робот на самом деле «узнает» их со временем.

Когда машина может слушать, но не обязательно понимать

Согласно исследованию Tuoi Tre Online , независимо от того, насколько хорошо ИИ может анализировать язык, все еще существует разрыв между пониманием семантики и чувством эмоций . Робот может отвечать стандартными словами поддержки, но ему не хватает тепла, которое исходит от человеческого сострадания.

В случаях тяжелого психического кризиса роботы не могут заменить своевременное реагирование, особенно когда требуются конкретные действия, вмешательство или экстренная поддержка.

Более того, системы ИИ по-прежнему зависят от данных, которые им подаются. Если в наборе данных для обучения отсутствует разнообразие в культуре, местном языке или выражении, ответы робота могут казаться «холодными» или предвзятыми в определенном контексте.

Некоторые приложения также сталкиваются с ограничениями, когда пользователи выражают эмоции косвенно или используют метафоры, что часто встречается в разговорах на психологические темы.

Кроме того, в сегодняшнюю цифровую эпоху нельзя игнорировать вопросы конфиденциальности. Поскольку психологические данные являются конфиденциальным типом информации , если они не зашифрованы и не контролируются строго, они могут стать серьезным риском разоблачения. Поскольку технологии становятся все более персонализированными, обмен эмоциями с машинной системой должен осуществляться с пониманием сопутствующих рисков.

Нельзя отрицать, что технологии сделали психиатрическую помощь более доступной, чем когда-либо. ИИ и терапевтические роботы могут стать первыми помощниками, обеспечивая временное облегчение от сложных эмоций. Но все же следует с осторожностью полностью доверять машине.

Понимая ограничения технологий, пользователи будут знать, как использовать их преимущества без зависимости, чтобы они могли контролировать свои эмоции, а не следовать за умными строками кода.

Источник: https://tuoitre.vn/robot-tri-lieu-tam-ly-co-thau-hieu-hay-chi-biet-lang-nghe-20250618102426124.htm

![[Морские новости] Wan Hai Lines инвестирует 150 миллионов долларов в покупку 48 000 контейнеров](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/6/20/c945a62aff624b4bb5c25e67e9bcc1cb)

Комментарий (0)