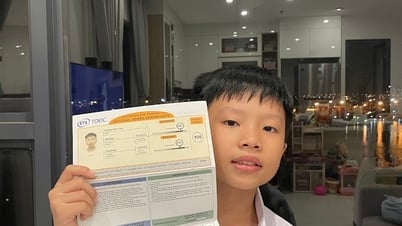

케이시 해럴 씨(45세)가 이 실험에 참여했습니다. - 사진: UC 데이비스

네이처 (Nature) 지에 따르면, 6월 11일자 보도에 따르면, 말을 심하게 잃는 질병인 근위축성 측색 경화증(ALS)을 앓고 있는 케이시 해럴(45세) 씨는 뇌에 이식된 AI 장치 덕분에 "진짜 목소리"로 말하고 노래할 수 있게 됐습니다.

뇌-컴퓨터 인터페이스(BCI)라 불리는 이 장치는 인공지능을 사용하여 사용자가 말을 할 때 뇌의 전기적 활동을 디코딩합니다.

특히, 이번 시스템은 사람이 말하려고 했던 단어를 재생할 뿐만 아니라, 억양, 음높이, 뉘앙스와 같은 자연스러운 음성 특성을 전달할 수 있는 것은 처음입니다. 이러한 특성은 감정과 의미를 보다 명확하게 표현하는 데 도움이 되는 중요한 요소입니다.

이 BCI 시스템은 신경 신호를 음성이나 노래로 거의 즉시 변환할 수 있습니다. 특히, 이 시스템은 뇌에서 신호를 보낸 후 단 10밀리초 만에 인공 음성을 생성할 수 있는데, 이는 음성을 생성하는 데 몇 초가 걸리던 기존 장치보다 훨씬 빠른 속도입니다.

케이시 씨의 운동 피질에 이식된 이 장치는 256개의 작은 전극으로 구성되어 있습니다. 과학자들은 AI 알고리즘을 훈련시켜 10밀리초마다 뇌 신호를 해독하고, 완전한 단어나 개별 음소뿐만 아니라 모든 말 시도를 기록하도록 했습니다.

실험 결과, 사용자는 "아", "오", "흠"과 같은 느낌표를 낼 수 있었으며, 심지어 훈련 데이터에 없는 단어도 말할 수 있는 것으로 나타났습니다.

연구팀은 케이시 씨의 오래된 녹음을 활용해 개인화된 합성 음성을 만들었는데, 케이시 씨는 마치 자신의 "진짜 목소리"를 다시 듣는 것 같은 느낌이 든다고 감정적으로 표현했습니다.

이 장치는 사용자가 질문형인지 진술형인지 구분하고, 합성된 음성의 톤을 자동으로 조절할 수 있습니다. 또한, 같은 문장 내 다른 단어의 강조점도 인식할 수 있는데, 이는 메시지의 의도된 의미를 정확하게 재현하는 데 중요합니다.

캘리포니아 대학교 데이비스 캠퍼스 연구팀의 일원인 메트레이 와이라그카르 박사는 이번 연구가 언어 장애가 있는 사람들이 고정된 어휘의 한계를 극복하고 보다 자연스럽게 의사소통할 수 있도록 돕는 데 있어 한 걸음 더 나아간 것이라고 말했습니다.

다른 과학자들도 이를 BCI 분야의 "혁신적" 혁신으로 보고 있으며, 말을 할 수 없는 사람들을 위한 일상적인 의사소통 도구가 될 잠재력을 지닌, 매우 적용 가능한 언어 지원 도구의 길을 열었다고 생각합니다.

출처: https://tuoitre.vn/dot-pha-thiet-bi-cay-ghep-nao-ai-giup-nguoi-cam-noi-va-hat-20250614092557976.htm

댓글 (0)