この問題をより深く理解するために、ジャーナリスト&パブリックオピニオン紙の記者は、コミュニケーションとソーシャルネットワークの分野の専門家であり、VTVcab番組制作センターの副所長であるジャーナリストのグエン・カオ・クオン氏と会話を交わした。

AI 製品は使用時にラベルを付ける必要がある。

+ 先生、最近の AI 技術の発展について、特に最近ではテキストからビデオを作成できる Sora (OpenAI の ChatGPT の兄弟) と呼ばれるアプリケーションが登場したことについて、どう思われますか?

メディア分野におけるAI技術の応用は、現在、大きな進歩を遂げています。これまでAIは主に静止画やシンプルな画像の作成に利用されていましたが、今やAIは動画制作にも活用され始めています。OpenAIのSoraアプリケーションは、テキストを最長1分未満の短い動画に変換できる機能を備え、リリースされました。Soraは、鮮明な画像、滑らかな動き、そして臨場感あふれる背景を備えた動画を作成します。これにより、テクノロジー企業、メディア分野に特化した企業、さらには報道機関にとって、動画クリップ形式の動画を自社のメディア製品の説明に活用する絶好の機会が生まれます。

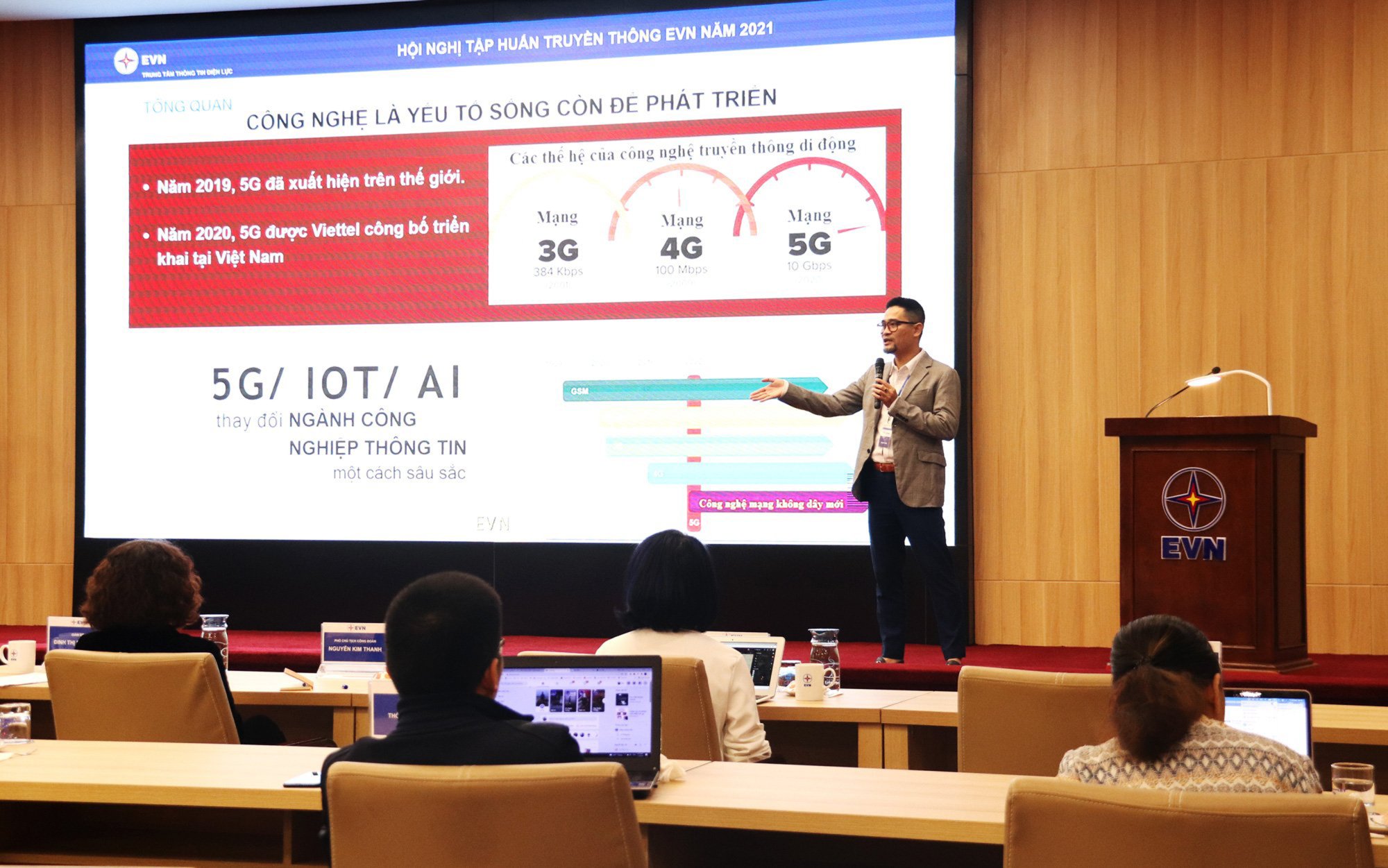

ジャーナリストのグエン・カオ・クオン氏 - VTVcab 番組制作センター副所長がメディア研修会に参加。

しかし、AI製品の利用は依然として各関係者によって慎重に行われており、多くの国では、明確な法的根拠を確保するために、ジャーナリズム分野におけるAIの利用に関する規制の構築を検討しています。報道関係者にとってAIは非常に優れた有用なツールですが、特にジャーナリズム分野においては、どのように活用するかを真剣に検討する必要があります。ジャーナリズムという分野自体が、客観的な真実を尊重するという要素を持っています。一方、私たちが使用している人工知能製品は、機械によって作られた製品、つまり統合されたものであり、あくまでも例示に過ぎません。

+ 機会には常にリスクが伴います。AIアプリケーションが高度になるほど、リスクも大きくなります。この意見についてどう思われますか?

技術の発展に伴い、AIが実在の人物に見せかけた偽物を多数作成するリスクがあります。人間の画像が、実在の人物のように見える形でネットワーク上で活動するケースが見られます。これは、過去にも見られた情報セキュリティ上の不安を引き起こします。例えば、ディープフェイクが画像や音声を偽造してオンライン詐欺を行うという状況は、実に一般的です。ディープフェイクとAIのマイナス面は、私たち自身の懸念を引き起こし、徐々に人々はAIが作成した画像を信じなくなるでしょう。

現在、報道機関や国家管理機関はAI分野に関する規制を一切設けていません。そのため、報道機関は、この技術を使用する際には、多かれ少なかれAI製品であることを示すラベルを貼るべきです。これは、これらが人間が作成したものではなく、人工知能によって作成されたものであることを国民に警告するためでもあります。同時に、国民の誤解を避けるため、これらは実写ではなく、あくまでも説明的な画像であることを強調する必要があります。

ジャーナリストのグエン・カオ・クオン氏が学生たちにメディア製品制作の実践を指導しています。

ジャーナリズムにおいて AI を使用する際には、細心の注意と機転が求められます。

+ 近い将来、報道機関は AI がもたらす利点をどのように活用できるでしょうか?

報道機関は、グラフィック、広告、紹介、イラストなど、AIが生成したイラストを使用しています。そのため、絶対的な正確性に対する要求はそれほど高くなく、使用することができます。しかし、調査記事、ルポルタージュ記事、あるいは単なるニュース記事では、AI画像の使用は絶対に許可されません。なぜなら、一般の人々が実際の画像とAIが生成した画像を混同してしまうからです。

したがって、ジャーナリズムの分野でAIを活用する際には、非常に慎重かつ巧妙に行う必要があります。メディア企業、つまり企業の商品広告、商品販売、顧客誘導のためのメディア制作を専門とする部門の製品であれば、AIを活用することは全く問題ありません。ただし、これはあくまでも、魅力的でクリエイティブなイラストレーション画像を迅速に作成するという目的のためだけに活用するものです。メディア作品の用途によって、ラベルが付けられるか否かは変わってきます。しかし、私見では、これはラベル付けされるべき新しい現象です。

例えば、数十年、数百年前に起きた出来事を描写するツールがあれば、AIを活用してその描写を支援することができます。しかし、そのツールが描く内容は、ジャーナリストの知識に大きく依存します。AIに提供する情報だけでなく、AIに送るテキストやコマンドも、ジャーナリストがその年の出来事を理解していなければなりません。また、例えば、ジャーナリストがAIを使って陳朝の兵士たちが登場する戦争シーンの絵を再現する場合、陳朝の兵士たちがどのような人々だったのか、彼らの衣装や武器はどのようなものだったのかといった基礎知識がなければ、他の時代のものと混同してしまう可能性が高くなります。

OpenAIのSoraは、複雑なシーン、カメラワーク、そして感情豊かな複数のキャラクターを含む、最長1分間の動画を生成します。Soraアプリによって生成されたクリップのスクリーンショット。

+ ジャーナリズム作品が AI によって作成された場合、または AI によって大部分が作成された場合、それが高品質のジャーナリズムとして評価されたり、ジャーナリズムの賞に応募されたりする場合、法的にどのように判断しますか?

現在、情報通信省やベトナムジャーナリスト協会の報道におけるAI利用に関する規則には、具体的な指示や規制はありません。しかし、AIを何らかの部分やセクションで利用する報道機関は、その旨を明確に表示する必要があります。作品がコンテストに応募されているかどうかに関わらず、一般公開されるものである限り、ジャーナリストは特に広範な知識に基づいて、明確に区別できるよう細心の注意を払う必要があると思います。AIが成果物を作成する際に混乱が生じないよう、正確な入力情報を提供する必要があります。AIから成果物が作成された後、私たちはそれを再確認する必要があります。ジャーナリストは編集者のような意識を持ち、それが標準的かどうかを判断する必要があります。AIの黎明期であり、入力データがまだ不足している時期には、混乱が生じる可能性が非常に高いため、より一層の注意を払う必要があります。

OpenAIは、書かれたコマンドからリアルなビデオを生成できるAIアプリケーション、Soraを発表した。

+ あなたの意見では、報道機関は、記者やジャーナリストが AI、特に新しく導入された機能を活用できるように、トレーニングと開発を強化すべきでしょうか?

もちろんです。AI動画コンテンツ、縦型動画、音声・テキストコンテンツ制作、写真… 常に読者や視聴者を惹きつけたいジャーナリストとして、私たちは常に新しい知識をアップデートする必要があります。最も重要なのは、ツールの使い方、編集、校正、検証の思考力です。ジャーナリストの専門分野に対する理解は十分でしょうか? つまり、すべての記者、ジャーナリスト、編集者は、AIツールへのアクセスが容易になればなるほど、ミスを犯す可能性が高くなるという点に注意を払う必要があります。

ジャーナリズムやテレビ番組では、コンテンツや画像が当時の文脈に照らし合わせて、出来事に関する論理性、信憑性、正確性を生み出している限り、何度でも使用できます。それが重要です。AIによるジャーナリズム作品が適切に管理され、信憑性があり、適切であれば、問題はないと思います。歴史的再構成写真、絵画、動画などは使用できますが、再構成画像がAIによってどの時代、どの時期に、どのような内容で作成されたかといった文脈がわかるようにラベルを付けるなど、使用目的を明確にする必要があります。

+ 法的および安全上の問題がまだあるため、報道機関は、ソーシャル ネットワーキング プラットフォームに投稿するためだけに使用される報道資料を作成するために AI 製品を使用するべきでしょうか?

AI製品を作ってソーシャルメディアにアップロードするだけでも労力がかかりすぎるのであれば、考え直す必要があると思います。もし労力がかかりすぎるのであれば、そうした製品は自社のウェブサイトに掲載すべきです。Facebook、TikTok、YouTubeといったプラットフォームは依然としてサードパーティプラットフォームであり、これらのチャンネルからも収益を上げることは可能ですが、長期的な戦略としては、自社チャンネルを育成していくことが不可欠です。したがって、最も価値が高く、労力をかけたコンテンツは、運営者の公式チャンネルに掲載すべきです。

+ ありがとうございました!

ル・タム(演奏)

[広告2]

ソース

![[写真] 大統領府党委員会第9回大会(任期2025~2030年)](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/6/20/78e7f27e8c4b4edc8859f09572409ad3)

コメント (0)