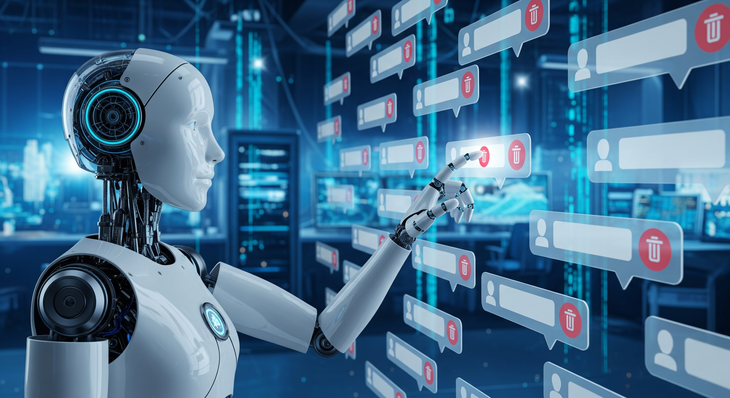

La IA escanea y elimina comentarios en las redes sociales

Cuando la gente deja un comentario en un video de YouTube, una publicación de Facebook o un artículo en línea, no saben si llegará a alguien. No es porque esté mal escrito ni sea ilegal, simplemente lo bloquea un algoritmo de filtrado automático.

Las plataformas tecnológicas actuales emplean sistemas de filtrado de comentarios para eliminar el discurso de odio, la pornografía, la violencia y el discurso divisivo. El objetivo es "mantener la seguridad de las comunidades", pero ¿son estas herramientas tan desinfectantes que resultan insensibles?

Cuando la IA se convierte en el guardián de la expresión

A diferencia de los inicios de internet, cuando los comentarios sin procesar fluían libremente, la mayoría de las principales plataformas ahora delegan la responsabilidad del filtrado de contenido a la inteligencia artificial. Gracias al aprendizaje automático, los sistemas pueden escanear millones de líneas de texto a diario, evaluando el lenguaje, el tono e incluso el contexto para decidir si conservar o eliminar contenido.

Sin embargo, este sistema no siempre es exacto.

La Sra. Ngoc Vy (Ciudad Ho Chi Minh) compartió: "Mi comentario sobre un producto fue ocultado sin motivo alguno. No era una grosería ni spam, solo un comentario que desapareció a los pocos segundos".

Muchos contenidos se eliminan simplemente porque usan palabras sensibles en un contexto completamente normal. Frases como «pobreza», «hambre», «política» o «sistema» a veces se malinterpretan como negativas si el sistema no puede «leer» la esencia de la oración.

¿Filtrar o eliminar las críticas?

Según una advertencia de AlgorithmWatch (Alemania), los sistemas de censura automatizados pueden eliminar involuntariamente las voces disidentes, especialmente de grupos desfavorecidos o minoritarios, porque estos sistemas aprenden del comportamiento de la mayoría, que no es lo suficientemente diversa en términos de cultura y puntos de vista.

En Vietnam, el control estricto del contenido en las redes sociales es cada vez más común, especialmente en sitios de noticias altamente interactivos. Los comentarios sobre temas de actualidad y sociales suelen tener restricciones de visualización o deben ser aprobados previamente, lo que lleva a muchos a preguntarse: ¿Existe aún libertad de expresión en el ciberespacio?

Lo preocupante es que los usuarios rara vez saben por qué se ocultan o eliminan los comentarios. No hay notificaciones ni mecanismos transparentes de retroalimentación. Todo sucede en silencio, y en un mundo controlado por algoritmos, el silencio puede ser la forma más sutil de censura.

Mantenga Internet limpio, pero no blanquee la conversación

Un ciberespacio limpio no debería significar estéril. La sociedad es un espacio donde se expresan opiniones diferentes, constructivas, críticas y debatidas. Necesitamos algoritmos para filtrar el discurso tóxico, pero también debemos proteger el derecho a discrepar, a cuestionar y a plantear inconvenientes.

Cuando cada comentario tiene que ser “moderado”, debemos preguntarnos: ¿la tecnología está protegiendo a la comunidad o filtrando lo que la comunidad puede escuchar?

La tecnología no puede reemplazar a los humanos en la toma de decisiones valiosas. Y en la era de la IA, la transparencia y el derecho a la retroalimentación son los "algoritmos" más justos para todo el sistema.

La tecnología debería ayudar a las personas a expresarse, no decidir qué decir por ellas.

Fuente: https://tuoitre.vn/khi-ai-quyet-dinh-ban-duoc-noi-gi-tren-mang-20250701231035288.htm

![[Foto] Rojo brillante de la exposición 95 años de la Bandera del Partido iluminando el camino antes de la inauguración](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/27/e19d957d17f649648ca14ce6cc4d8dd4)

![[Foto] Mucha gente espera con impaciencia la revisión preliminar a pesar de las fuertes lluvias.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/27/4dc782c65c1244b196890448bafa9b69)

![[Foto] El primer ministro Pham Minh Chinh preside la reunión del Comité Directivo Nacional sobre Integración Internacional](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/26/9d34a506f9fb42ac90a48179fc89abb3)

![[Foto] El Secretario General To Lam asiste a una reunión con generaciones de diputados de la Asamblea Nacional.](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/8/27/a79fc06e4aa744c9a4b7fa7dfef8a266)

Kommentar (0)