El Departamento de Seguridad de la Información emitió recientemente una advertencia sobre la continua recurrencia de fraudes en videos e imágenes de alta tecnología.

En este sentido, la situación de los cibercriminales que aprovechan imágenes y vídeos públicos de personas para editarlos, cortarlos y amenazar con chantajearlos con vídeos falsos ha sido ampliamente advertida por las autoridades al público.

Utilizando la tecnología Deepfake, que permite reproducir el sonido y la imagen de una persona con gran precisión, los delincuentes pueden hacerse pasar por líderes en reuniones en línea o crear vídeos y llamadas para cometer fraudes financieros.

Además, estas estafas a menudo explotan factores psicológicos como la urgencia, el miedo o el poder, provocando que las víctimas actúen apresuradamente sin comprobar cuidadosamente la autenticidad.

Los deepfakes no se limitan a las estafas de inversión financiera. Otro ejemplo son las estafas románticas, donde se utilizan deepfakes para crear personajes ficticios que interactúan con las víctimas mediante videollamadas. Tras ganarse la confianza de la víctima, el estafador solicita transferencias de dinero para resolver emergencias, gastos de viaje o préstamos.

Ante la situación descrita, el Departamento de Seguridad de la Información recomienda a las personas tener cuidado con los consejos de inversión de celebridades en las redes sociales, tener cuidado con los mensajes, correos electrónicos o llamadas no identificados y observar cuidadosamente las expresiones faciales poco naturales en los videos.

Las personas también necesitan limitar la publicación de contenido relacionado con información personal en las redes sociales para evitar que información como imágenes, videos o voces sean robadas por malos; al mismo tiempo, configurar las cuentas en modo privado para proteger la información personal.

En declaraciones a periodistas del periódico Dai Doan Ket, el experto en ciberseguridad Ngo Minh Hieu, cofundador del Proyecto de Prevención del Ciberfraude de Vietnam (Chongluadao.vn), afirmó que el uso de la tecnología Deepfake en IA para falsificar videollamadas con fines fraudulentos sigue siendo complejo. Los sujetos explotan esta tecnología para aumentar la credibilidad de sus víctimas.

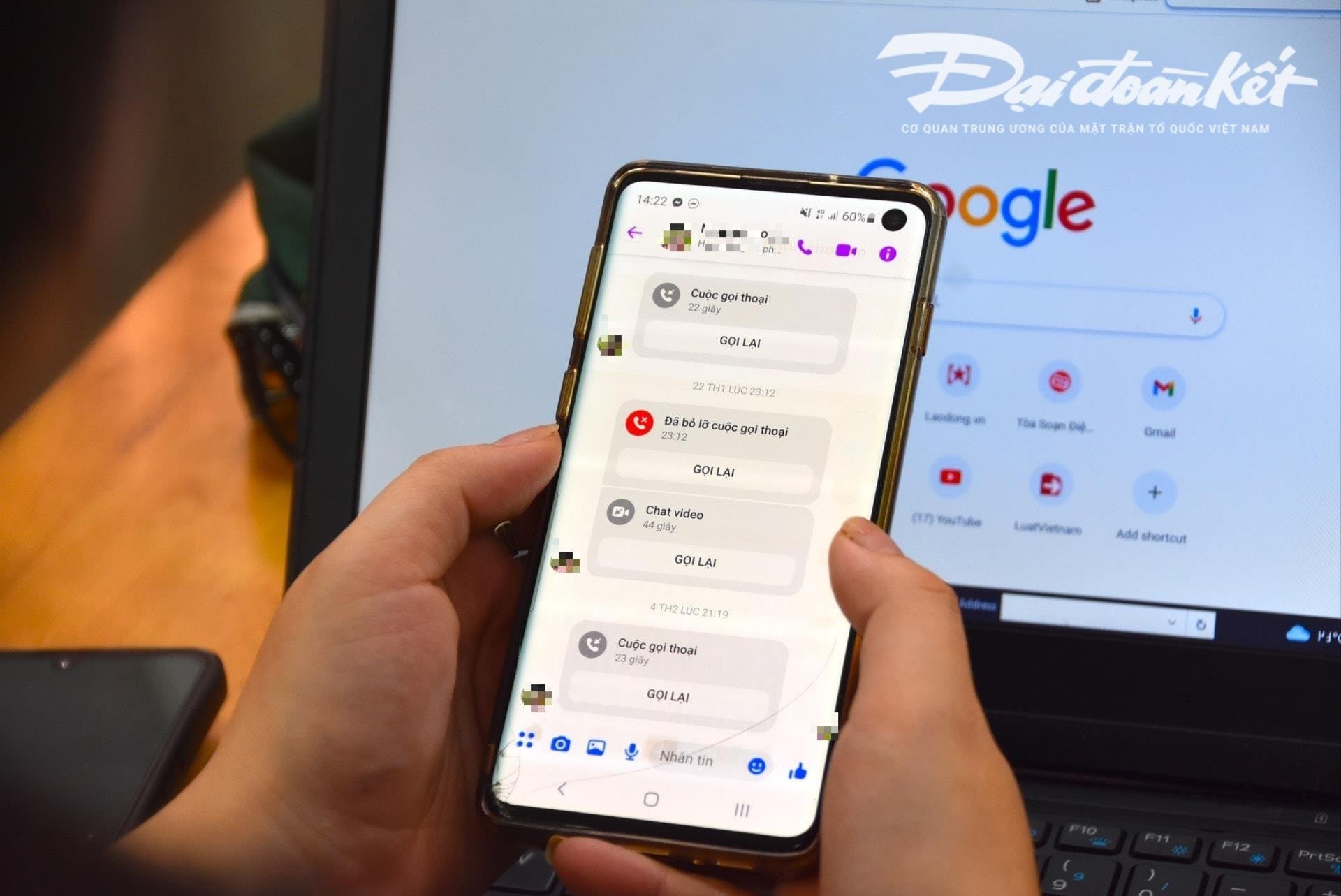

En concreto, los sujetos realizarán videollamadas de forma proactiva a las víctimas a partir de imágenes y vídeos previamente "robados" y los procesarán técnicamente, distorsionarán el sonido o falsificarán problemas de imagen para ganarse la confianza de las víctimas.

Por lo general, estas llamadas son muy cortas, duran apenas unos segundos, luego el estafador utiliza la excusa de la red inestable, estar en la calle, etc. para pedir a la víctima que cumpla con las peticiones del estafador.

Los expertos advierten que el uso de IA para el ciberfraude probablemente aumentará significativamente en el futuro próximo. Por lo tanto, es fundamental que las personas sean proactivas y estén más alertas, especialmente al recibir mensajes, videollamadas y enlaces desconocidos.

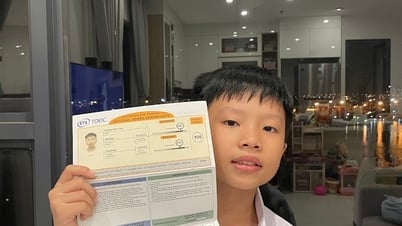

Según el análisis de este experto, el actual algoritmo de inteligencia artificial (IA) Deepfake durante las llamadas en tiempo real no podrá gestionar si la persona que llama gira a la izquierda, gira a la derecha o se pone de pie...

Una debilidad particular a la que se debe prestar atención al recibir estas llamadas son los dientes. Por ello, los algoritmos de IA actuales no pueden reproducir los dientes de la persona suplantada.

Al usar Deepfake, la imagen de la persona abriendo la boca puede no tener dientes; algunas personas tienen tres o incluso cuatro mandíbulas. Por lo tanto, la característica de los dientes es el elemento más reconocible de una llamada falsa que usa Deepfake.

Reducir el ritmo y no atender la solicitud de inmediato es fundamental para evitar caer en la trampa de la estafa. Al recibir un mensaje o una llamada a través de redes sociales, es necesario llamar directamente a sus familiares para verificar quién los contacta con un tiempo mínimo de más de 30 segundos o reunirse en persona.

En caso de sospecha de suplantación de familiares en redes sociales para defraudar o apropiarse de bienes, es necesario reportar de inmediato a la agencia policial más cercana para su oportuno apoyo y manejo.

[anuncio_2]

Fuente: https://daidoanket.vn/chuyen-gia-chi-meo-nhan-biet-cuoc-goi-deepfake-lua-dao-10300910.html

Kommentar (0)