Ο διαγωνισμός Επεξεργασίας Λόγου και Γλώσσας Βιετναμέζικης (VLSP) αποτελεί μέρος του ετήσιου Διεθνούς Συνεδρίου για την Επεξεργασία Λόγου και Γλώσσας Βιετναμέζικης γλώσσας που διοργανώνεται από τον Όμιλο VLSP, ένα παράρτημα του Συνδέσμου Τεχνολογίας Πληροφοριών του Βιετνάμ. Το VLSP 2023 διοργανώνει 10 διαγωνισμούς επεξεργασίας λόγου και κειμένου, συγκεντρώνοντας κορυφαίους ερευνητές, ειδικούς και μονάδες ανάπτυξης τεχνολογίας.

Παρόλο που αυτή ήταν η τέταρτη φορά που η Viettel AI συμμετείχε στον διαγωνισμό και είχε κερδίσει τρεις φορές στο παρελθόν, οι μηχανικοί της Viettel αντιμετώπισαν πολλές δυσκολίες λόγω αλλαγών στη δομή των κατηγοριών του διαγωνισμού.

Συγκεκριμένα, σε σύγκριση με πέρυσι, οι κατηγορίες Αναγνώριση Ομιλίας και Αναγνώριση Συναισθημάτων φέτος έχουν συγχωνευθεί σε μία κατηγορία. Οι ομάδες πρέπει να λύσουν δύο προβλήματα ταυτόχρονα για να διασφαλίσουν ότι αναγνωρίζονται τόσο το κείμενο όσο και το συναίσθημα της πρότασης, με αποτέλεσμα να διπλασιαστεί ο φόρτος εργασίας και η δυσκολία.

Αξιοποιήστε όλα τα δεδομένα, είτε χαμηλής είτε υψηλής ποιότητας

Όχι μόνο αλλάζει η δομή των κατηγοριών, αλλά η φετινή εξέταση επικεντρώνεται επίσης στη δημιουργία μοντέλων από την αρχή με περιορισμένες συνθήκες δεδομένων, συμπεριλαμβανομένων των ακατέργαστων, μη ετικετοποιημένων και χαμηλής ποιότητας δεδομένων. Η εξέταση παρέχει 4 ομάδες δεδομένων με διαφορετική ποιότητα και μορφή. Υπάρχουν δεδομένα που περιλαμβάνουν μόνο ήχο χωρίς ετικέτες, δεδομένα που περιλαμβάνουν μόνο ήχο και κείμενο, δεδομένα που περιλαμβάνουν συναισθήματα και ήχο, υψηλής ποιότητας, τυπικές ετικέτες, και ένα σύνολο δεδομένων που περιλαμβάνει συναισθήματα και ήχο, χαμηλής ποιότητας. Κάθε σύνολο δεδομένων είναι σαφώς καθορισμένο για να εξυπηρετεί κάθε σκοπό και κατηγορία εξέτασης, με συνολικά περισσότερες από 300 ώρες σε όλα τα σύνολα δεδομένων. Αυτός είναι ένας αρκετά μέτριος αριθμός σε σύγκριση με τα τυπικά σύνολα δεδομένων για την εκπαίδευση στην Αναγνώριση Ομιλίας, η οποία συνήθως απαιτεί έως και 1.000-2.000 ώρες ή και περισσότερο.

Κάθε ομάδα είχε λιγότερο από 2 μήνες για να εργαστεί και να υποβάλει την εργασία της, αλλά στην πραγματικότητα, ο πραγματικός χρόνος που αφιερώθηκε στην έρευνα λύσεων ήταν πολύ λιγότερος λόγω έλλειψης πόρων.

«Φέτος, η Viettel AI έχει αφιερώσει πολλούς πόρους υπολογιστικής υποδομής στην έρευνα νέων τεχνολογιών καθώς και στην ανάπτυξη προϊόντων, ενώ η αναγνώριση ομιλίας είναι μια τεχνολογία που απαιτεί πολλούς πόρους υλικού», δήλωσε ο κ. Dang Dinh Son - Μηχανικός Τεχνητής Νοημοσύνης, Πλατφόρμα Εικονικών Βοηθών, Viettel AI.

Αντιμέτωπη με την κατάσταση χαμηλού όγκου και ποιότητας δεδομένων, η ερευνητική ομάδα καθόρισε αμέσως την άποψη ότι «πρέπει να αξιοποιηθούν όλα τα δεδομένα ανεξάρτητα από τη χαμηλή ή την υψηλή ποιότητα». Για να γίνει αυτό, είναι απαραίτητο να δημιουργηθεί ένας κύκλος εκπαίδευσης για την επεξεργασία όλων των δεδομένων καθώς και μόνο ενός μοντέλου για την επίλυση πολλών διαφορετικών προβλημάτων αντί για πολλά μοντέλα.

Τα αποτελέσματα της πρωτοποριακής τεχνολογικής κυριαρχίας

Στο πλαίσιο τόσο της έλλειψης δεδομένων όσο και της έλλειψης πόρων, η ερευνητική ομάδα αποφάσισε να δημιουργήσει μια απλή, όχι μαζική, αλλά, το σημαντικότερο, εκλεπτυσμένη διαδικασία επεξεργασίας μέχρι και την παραμικρή λεπτομέρεια.

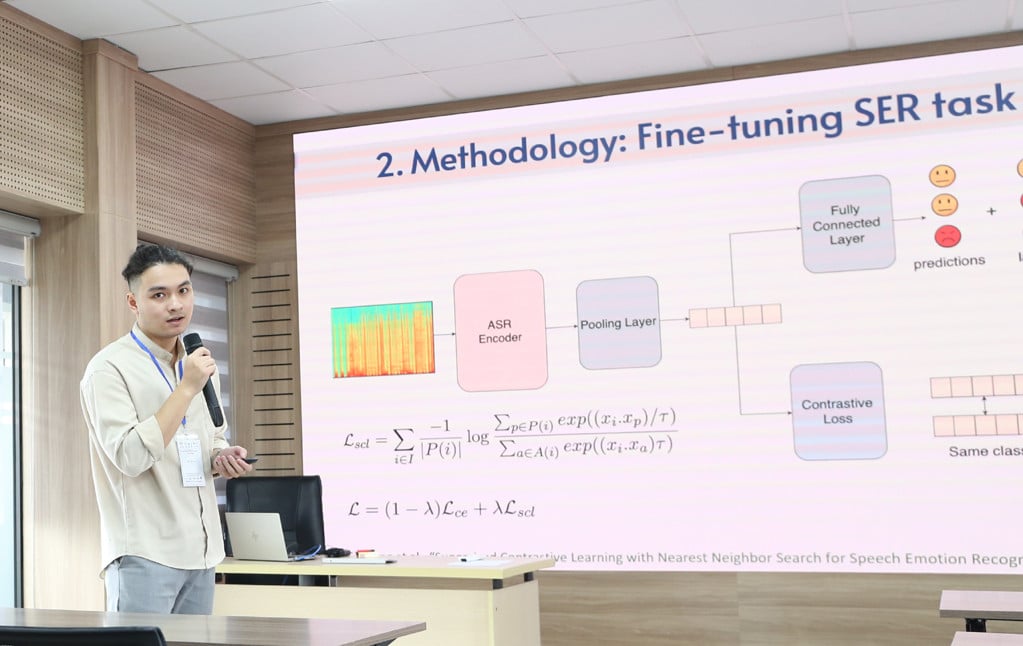

Οι μηχανικοί τεχνητής νοημοσύνης της Viettel μελέτησαν προσεκτικά τις τελευταίες έρευνες από κορυφαία συνέδρια και περιοδικά σε όλο τον κόσμο για να βρουν μια προσέγγιση. Σε συνδυασμό με μεθόδους επεξεργασίας δεδομένων για την εκπαίδευση του μοντέλου που ήταν αποτελεσματικές, η ερευνητική ομάδα δημιούργησε έναν κύκλο εκπαίδευσης για την επεξεργασία όλων των διαθέσιμων δεδομένων. Ο κύκλος περιλαμβάνει 3 βήματα: τη δημιουργία ενός προ-εκπαιδευμένου μοντέλου για την περιγραφή φωνητικών χαρακτηριστικών χωρίς ετικέτες, τη βελτιστοποίηση από το προ-εκπαιδευμένο μοντέλο για δύο προβλήματα: την αναγνώριση ομιλίας και την αναγνώριση συναισθημάτων, και την εξαγωγή συμπερασμάτων.

«Η εμπειρία από την επίλυση προβλημάτων με έλλειψη δεδομένων κατά την ανάπτυξη και την ανάπτυξη προηγούμενων προϊόντων συνέβαλε επίσης σημαντικά στην εύρεση μιας μεθόδου λήψης αποφάσεων από την ομάδα. Αντίθετα, οι γνώσεις και τα αποτελέσματα που αποκτήθηκαν από τη δοκιμή έχουν επίσης τη δυνατότητα να εφαρμοστούν άμεσα στα προϊόντα τεχνητής νοημοσύνης της Viettel, επομένως η διαδικασία εργασίας κατά τη διάρκεια της δοκιμής κύλησε αρκετά ομαλά», δήλωσε ο κ. Bui Tien Dat - Εικονικός Βοηθός Μηχανικός Πλατφόρμας, Viettel AI.

Ως αποτέλεσμα, η Viettel AI όχι μόνο κέρδισε το πρώτο βραβείο στις κατηγορίες Αναγνώριση Ομιλίας και Αναγνώριση Συναισθημάτων Ομιλίας, αλλά πέτυχε και μια εντυπωσιακή βαθμολογία 89,18% (οι επόμενες ομάδες ήταν 83,40% και 78,45% αντίστοιχα).

Ο κ. Σον είπε ότι ο βασικός παράγοντας έγκειται στο μοντέλο επεξεργασίας ομιλίας ειδικά για τα Βιετναμέζικα, το οποίο η Viettel AI έχει αναπτύξει εδώ και πολύ καιρό.

«Αντί να χρησιμοποιεί μοντέλα και οδηγίες από διαθέσιμα ερευνητικά αποτελέσματα, η Viettel AI επέλεξε να κατασκευάσει και να αναπτύξει το δικό της μοντέλο για την επεξεργασία βιετναμέζικου λόγου. Αυτό το μοντέλο ενημερώνεται, βελτιστοποιείται συνεχώς και γίνεται όλο και πιο αποτελεσματικό», δήλωσε ο κ. Son.

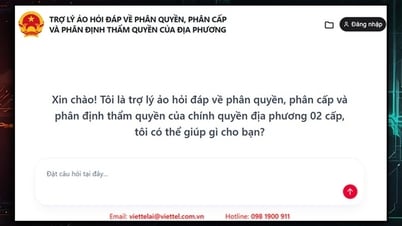

Αυτή η λύση της Viettel AI, όχι μόνο θα σταματήσει τον ανταγωνισμό, αλλά θα αποτελέσει και την προϋπόθεση για την αναβάθμιση των προϊόντων εικονικού τηλεφωνικού κέντρου, του εικονικού βοηθού της Viettel, βοηθώντας στην ακριβέστερη αναγνώριση των συναισθημάτων των πελατών στις συνομιλίες, παρέχοντας έτσι ανατροφοδότηση ή επιλέγοντας τις κατάλληλες αποχρώσεις των λέξεων. Έτσι, οι συνομιλίες μεταξύ ανθρώπων και AI θα γίνουν πιο φυσικές, βελτιώνοντας την εμπειρία του χρήστη. Πολλές νέες εφαρμογές στην εξυπηρέτηση πελατών ανοίγονται επίσης, όπως η δημιουργία ενός συστήματος για την αυτόματη αναγνώριση παραπόνων πελατών και παραπόνων στο τηλεφωνικό κέντρο για έγκαιρη διαχείριση ή αξιοποίηση πληροφοριών.

Ο εκπρόσωπος της μονάδας δήλωσε ότι η Viettel AI θα συνεχίσει να αναπτύσσει τεχνολογία, να αναβαθμίζει συνεχώς τα προϊόντα για να αυξήσει την ακρίβεια, να βελτιώσει την εμπειρία χρήστη και την αποδοτικότητα των προϊόντων.

Κουόκ Τουάν

[διαφήμιση_2]

Πηγή

![[Φωτογραφία] Ο Πρωθυπουργός Φαμ Μινχ Τσινχ προεδρεύει της θεματικής συνάντησης για τη νομοθετική διαδικασία τον Αύγουστο του 2025](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/4/ba42763cd48e4d7cba3481640b5ae367)

![[Φωτογραφία] Το Πολιτικό Γραφείο συνεργάζεται με τη Μόνιμη Επιτροπή της Επαρχιακής Επιτροπής του Κόμματος Λάι Τσάου](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/4/f69437b9ec3b4b0089a8d789d9749b44)

![[Φωτογραφία] Το Πολιτικό Γραφείο συνεργάζεται με τη Μόνιμη Επιτροπή της Κομματικής Επιτροπής της πόλης Καν Το](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/4/10461762301c435d8649f6f3bb07327e)

![[Φωτογραφία] Το Πολιτικό Γραφείο συνεργάζεται με τη Μόνιμη Επιτροπή της Κομματικής Επιτροπής του Πατριωτικού Μετώπου και τις Κεντρικές οργανώσεις](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/4/6f23e5c0f576484bb02b3aad08f9d26a)

![[Φωτογραφία] Ο Πρωθυπουργός παραδίδει αποφάσεις σχετικά με την πρόσληψη, τη μετάθεση και τον διορισμό επικεφαλής υπουργείων και οργανισμών](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/4/b2445ecfd89c48bdb3fafb13cde72cbb)

Σχόλιο (0)