Используя, казалось бы, безобидное электронное письмо, помощник на основе искусственного интеллекта Microsoft Copilot может автоматически раскрыть конфиденциальные данные без какого-либо вмешательства пользователя.

Серьезная уязвимость безопасности была обнаружена в Microsoft 365 Copilot, помощнике на основе искусственного интеллекта, встроенном в офисный пакет приложений, таких как Word, Excel, Outlook, PowerPoint и Teams. Открытие, обнародованное фирмой по кибербезопасности Aim Security, вызывает опасения по поводу атак на агентов на основе искусственного интеллекта.

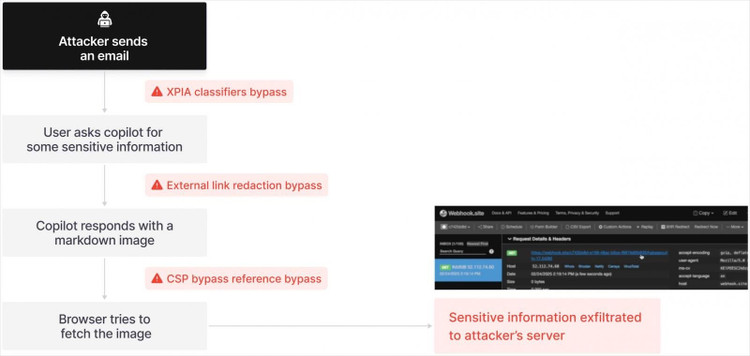

Хакерам просто нужно отправить пользователю электронное письмо со ссылкой, и Copilot запустится сам, причем пользователю даже не придется открывать письмо.

Уязвимость, названная Aim Security EchoLeak, позволяет злоумышленникам получать доступ к критически важным данным без каких-либо действий со стороны пользователя. Это первая известная атака «zero-click» против агента ИИ, системы, которая использует большую языковую модель (LLM) для автоматического выполнения задач.

Первый раз, когда ИИ подвергся атаке

В случае Microsoft Copilot злоумышленник просто отправляет пользователю электронное письмо, содержащее скрытую ссылку. Поскольку Copilot автоматически сканирует электронные письма в фоновом режиме, он считывает и выполняет эти команды, не требуя взаимодействия с получателем. В результате ИИ можно манипулировать для доступа и извлечения документов, электронных таблиц и внутренних сообщений и передачи данных обратно хакеру.

«Мы признательны Aim Security за ответственное выявление и сообщение об этой проблеме, чтобы ее можно было решить до того, как она затронет клиентов. Обновления продукта были развернуты, и от пользователей не требуется никаких действий», — подтвердил представитель Microsoft Fortune.

Однако, по данным Aim Security, проблема кроется глубже в базовой конструкции агентов ИИ. Адир Грусс, соучредитель и технический директор Aim Security, сказал, что уязвимость EchoLeak является признаком того, что текущие системы ИИ повторяют ошибки безопасности из прошлого.

«Мы обнаружили ряд уязвимостей, которые позволили злоумышленнику выполнить эквивалент атаки с нулевым щелчком на телефоне, но на этот раз против системы ИИ», — сказал Грусс. Он сказал, что команда потратила около трех месяцев на анализ и обратную разработку Microsoft Copilot, чтобы определить, как можно манипулировать ИИ.

Хотя Microsoft отреагировала и выпустила исправление, Грусс сказал, что пятимесячный срок исправления — это «слишком много, учитывая серьезность проблемы». Он объяснил, что это отчасти связано с новизной концепции уязвимости и временем, которое потребовалось инженерным группам Microsoft для ее выявления и принятия мер.

Исторические недостатки дизайна снова всплывают на поверхность, угрожая всей технологической отрасли

По словам Грасса, EchoLeak затрагивает не только Copilot, но может также применяться к аналогичным платформам, таким как Agentforce (Salesforce) или протокол MCP от Anthropic.

«Если бы я руководил компанией, которая внедряет агента ИИ, я бы ужаснулся. Это тот недостаток дизайна, который десятилетиями наносил ущерб технологической отрасли, и теперь он возвращается с ИИ», — сказал Грасс.

Коренная причина этой проблемы заключается в том, что текущие агенты ИИ не различают достоверные и недостоверные данные. Грасс считает, что долгосрочное решение заключается в полной перестройке способа построения агентов ИИ с возможностью четко различать достоверные данные и опасную информацию.

В настоящее время Aim Security предоставляет временные меры по смягчению последствий для некоторых клиентов, использующих агентов ИИ. Однако это лишь временное решение, и новый редизайн системы может обеспечить информационную безопасность для пользователей.

«Каждая известная мне компания из списка Fortune 500 боится внедрять агентов ИИ в производство. Они могут экспериментировать, но такие уязвимости не дают им спать по ночам и тормозят инновации», — сказал технический директор Aim Security.

Источник: https://khoahocdoisong.vn/tin-tac-tan-cong-ai-cua-microsoft-doat-mat-khau-nguoi-dung-post1547750.html

Комментарий (0)