В недавно опубликованном обновлении принципов развития ИИ материнская компания Google, Alphabet, рассказала о своих планах использования ИИ в будущем. В частности, компания отказалась от обещания не использовать ИИ для создания оружия, средств наблюдения или «технологий, которые могут нанести масштабный вред».

Красные линии Google в отношении ИИ

Термин «красная линия» в сфере ИИ Google впервые появился в 2018 году, когда сотрудники компании выступили с протестом против проекта Maven, разработанного компанией в рамках сотрудничества с Министерством обороны США. Тогда более 4000 сотрудников Google подписали петицию с требованием прекратить проект и прекратить «разработку технологий для войны».

Google затем не продлила контракт на разработку инструментов ИИ для Пентагона. Компания также обозначила красную черту, заявив, что «незаконные применения» ИИ, включая оружие и технологии, собирающие или использующие информацию для слежки, которые нарушают международно признанные нормы, также не будут использоваться Google. Технологии, которые причиняют или могут причинить вред обществу или нарушают общепризнанные принципы международного права и права человека, также не будут использоваться.

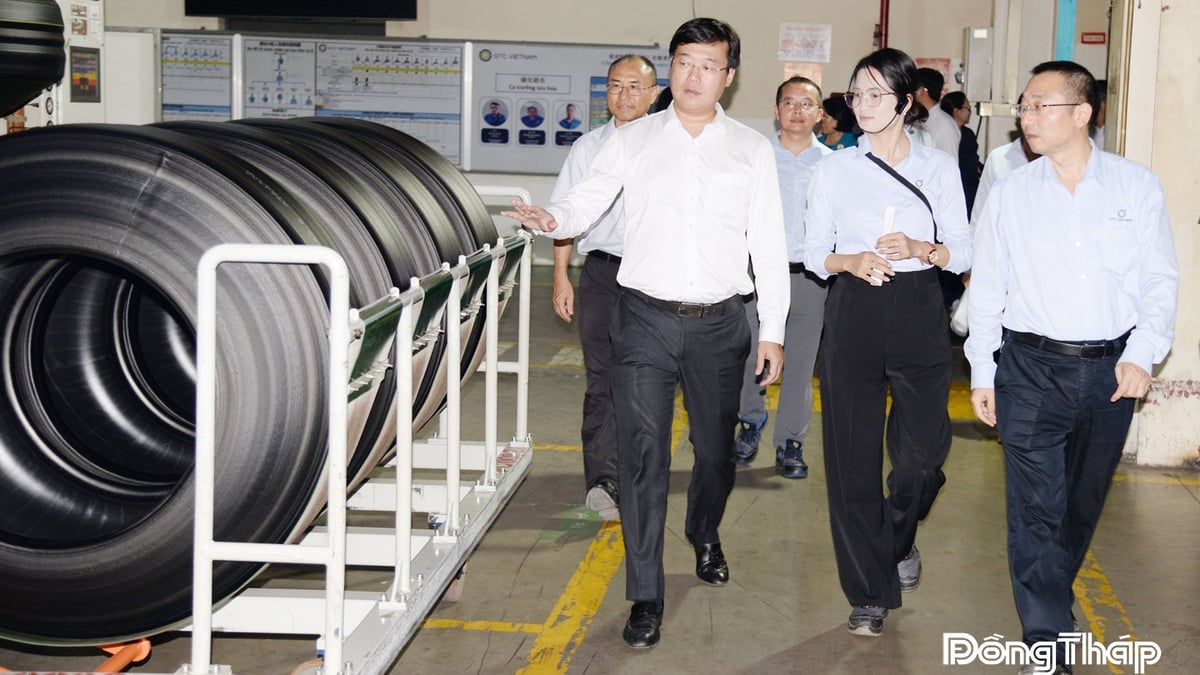

Некоторые приложения Google на iPhone

Решение провести красную черту между использованием ИИ в оружии не позволило Google принять участие в военных сделках, подписанных другими технологическими гигантами, включая Amazon и Microsoft.

Однако, столкнувшись с такими масштабными изменениями в гонке за ИИ, Google решила отказаться от своего обещания. Это вызвало массу споров не только внутри Google, но и продемонстрировало важный сдвиг в политике технологических компаний Кремниевой долины в оборонной промышленности.

Google разделена внутри

По данным Business Insider , обновление принципов и этики ИИ вызвало бурную реакцию со стороны сотрудников Google. Сотрудники выразили своё недовольство на внутренних форумах. Мем, изображающий генерального директора Сундара Пичаи, задающего поисковой системе Google вопрос «как стать поставщиком оружия?», привлёк большое внимание.

Другой сотрудник создал мем с вопросом: «Мы что, плохие парни, раз сняли запрет на использование ИИ для оружия и наблюдения?» В компании работает более 180 000 сотрудников. Возможно, ещё найдутся те, кто поддерживает решение Google о более тесном сотрудничестве с правительством США и его военными и оборонными заказчиками.

Аргументация Google

Представитель Google не сразу отреагировал на просьбу прокомментировать отмену «обещания ИИ». Однако глава отдела ИИ Демис Хассабис заявил, что руководящие принципы меняются в соответствии с меняющимся миром, и что ИИ будет «защищать национальную безопасность».

В сообщении в блоге компании Хассабис и Джеймс Манийка, старший вице-президент Google по технологиям и обществу, заявили, что по мере обострения глобальной конкуренции за лидерство в области ИИ, Google считает, что ИИ должен руководствоваться принципами свободы, равенства и уважения прав человека.

«Мы считаем, что компании, правительства и организации разделяют общие ценности и должны работать вместе над созданием ИИ, который сможет защищать людей, стимулировать глобальный рост и поддерживать национальную безопасность», — добавили они.

Два руководителя Google заявили, что миллиарды людей используют ИИ в повседневной жизни. Искусственный интеллект стал универсальной технологией, платформой, которую бесчисленное множество организаций и отдельных лиц используют для создания приложений. ИИ превратился из узкоспециализированной темы лабораторных исследований в технологию, столь же распространенную, как мобильные телефоны и интернет. Поэтому «Клятва ИИ» Google, данная в 2018 году, нуждается в соответствующей актуализации.

Alphabet заявила, что в следующем году планирует потратить 75 миллиардов долларов, в основном на развитие возможностей и инфраструктуры ИИ.

Источник: https://thanhnien.vn/google-rut-lai-loi-hua-khong-dung-ai-cho-quan-su-185250206161804981.htm

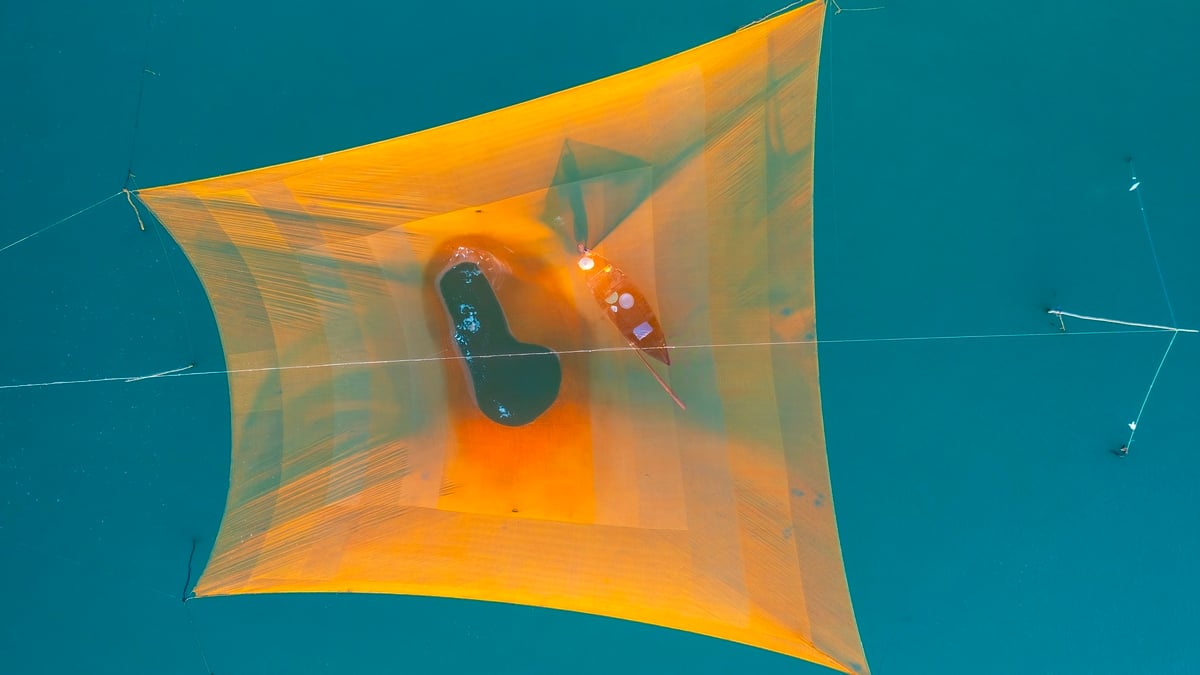

![[Фото] Откройте для себя «чудо» морского дна Джиа Лай](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/6/befd4a58bb1245419e86ebe353525f97)

![[Фото] Нге Ан: провинциальная дорога 543D серьёзно размыта из-за наводнения](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/5/5759d3837c26428799f6d929fa274493)

Комментарий (0)