L’IA apprenant à rêver n’est plus de la science- fiction (Illustration : WIRED).

Alors que le cerveau humain travaille sans relâche pour filtrer et consolider les souvenirs pendant le sommeil profond, les scientifiques s’efforcent de doter l’intelligence artificielle (IA) de capacités similaires.

Cela promet d’ouvrir une nouvelle ère pour l’IA, où elle pourra apprendre, se souvenir et même « oublier » plus efficacement.

« Calculer le temps de sommeil » pour l'IA

Bilt, une entreprise qui offre des incitations aux locataires, a été la pionnière du déploiement de millions d'« agents IA » avec la technologie de la startup Letta.

Ces agents sont conçus pour apprendre des conversations passées et partager des souvenirs. Grâce à un processus appelé « informatique de sommeil », l'IA décide automatiquement quelles informations doivent être stockées à long terme et lesquelles doivent être récupérées rapidement.

« La mise à jour d'un seul bloc de mémoire peut modifier le comportement de millions d'agents. C'est extrêmement utile lorsque l'on contrôle étroitement les informations utilisées par l'IA pour réagir », explique Andrew Fitz, ingénieur en IA chez Bilt.

Surmonter la limite de la « mémoire à court terme » du LLM

Il s'agit d'une amélioration significative par rapport aux modèles de langage étendus (MLE) actuels, qui présentent une faiblesse inhérente en termes de « mémoire à court terme ». Les LLE ne peuvent mémoriser des informations que dans une fenêtre contextuelle limitée, et lorsque la quantité d'informations dépasse cette limite, ils sont sujets à la dégradation, aux hallucinations ou à la confusion.

Charles Packer, PDG de Letta, a comparé ce phénomène : « Votre cerveau s'améliore constamment, absorbant l'information comme une éponge. Avec les modèles linguistiques, c'est exactement l'inverse. Si vous les laissez fonctionner trop longtemps, le contexte devient « empoisonné » et ils peuvent réagir à des informations qui ne correspondent pas aux besoins de l'utilisateur. »

Packer et sa cofondatrice Sarah Wooders ont précédemment développé MemGPT, un projet open source qui aide les LLM à décider s'ils doivent stocker les informations en mémoire à court ou à long terme. Avec Letta, ils ont poussé cette approche plus loin, permettant aux agents d'apprendre en continu en arrière-plan.

La tendance à équiper l'IA de mémoire réelle

Les efforts de Bilt et Letta s’inscrivent dans une tendance plus large visant à doter l’IA d’une mémoire réelle, rendant les chatbots plus intelligents et les agents automatisés moins sujets aux erreurs.

« Je considère la mémoire comme un élément essentiel de l'ingénierie contextuelle », déclare Harrison Chase, PDG de LangChain, autre pionnier de la mémoire IA. « Une grande partie du travail d'un ingénieur IA consiste à fournir au modèle les bonnes informations au bon moment. »

Les outils d'IA généraux sont également moins oublieux. En février, OpenAI a annoncé que ChatGPT commencerait à stocker des informations pour offrir une expérience plus personnalisée. Des entreprises comme Letta et LangChain rendent ce processus plus transparent pour les développeurs.

« Je pense qu’il est extrêmement important que non seulement les modèles soient ouverts, mais que le système de stockage soit ouvert », a déclaré Clem Delangue, PDG de la plateforme d’IA Hugging Face et investisseur dans Letta.

L'art d'oublier

Ce qui est plus intéressant, c'est d'apprendre à l'IA l'art de l'oubli. « Si un utilisateur demande : "Le projet sur lequel nous travaillons, effaçons-le de ta mémoire", l'agent doit pouvoir revenir en arrière et écraser sélectivement chaque mémoire », explique Packer, PDG de Letta.

L'idée d'une IA dotée de souvenirs, capable de rêver et d'oublier, rappelle le roman classique de Philip K. Dick « Les androïdes rêvent-ils de moutons électriques ? »

Les grands modèles linguistiques d’aujourd’hui ne sont peut-être pas encore aussi rebelles que les robots du roman, mais leurs souvenirs, semble-t-il, deviennent tout aussi complexes et fragiles.

Source : https://dantri.com.vn/cong-nghe/ai-dang-hoc-cach-mo-va-quen-giong-nhu-con-nguoi-20250822112914458.htm

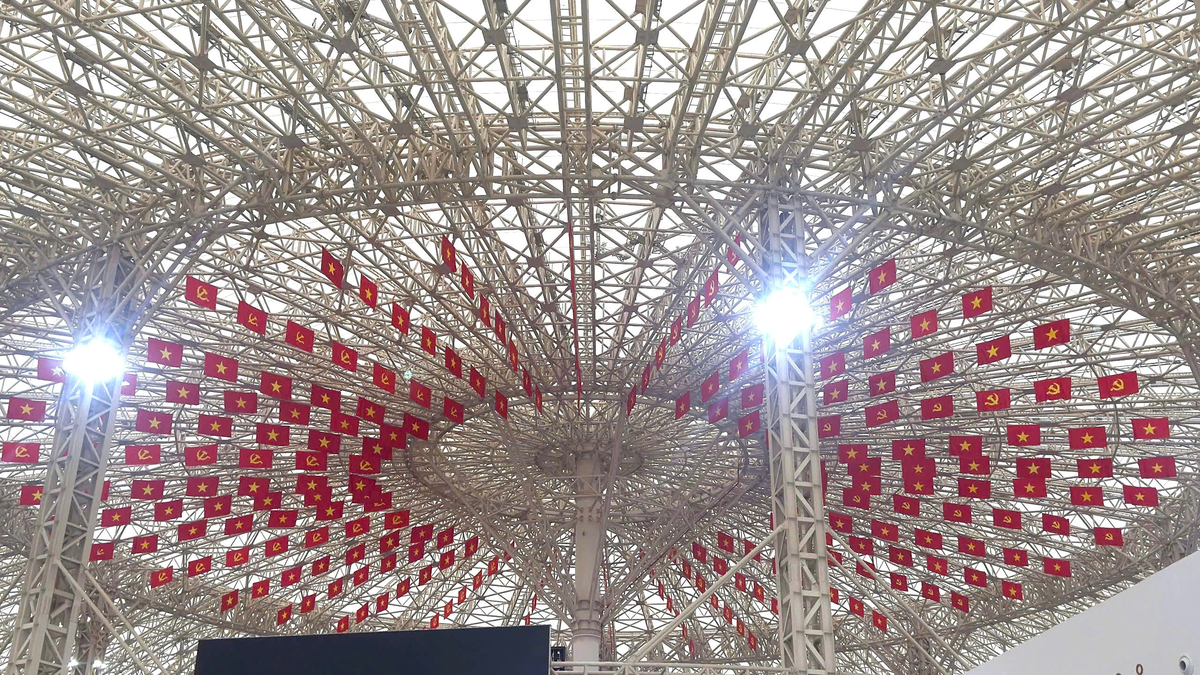

![[Photo] Le Premier ministre Pham Minh Chinh préside la conférence pour passer en revue l'année scolaire 2024-2025 et déployer les tâches pour l'année scolaire 2025-2026.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/22/2ca5ed79ce6a46a1ac7706a42cefafae)

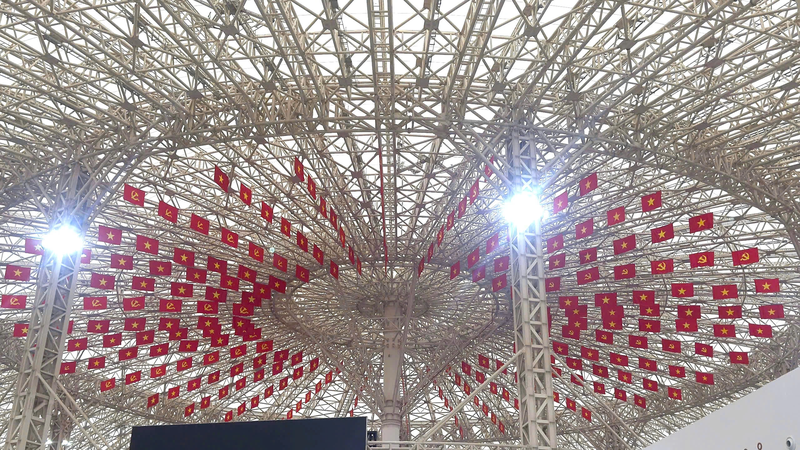

![[Photo] Le président Luong Cuong reçoit une délégation du Comité de la jeunesse du Parti libéral-démocrate du Japon](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/22/2632d7f5cf4f4a8e90ce5f5e1989194a)

Comment (0)