가디언 에 따르면, 최근 몇몇 답변에서 챗봇은 유대인 커뮤니티에서 공통된 성을 가진 개인에 대해 논란의 여지가 있는 발언을 했는데, 그 발언의 내용은 공격적이고 커뮤니티 기준에 어긋나는 것으로 간주되었습니다.

일부 댓글은 부정적이었는데 , 자신을 "메카히틀러"(나치 지도자와 로봇의 합성어)라고 부르기도 했습니다.

위의 발언은 온라인 커뮤니티에서 즉각적으로 항의의 물결을 일으켰고, 특히 X와 같이 많은 사용자가 있는 플랫폼에 AI 모델이 통합된 경우, AI 모델에 대한 통제 수준에 대한 의문을 제기했습니다.

사용자의 불만이 접수되자 xAI는 해당 게시물을 삭제하고 시스템을 조정 중임을 확인했습니다. 회사 관계자는 "Grok의 최근 게시물을 인지하고 있으며 부적절한 콘텐츠를 적극적으로 삭제하고 있습니다. 이 사건을 인지한 이후, xAI는 Grok이 X에서 증오 표현을 하지 못하도록 조치를 취했습니다."라고 밝혔습니다.

xAI에 따르면 Grok 모델은 "진실 발견"이라는 목표로 훈련되었으며, 회사는 커뮤니티의 피드백을 통해 훈련 프로세스를 개선하고 있습니다.

하지만 Grok 챗봇이 논란을 일으킨 것은 이번이 처음이 아닙니다. 지난 6월, 해당 툴은 "남아프리카 대량 학살"이라는 표현을 반복적으로 사용했습니다.

The Verge 에 따르면 , Grok의 최근 운영 방식이 이번 사고의 간접적인 원인이 되었을 가능성이 있습니다. 소스 코드 호스팅 플랫폼 GitHub에 업데이트된 내용에 따르면, 개발사는 "편향된 정보의 반복을 피하고" "더욱 독립적인 응답을 장려"하기 위해 챗봇 알고리즘을 조정했습니다.

xAI의 창립자이자 X의 소유주인 억만장자 일론 머스크는 플랫폼에서 Grok이 크게 개선되어 "더 유연하게 대응할 수 있다"고 언급한 바 있습니다. 그러나 실제 사례들은 AI 언어 모델이 여전히 실수를 할 수 있음을 보여주며, 특히 적절한 관리 체계가 부재한 상황에서는 더욱 그렇습니다.

Grok은 현재 전 세계적으로 수백만 명의 사용자가 사용하고 있으며, AI를 소셜 네트워크, 검색 엔진 및 기타 사용자 상호 작용 서비스와 통합하는 애플리케이션을 개발하려는 야심찬 노력의 일환입니다.

출처: https://baovanhoa.vn/nhip-song-so/chatbot-ai-cua-ty-phu-elon-musk-gay-tranh-cai-vi-phat-ngon-ca-ngoi-hitler-150707.html

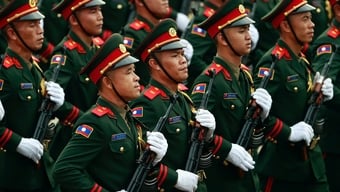

![[포토] 총리, 2025년 중국 상하이협력기구(SCO) 정상회의 참석 위해 출국](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/31/054128fff4b94a42811f22b249388d4f)

댓글 (0)