Meta និយាយថា AI Studio នឹងអនុញ្ញាតឱ្យអ្នកប្រើប្រាស់បង្កើតតួអក្សរ AI ជាមួយនឹងបុគ្គលិកលក្ខណៈ ចរិតលក្ខណៈ និងចំណាប់អារម្មណ៍ផ្ទាល់ខ្លួន ហើយនឹងអនុញ្ញាតឱ្យអ្នកបង្កើត Instagram ប្រើតួអក្សរ AI ជាការចម្លងឌីជីថលរបស់ពួកគេដើម្បីធ្វើអន្តរកម្មជាមួយអ្នកតាមក្នុងសារផ្ទាល់។

រូបភាព៖ រ៉យទ័រ

អ្នកប្រើប្រាស់អាចចែករំលែកតួអក្សរ AI របស់ពួកគេនៅលើវេទិកាផ្សេងៗរបស់ប្រព័ន្ធផ្សព្វផ្សាយសង្គមយក្ស។

Meta និយាយថា AI Studio នឹងចាប់ផ្តើមដាក់ឱ្យប្រើប្រាស់សម្រាប់អ្នកប្រើប្រាស់ Instagram Business ចាប់ពីថ្ងៃទី 29 ខែកក្កដា ហើយនឹងមានសម្រាប់អ្នកប្រើប្រាស់ Meta ទាំងអស់នៅសហរដ្ឋអាមេរិកក្នុងប៉ុន្មានសប្តាហ៍ខាងមុខនេះ។ ឧបករណ៍នេះនឹងអាចចូលប្រើបាននៅ ai.meta.com/ai-studio និងតាមរយៈកម្មវិធី Instagram ជាមួយនឹង chatbots ក៏អាចចូលប្រើបានតាមរយៈ WhatsApp, Messenger និងគេហទំព័រផងដែរ។

នាយកប្រតិបត្តិ Meta លោក Mark Zuckerberg បាននិយាយថា AI chatbots ដែលត្រូវបានជ្រើសរើសដោយខ្លួនឯងទាំងនេះ អាចត្រូវបានប្រើសម្រាប់ការកម្សាន្ត ឬជាឧបករណ៍ជំនួយផ្ទាល់ខ្លួន ដូចជាការលេងតួនាទី របៀបស្នើសុំដំឡើងថ្លៃ ឬដោះស្រាយជម្លោះជាមួយមិត្តភក្តិជាដើម។ លោកបានបន្តថា៖ «អ្នកអាចដើរតួជាមូលដ្ឋាន និងមើលពីរបៀបដែលការសន្ទនានឹងទៅ ហើយទទួលបានមតិកែលម្អលើវា»។

ក្រុមហ៊ុននិយាយថា AI Studio នឹងអនុញ្ញាតឱ្យអ្នកប្រើប្រាស់កំណត់ថាតើនរណាដែល chatbot ធ្វើអន្តរកម្មជាមួយ និងការពារវាពីការពិភាក្សាអំពីប្រធានបទមួយចំនួន។ គោលការណ៍ប្រើប្រាស់ AI Studio ហាមឃាត់អ្នកប្រើប្រាស់ពីការតំណាងឱ្យនរណាម្នាក់ក្រៅពីខ្លួនគេ។ វាក៏នឹងដាក់កម្រិតលើតួរលេខប្រវត្តិសាស្ត្រ តួរអង្គសាសនា ឃាតករដ៏ធំ ឬ "មុខវិជ្ជាដែលអាចចាត់ទុកថាគួរឱ្យស្អប់ខ្ពើម ឬខុសច្បាប់"។

ឧបករណ៍ថ្មីនេះត្រូវបានបង្កើតឡើងនៅលើ Meta's Llama 3.1 ដែលជាកំណែចុងក្រោយបំផុតនៃគំរូបញ្ញាសិប្បនិមិត្តឥតគិតថ្លៃរបស់ខ្លួនដែលបានចេញផ្សាយកាលពីសប្តាហ៍មុន ដែលអាចប្រើបានជាច្រើនភាសា និងមានឧបករណ៍វាស់ស្ទង់ប្រតិបត្តិការដែលប្រជែងនឹងម៉ូដែលបង់ប្រាក់ពីគូប្រជែងដូចជា OpenAI ។

សៀវភៅណែនាំ AI Studio របស់ Meta និយាយថា អ្នកប្រើប្រាស់អាចប្ដូរតាមបំណង chatbot ដោយផ្តល់នូវការពិពណ៌នាលម្អិត រួមជាមួយនឹងឈ្មោះ និងរូបភាព ហើយបន្ទាប់មកបញ្ជាក់ពីរបៀបដែល chatbot គួរឆ្លើយតបទៅនឹងការបញ្ចូលជាក់លាក់។ បន្ទាប់មក Llama នឹងកែលម្អការឆ្លើយតបរបស់ខ្លួនដោយផ្អែកលើការណែនាំទាំងនោះ។

ង៉ុក អាញ់ (យោងតាម Wired, Reuters)

ប្រភព៖ https://www.congluan.vn/meta-cho-phep-nguoi-dung-tu-tao-chatbot-ai-cho-rieng-minh-post305489.html

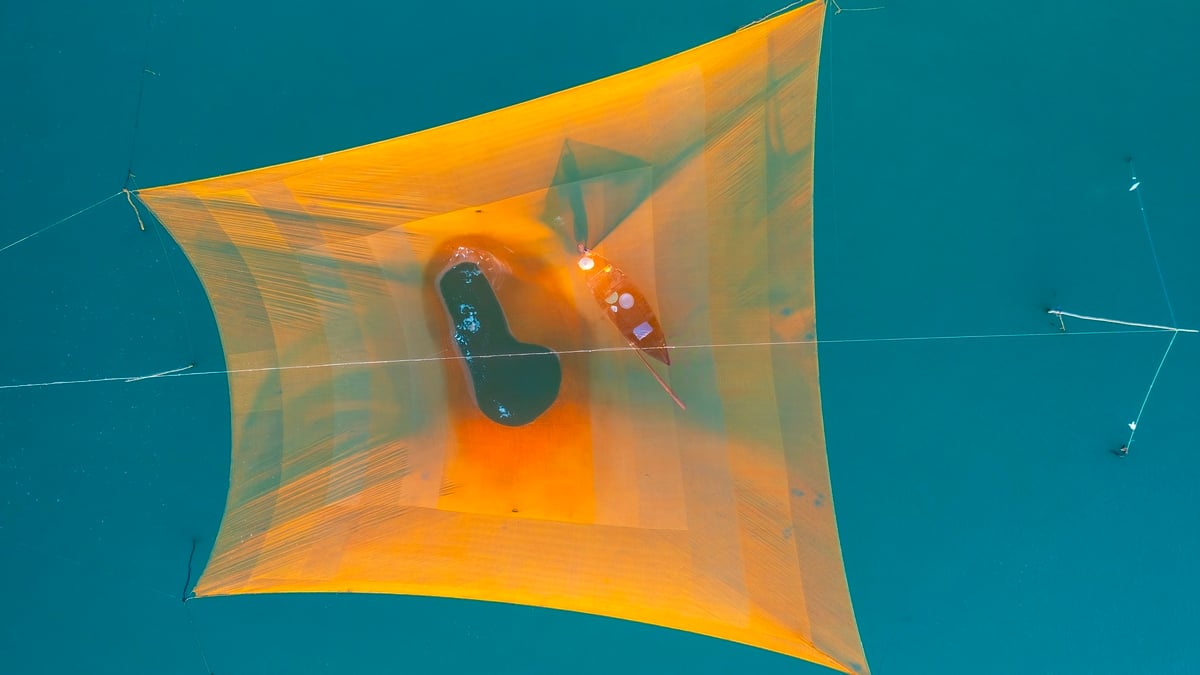

![[រូបថត] ស្វែងយល់ពី "អច្ឆរិយៈ" នៅក្រោមសមុទ្រ Gia Lai](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/6/befd4a58bb1245419e86ebe353525f97)

![[រូបថត] Nghe An: ផ្លូវខេត្ត 543D បានបាក់យ៉ាងធ្ងន់ធ្ងរដោយសារទឹកជំនន់](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/5/5759d3837c26428799f6d929fa274493)

Kommentar (0)