Nvidia mengumumkan serangkaian produk baru di acara pengembangnya pada 18 Maret untuk memperkuat posisinya di pasar kecerdasan buatan (AI). Harga saham produsen chip ini telah meningkat 54 kali lipat dan pendapatannya meningkat lebih dari tiga kali lipat sejak ChatGPT memulai persaingan AI global pada akhir 2022. GPU server kelas atas Nvidia sangat penting untuk pelatihan dan penerapan model bahasa berskala besar, dengan perusahaan seperti Microsoft dan Meta menghabiskan miliaran dolar untuk chip tersebut.

Nvidia menyebut chip AI generasi terbarunya Blackwell. Chip Blackwell pertama, GB200, akan tersedia akhir tahun ini. Nvidia menawarkan chip yang lebih bertenaga kepada pelanggan untuk memacu pesanan baru. Pelanggan masih berebut untuk mendapatkan chip H100 Hopper.

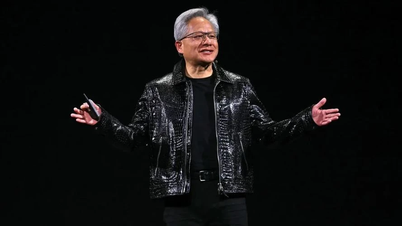

“Hopper memang hebat, tetapi kami membutuhkan GPU yang lebih besar,” kata CEO Nvidia Jensen Huang di acara tersebut.

Bersamaan dengan chip Blackwell, Nvidia juga memperkenalkan perangkat lunak NIM yang memudahkan penerapan AI. Para pejabat Nvidia mengatakan perusahaan ini kini lebih menjadi penyedia platform seperti Apple dan Microsoft, alih-alih pemasok chip.

"Blackwell bukan sebuah chip, melainkan nama sebuah platform," ujar Huang. Wakil Presiden Nvidia, Manuvir Das, berjanji bahwa perangkat lunak NIM akan membantu para pengembang menjalankan program di GPU Nvidia apa pun, baik lama maupun baru, untuk menjangkau lebih banyak orang.

Blackwell, "penerus" Hopper

Setiap dua tahun, Nvidia memperbarui arsitektur GPU-nya, membuka peningkatan performa baru. Banyak model AI yang dirilis tahun lalu dilatih menggunakan arsitektur Hopper, yang akan tersedia mulai tahun 2022.

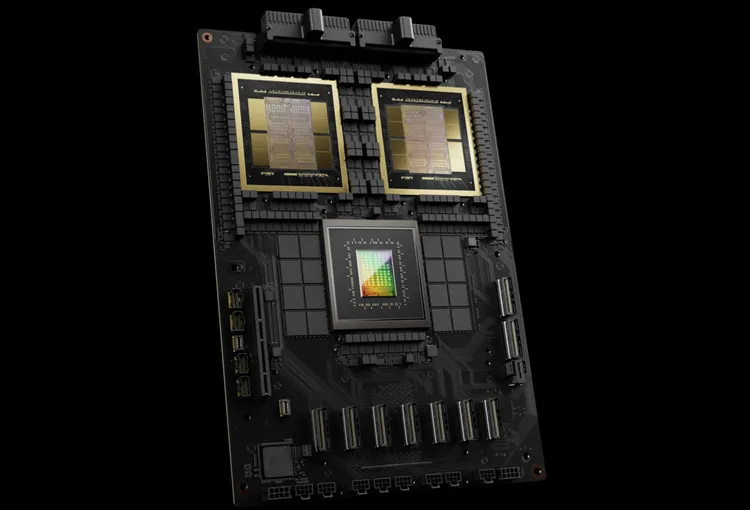

Nvidia menyatakan bahwa chip berbasis Blackwell seperti GB200 menawarkan peningkatan performa yang signifikan bagi bisnis AI, menghasilkan 20 petaflops dibandingkan dengan 4 petaflops pada H100. Daya pemrosesan ini memungkinkan bisnis AI untuk melatih model yang lebih besar dan lebih kompleks.

GPU Blackwell berukuran besar dan menggabungkan dua dies yang diproduksi secara terpisah menjadi satu chip. GPU ini juga tersedia sebagai server lengkap yang disebut GB200 NVLink 2, yang menggabungkan 72 GPU Blackwell dan komponen Nvidia lainnya yang dirancang untuk melatih model AI.

Amazon, Google, Microsoft, dan Oracle akan menjual akses ke GB200 melalui layanan cloud. GB200 menggabungkan dua GPU B200 Blackwell dengan sebuah CPU Grace. Nvidia mengatakan Amazon Web Services (AWS) akan membangun klaster server dengan 20.000 chip GB200.

Sistem ini dapat menjalankan model dengan 27 triliun parameter, jauh lebih besar daripada model terbesar yang tersedia saat ini, seperti GPT-4 (1,7 triliun parameter). Banyak peneliti AI percaya bahwa model yang lebih besar dengan lebih banyak parameter dan data dapat membuka kemampuan baru.

Nvidia belum mengumumkan harga untuk GB200 baru atau sistem yang menyertakan GB200. H100 berbasis Hopper dari Nvidia dibanderol antara $25.000 dan $40.000 per unit, sementara keseluruhan sistemnya mencapai $200.000, menurut perkiraan analis.

(Menurut CNBC)

[iklan_2]

Sumber

![[Foto] Rombongan parade berpamitan kepada masyarakat usai menyelesaikan misi A80](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/2/36d202d43ecc4ca8aede59a0e99f32ed)

![[Foto] Polisi menghalangi parade di Jalan Le Duan](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/2/8f607af025d5437d828366c5e911bbda)

![[Foto] Suasana ramai di Alun-alun Ba Dinh pada Hari Nasional](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/2/c441c931800d4ff8a4a5b2ed4d4c496b)

![[Foto] Tentara berbaris dengan gagah di jalan sambil bersorak-sorai.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/2/c0dc9a5121094991bd7c5a02166b3a4f)

![[Foto] Momen heroik dan indah saat kendaraan lapis baja melewati Menara Bendera Hanoi](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/2/5b07b9f62ee94db287a0ae3a27b6db51)

![[Langsung] Parade dan pawai untuk merayakan ulang tahun ke-80 Revolusi Agustus dan Hari Nasional 2 September](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/9/2/ab9a5faafecf4bd4893de1594680b043)

Komentar (0)