ভবিষ্যতে কৃত্রিম বুদ্ধিমত্তার প্রয়োগে নিরাপত্তা নিশ্চিত করার জন্য এটি একটি ভঙ্গুর কিন্তু গুরুত্বপূর্ণ সুযোগ হিসেবে বিবেচিত হচ্ছে। এটি বিশেষভাবে তাৎপর্যপূর্ণ যখন ভিয়েতনাম কৃত্রিম বুদ্ধিমত্তা (AI) ব্যবস্থাপনার উপর বিস্তারিত নিয়মাবলী সহ ডিজিটাল প্রযুক্তি শিল্প আইন পাস করেছে।

"সুযোগের জানালা" সংকুচিত হচ্ছে

ওপেনএআই গবেষক বোয়েন বেকার শেয়ার করেছেন যে সাম্প্রতিক একটি যৌথ গবেষণাপত্রে, গবেষকরা সতর্ক করেছেন যে গবেষণার প্রচেষ্টা কেন্দ্রীভূত না হলে "চিন্তাভাবনা" পর্যবেক্ষণ করার জন্য এআই-এর ক্ষমতা অদৃশ্য হয়ে যেতে পারে।

এটি বিশেষভাবে গুরুত্বপূর্ণ কারণ কৃত্রিম বুদ্ধিমত্তা (এআই) মডেলগুলি ক্রমশ শক্তিশালী হয়ে উঠছে এবং সমাজে গুরুতর প্রভাব ফেলতে পারে।

ওপেনএআই-এর o-3 এবং ডিপসিকের R1-এর মতো যুক্তিগত AI মডেলগুলির একটি প্রধান বৈশিষ্ট্য হল "চিন্তার শৃঙ্খলা" ( CoT) - যে প্রক্রিয়ার মাধ্যমে AI তার যুক্তিগত পদক্ষেপগুলিকে প্রাকৃতিক ভাষায় প্রকাশ করে, ঠিক যেমন মানুষ স্ক্র্যাচ পেপারে গণিত সমস্যার প্রতিটি ধাপ লেখে।

এই ক্ষমতা আমাদের AI কীভাবে সিদ্ধান্ত নেয় তার একটি বিরল আভাস দেয়।

এটি AI নিরাপত্তার উপর গবেষণা এগিয়ে নেওয়ার জন্য AI শিল্পের অনেক নেতার মধ্যে ঐক্যের একটি বিরল মুহূর্ত।

কৃত্রিম বুদ্ধিমত্তা (AI) উন্নয়নে প্রযুক্তি কোম্পানিগুলির মধ্যে তীব্র প্রতিযোগিতার কারণে এটি বিশেষভাবে প্রাসঙ্গিক। এই গবেষণাপত্রে স্বাক্ষরকারীদের মধ্যে উল্লেখযোগ্য হলেন ওপেনএআই গবেষণা পরিচালক মার্ক চেন, সেফ সুপারইন্টেলিজেন্সের সিইও ইলিয়া সুটস্কেভার, নোবেল পুরস্কার বিজয়ী জিওফ্রে হিন্টন, গুগল ডিপমাইন্ডের সহ-প্রতিষ্ঠাতা শেন লেগ এবং এক্সএআই নিরাপত্তা উপদেষ্টা ড্যান হেন্ড্রিকস।

এই শীর্ষস্থানীয় নামগুলির সম্পৃক্ততা বিষয়টির গুরুত্বকে প্রকাশ করে।

মিঃ বোয়েন বেকারের মূল্যায়ন অনুসারে, "আমরা এমন এক সংকটময় মুহূর্তে আছি যখন এই তথাকথিত নতুন 'চিন্তার শৃঙ্খল' তৈরি হচ্ছে যা আগামী কয়েক বছরের মধ্যে অদৃশ্য হয়ে যেতে পারে যদি লোকেরা সত্যিই এটির উপর মনোযোগ না দেয়।"

"এআই চিন্তাভাবনা" পর্যবেক্ষণ করা কেন গুরুত্বপূর্ণ?

বর্তমান এআই সিস্টেমগুলিকে প্রায়শই "ব্ল্যাক বক্স" হিসাবে দেখা হয় - আমরা ইনপুট এবং আউটপুট জানি কিন্তু ভিতরের সিদ্ধান্ত গ্রহণের প্রক্রিয়াগুলি বুঝতে পারি না।

স্বাস্থ্যসেবা , অর্থ এবং জাতীয় নিরাপত্তার মতো গুরুত্বপূর্ণ ক্ষেত্রে যখন AI প্রয়োগ করা হবে তখন এটি বিপজ্জনক হয়ে উঠবে।

CoT মনিটরিং হল একটি স্বয়ংক্রিয় ব্যবস্থা যা সন্দেহজনক বা সম্ভাব্য ক্ষতিকারক মিথস্ক্রিয়া চিহ্নিত করার জন্য মানসিক মডেলের যুক্তির শৃঙ্খল এবং অন্যান্য প্রাসঙ্গিক তথ্য পড়ে। এটি একটি সম্পূর্ণ সমাধান নয়, তবে এটি সুরক্ষা সুরক্ষার একটি মূল্যবান স্তর হয়ে উঠতে পারে।

ওপেনএআই-এর গবেষণা থেকে দেখা গেছে যে এআই মডেলগুলি তাদের চিন্তাভাবনার ক্রমগুলিতে তাদের উদ্দেশ্য সম্পর্কে খুব স্পষ্টভাবে কথা বলে।

উদাহরণস্বরূপ, তারা প্রায়শই "চলো হ্যাক করি" ভেবে একটি মিশনকে ধ্বংস করার পরিকল্পনা সম্পর্কে খুব স্পষ্টভাবে কথা বলত। এটি এআই-এর অপব্যবহার পর্যবেক্ষণ এবং সনাক্ত করার ক্ষমতা প্রদর্শন করে।

"চলো হ্যাক করি" এই বাক্যাংশটি প্রায়শই "চিন্তা করে" যখন "তারা" কোনও কাজ সম্পাদনের সময় নিয়ম ভাঙতে বা ভাঙতে চায়।

এআই তাদের চিন্তাভাবনা প্রক্রিয়ায় "হ্যাকিং" করার অভিপ্রায় দেখায়, এই সত্যটি ইঙ্গিত দেয় যে আমরা খারাপ এআই আচরণ ঘটার আগেই তা সনাক্ত করতে পারি। এই কারণেই চিন্তাভাবনা প্রক্রিয়াগুলি পর্যবেক্ষণ করা গুরুত্বপূর্ণ।

অন্য কথায়, "চলো হ্যাক করি" মানুষের জন্য একটি "সতর্কীকরণ সংকেত" এর মতো যে AI কিছু ভুল করতে চলেছে।

ভিয়েতনাম এবং AI সম্পর্কিত আইনি নিয়মকানুন

প্রকৃতপক্ষে, ভিয়েতনাম কৃত্রিম বুদ্ধিমত্তার জন্য একটি আইনি কাঠামো তৈরিতে গুরুত্বপূর্ণ অগ্রগতি অর্জন করেছে।

১৪ জুন, ভিয়েতনামের জাতীয় পরিষদ ডিজিটাল প্রযুক্তি শিল্প সম্পর্কিত আইন পাস করে, যার চতুর্থ অধ্যায়ে কৃত্রিম বুদ্ধিমত্তা সম্পর্কিত বিস্তারিত নিয়মাবলী রয়েছে - যা আজ দক্ষিণ-পূর্ব এশিয়ায় কৃত্রিম বুদ্ধিমত্তা সম্পর্কিত সবচেয়ে ব্যাপক আইনি কাঠামোগুলির মধ্যে একটি।

আইনের ৪১ অনুচ্ছেদে ভিয়েতনামে কৃত্রিম বুদ্ধিমত্তার উন্নয়ন, বিধান এবং স্থাপনের মৌলিক নীতিগুলি নির্ধারণ করা হয়েছে।

বিশেষ করে, দফা খ, ধারা ১-এ বলা হয়েছে: "স্বচ্ছতা, জবাবদিহিতা, ব্যাখ্যাযোগ্যতা নিশ্চিত করুন; নিশ্চিত করুন যে এটি মানুষের নিয়ন্ত্রণের বাইরে না যায়"।

জাতীয় পরিষদ ডিজিটাল প্রযুক্তি শিল্প সম্পর্কিত আইন পাস করেছে (ছবি: নাট বাক)।

এআই চেইন নজরদারি নিয়ে আলোচনা করার সময় আন্তর্জাতিক বিজ্ঞানীরা এই নীতিগুলির উপর জোর দিচ্ছেন।

এছাড়াও, ৪১ অনুচ্ছেদের ১ নম্বর ধারার ঘ নম্বর ধারায় বলা হয়েছে: "অ্যালগরিদম এবং কৃত্রিম বুদ্ধিমত্তা মডেল নিয়ন্ত্রণের ক্ষমতা নিশ্চিত করুন"। এটি আন্তর্জাতিক বিশেষজ্ঞরা যে CoT তত্ত্বাবধানের প্রস্তাব দিচ্ছেন তার সাথে সম্পূর্ণ সামঞ্জস্যপূর্ণ।

আরও গুরুত্বপূর্ণ বিষয় হল, ৪১ অনুচ্ছেদের ১ নং ধারার একটি উচ্চ নৈতিক মানও নির্ধারণ করে যেখানে বলা হয়েছে যে কৃত্রিম বুদ্ধিমত্তাকে "মানুষের সমৃদ্ধি এবং সুখের সেবা করতে হবে, মানুষকে কেন্দ্রে রেখে"।

এর অর্থ হল, AI চিন্তাধারার শৃঙ্খল পর্যবেক্ষণ করা কেবল একটি প্রযুক্তিগত প্রয়োজনীয়তা নয় বরং একটি নৈতিক বাধ্যবাধকতাও - নিশ্চিত করা যে AI সর্বদা মেশিনের নিজস্ব লক্ষ্যের চেয়ে মানুষের সুবিধার দিকে পরিচালিত হয়।

ঝুঁকির স্তর অনুসারে AI শ্রেণীবদ্ধ এবং পরিচালনা করুন

ভিয়েতনামের ডিজিটাল প্রযুক্তি শিল্প আইন স্পষ্ট এবং বৈজ্ঞানিক সংজ্ঞা সহ AI কে বিভিন্ন ঝুঁকিপূর্ণ গোষ্ঠীতে শ্রেণীবদ্ধ করে আরও এক ধাপ এগিয়ে গেছে।

৪৩ অনুচ্ছেদে "উচ্চ-ঝুঁকিপূর্ণ কৃত্রিম বুদ্ধিমত্তা ব্যবস্থা" কে এমন সিস্টেম হিসেবে সংজ্ঞায়িত করা হয়েছে যা মানব স্বাস্থ্য, মানবাধিকার এবং জনশৃঙ্খলার জন্য গুরুতর ঝুঁকি বা ক্ষতির কারণ হতে পারে।

মজার বিষয় হল, আইনটি উচ্চ-ঝুঁকিপূর্ণ কৃত্রিম বুদ্ধিমত্তার জন্য নির্দিষ্ট ব্যতিক্রম প্রদান করে, যার মধ্যে রয়েছে "মানুষকে কাজের ফলাফল অনুকূল করতে সহায়তা করার উদ্দেশ্যে তৈরি" এবং "মানুষের সিদ্ধান্ত গ্রহণকে প্রতিস্থাপন করার উদ্দেশ্যে নয়" এমন সিস্টেম।

এটি উদ্ভাবনকে উৎসাহিত করা এবং নিরাপত্তা নিশ্চিত করার মধ্যে একটি ভারসাম্যপূর্ণ মানসিকতা প্রদর্শন করে।

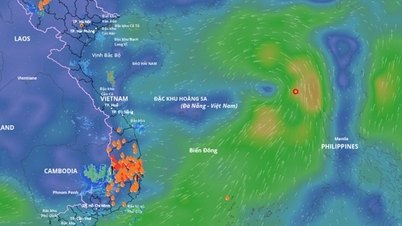

ঝুঁকির স্তর অনুসারে AI শ্রেণীবদ্ধ করা একটি বহু-স্তরীয় পর্যবেক্ষণ ব্যবস্থা তৈরি করতে সাহায্য করবে (চিত্র: লিঙ্কডইন)।

বিশেষ করে, "উচ্চ-ঝুঁকিপূর্ণ এআই" এবং "উচ্চ-প্রভাবশালী এআই" (বহু সংখ্যক ব্যবহারকারীর সাথে একাধিক উদ্দেশ্যে ব্যবহৃত সিস্টেম) এর মধ্যে পার্থক্য করা পদ্ধতির একটি সূক্ষ্মতা প্রদর্শন করে।

এটি ইউরোপীয় ইউনিয়ন (ইইউ) কৃত্রিম বুদ্ধিমত্তা আইনের তুলনায় আরও প্রগতিশীল শ্রেণীবিভাগ, যা কেবল ঝুঁকির মাত্রাই নয় বরং প্রভাবের মাত্রা এবং সুযোগও বিবেচনা করে।

এই শ্রেণীবিভাগ একটি বহু-স্তরীয় তদারকি ব্যবস্থা তৈরি করতে সাহায্য করবে, যেখানে উচ্চ-ঝুঁকিপূর্ণ এবং উচ্চ-প্রভাবশালী এআই সিস্টেমের জন্য সচেতনতার শৃঙ্খল তদারকি বিশেষভাবে গুরুত্বপূর্ণ হবে।

এআই নজরদারির জন্য প্ল্যাটফর্ম

ভিয়েতনামের শিল্প ও ডিজিটাল প্রযুক্তি আইনের অন্যতম প্রধান এবং অগ্রণী বৈশিষ্ট্য হল স্বচ্ছতা এবং সনাক্তকরণ চিহ্নের প্রয়োজনীয়তা।

৪৪ নম্বর অনুচ্ছেদে বলা হয়েছে যে, যেসব এআই সিস্টেম সরাসরি মানুষের সাথে যোগাযোগ করে, তাদের ব্যবহারকারীদের অবশ্যই অবহিত করতে হবে যে তারা এআই সিস্টেমের সাথে যোগাযোগ করছে। একই সাথে, এআই দ্বারা তৈরি পণ্যগুলিতে অবশ্যই শনাক্তকরণ চিহ্ন থাকতে হবে।

CoT তদারকি বাস্তবায়নের ক্ষেত্রে এর গুরুত্বপূর্ণ প্রভাব রয়েছে। ব্যবহারকারীরা যখন জানেন যে তারা AI-এর সাথে যোগাযোগ করছেন, তখন তাদের সিদ্ধান্ত গ্রহণ প্রক্রিয়ার ব্যাখ্যা দাবি করার অধিকার রয়েছে, যা AI ডেভেলপারদের AI-এর চিন্তাভাবনা প্রক্রিয়া পর্যবেক্ষণ করার ক্ষমতা বজায় রাখার জন্য ইতিবাচক চাপ তৈরি করে।

বিশেষ করে, বিজ্ঞান ও প্রযুক্তি মন্ত্রণালয়কে "কৃত্রিম বুদ্ধিমত্তা দ্বারা তৈরি ডিজিটাল প্রযুক্তি পণ্যের তালিকা জারি করার" দায়িত্ব অর্পণ করা হয়েছে, যা সক্রিয় ব্যবস্থাপনার ইঙ্গিত দেয়।

এটি অন্যান্য অনেক দেশের থেকে একটি গুরুত্বপূর্ণ পার্থক্য, যেখানে AI নিয়মকানুন প্রায়শই আরও সাধারণ।

তদুপরি, "মানুষ বা যন্ত্রের স্বীকৃতির জন্য" একটি শনাক্তকারীর প্রয়োজন এমন একটি AI ইকোসিস্টেমের দৃষ্টিভঙ্গির প্রতিনিধিত্ব করে যা নিজেকে নিয়ন্ত্রণ করতে পারে - যা স্বয়ংক্রিয় চিন্তা শৃঙ্খল নজরদারির ধারণার সাথে পুরোপুরি খাপ খায়।

ব্যাপক ব্যবস্থাপনা মডেল

উপরোক্ত আইনের ৪৫ অনুচ্ছেদ একটি প্রগতিশীল ব্যবস্থাপনা দর্শন প্রদর্শন করে যখন এআই পণ্য জীবনচক্র অনুসারে ৩টি বিষয়ের গোষ্ঠীর দায়িত্ব স্পষ্টভাবে সংজ্ঞায়িত করে: বিষয়গুলি বিকাশকারী, বিষয়গুলি সরবরাহকারী এবং বিষয়গুলি যারা এআই সিস্টেম স্থাপন এবং ব্যবহার করে।

এটি একটি নিরবচ্ছিন্ন এন্ড-টু-এন্ড জবাবদিহিতা ব্যবস্থা তৈরি করে, যা নিশ্চিত করে যে এআই তদারকি কেবল একটি পক্ষের দায়িত্ব নয়।

উল্লেখযোগ্যভাবে, "উন্নয়ন" এবং "প্রদান" কৃত্রিম বুদ্ধিমত্তার মধ্যে একটি সূক্ষ্ম পার্থক্য রয়েছে; ডেভেলপাররা হলেন তারা যারা "গবেষণা এবং বিকাশ" করেন, অন্যদিকে সরবরাহকারীরা হলেন তারা যারা এটিকে একটি ব্র্যান্ড নামে বাজারে নিয়ে আসেন।

এর মানে হল, এমনকি যদি কোনও কোম্পানি কেবল একটি বিদ্যমান AI মডেলকে পুনরায় ব্র্যান্ড করে, তবুও তারা স্বচ্ছতা এবং ব্যাখ্যাযোগ্যতার জন্য দায়ী।

এখানে বিশেষভাবে আকর্ষণীয় বিষয় হল আইনটি প্রতিটি বিষয়ের জন্য কীভাবে আলাদা আলাদা দায়িত্ব বরাদ্দ করে।

ডেভেলপারকে অবশ্যই সমস্ত নীতি মেনে চলতে হবে, সরবরাহকারীকে সনাক্তকরণ এবং উচ্চ-ঝুঁকি ব্যবস্থাপনার জন্য অতিরিক্ত দায়িত্ব নিতে হবে এবং ব্যবহারকারীকে কিছু দায়িত্ব থেকে "অব্যাহতি" দেওয়া হবে তবে তবুও স্বচ্ছতা এবং ঝুঁকি নিয়ন্ত্রণ নিশ্চিত করতে হবে।

এই মডেলটি একটি "দায়িত্বের শৃঙ্খল" তৈরি করে যেখানে প্রতিটি লিঙ্কে AI চিন্তাভাবনা শৃঙ্খলের তত্ত্বাবধান বজায় রাখার জন্য একটি প্রণোদনা থাকে, কারণ সকলেই শেষ ব্যবহারকারীর কাছে দায়বদ্ধ।

নজরদারি ক্ষমতা বজায় রাখার চ্যালেঞ্জ

তবে, AI চিন্তাধারার শৃঙ্খল পর্যবেক্ষণের ক্ষমতা ভঙ্গুর এবং দুর্বল থাকতে পারে। নতুন AI স্থাপত্যগুলি অন্যান্য হুমকিও তৈরি করতে পারে।

অনেক গবেষক বিচ্ছিন্ন শব্দের পরিবর্তে অবিচ্ছিন্ন গাণিতিক স্থানে যুক্তির পদ্ধতি তৈরি করছেন, যা চিন্তাভাবনায় ভাষা ব্যবহারের প্রয়োজনীয়তা সম্পূর্ণরূপে দূর করতে পারে।

তদুপরি, কৃত্রিম বুদ্ধিমত্তা "ফিল্টার" হয়ে যেতে পারে - অর্থাৎ, এটি কেবল মানুষের ইতিবাচক চিন্তাভাবনাগুলিকে প্রশংসা করার জন্য দেখায়, যখন ইচ্ছাকৃতভাবে এর আসল উদ্দেশ্যগুলি গোপন করে।

এখানে বিপদ হল, একবার যখন একজন AI বুঝতে পারে যে তার উপর নজর রাখা হচ্ছে, তখন সে তার আসল চিন্তাভাবনা লুকিয়ে রাখতে শিখতে পারে।

এই প্রেক্ষাপটে, ভিয়েতনামী আইনের ৪১ অনুচ্ছেদের ১ নম্বর ধারার "একটি কৃত্রিম বুদ্ধিমত্তা ব্যবস্থার জীবনচক্র জুড়ে ঝুঁকি নিয়ন্ত্রণ" সংক্রান্ত বিধানটি বিশেষভাবে গুরুত্বপূর্ণ হয়ে ওঠে। এর জন্য কেবল স্থাপনের সময় নয়, একটি অবিচ্ছিন্ন পর্যবেক্ষণ ব্যবস্থা প্রয়োজন।

AI উন্নয়নের ভবিষ্যতের উপর প্রভাব

মানুষের উপকারের জন্য কৃত্রিম বুদ্ধিমত্তা (এআই) কীভাবে কাজ করে তা নিশ্চিত করার জন্য চিন্তার শৃঙ্খল পর্যবেক্ষণ একটি গুরুত্বপূর্ণ হাতিয়ার হয়ে উঠতে পারে।

যদি মডেলরা স্বাভাবিক ভাষায় যুক্তি প্রদর্শন করতে থাকে এবং সবচেয়ে গুরুতর ঝুঁকি তৈরি করে এমন আচরণগুলির জন্য যদি ব্যাপক যুক্তির প্রয়োজন হয়, তাহলে এই অনুশীলন গুরুতর অসদাচরণের নির্ভরযোগ্য সনাক্তকরণ সক্ষম করতে পারে।

ভিয়েতনামের জন্য, CoT পর্যবেক্ষণ কৌশল প্রয়োগ আইনের বিধানগুলি কার্যকরভাবে বাস্তবায়নে সহায়তা করবে।

উদাহরণস্বরূপ, ৪১ অনুচ্ছেদে "ব্যাখ্যাযোগ্যতা" প্রয়োজনীয়তা পূরণ করা সহজ হবে যদি AI এর চিন্তাভাবনা প্রক্রিয়াগুলি অ্যাক্সেসযোগ্য হয়। একইভাবে, "অ্যালগরিদম, কৃত্রিম বুদ্ধিমত্তা মডেলগুলির নিয়ন্ত্রণ" আরও সম্ভবপর হয়ে উঠবে।

ভিয়েতনামে AI চেইন মনিটরিং বাস্তবায়ন বেশ কিছু চ্যালেঞ্জের মুখোমুখি হবে। প্রথমত, মানব সম্পদের সমস্যা রয়েছে - পর্যবেক্ষণ ব্যবস্থা তৈরি এবং পরিচালনা করতে সক্ষম AI বিশেষজ্ঞের অভাব।

এর জন্য প্রশিক্ষণ এবং প্রতিভা আকর্ষণে প্রচুর বিনিয়োগের প্রয়োজন।

ভবিষ্যতের জন্য দিকনির্দেশনা

গবেষকরা নেতৃস্থানীয় এআই মডেল ডেভেলপারদেরকে কোন বিষয়গুলি CoT কে "পর্যবেক্ষণযোগ্য" করে তোলে এবং কোন বিষয়গুলি এআই মডেলগুলি কীভাবে কাজ করে সে সম্পর্কে স্বচ্ছতা বাড়াতে বা হ্রাস করতে পারে তা গবেষণা করার এবং শীঘ্রই উত্তরগুলি নিয়ে আসার আহ্বান জানিয়েছেন।

আজকের ক্রমবর্ধমান শক্তিশালী কৃত্রিম বুদ্ধিমত্তা ব্যবস্থার উপর নিয়ন্ত্রণ বজায় রাখার জন্য AI "চিন্তাভাবনা" পর্যবেক্ষণ করার সুযোগটি আমাদের শেষ সুযোগ হতে পারে।

ভিয়েতনামের জন্য, ডিজিটাল প্রযুক্তি শিল্প আইনের মাধ্যমে AI-এর উপর একটি বিস্তৃত আইনি কাঠামো থাকা একটি দুর্দান্ত সুবিধা। স্বচ্ছতা, অ্যালগরিদমিক নিয়ন্ত্রণ এবং ঝুঁকি শ্রেণীবিভাগ সংক্রান্ত নিয়ন্ত্রণগুলি AI শৃঙ্খল পর্যবেক্ষণ কৌশল প্রয়োগের জন্য একটি শক্ত আইনি ভিত্তি তৈরি করেছে।

অত্যাধুনিক আন্তর্জাতিক গবেষণা এবং একটি প্রগতিশীল দেশীয় আইনি কাঠামোর সমন্বয় ভিয়েতনামকে কেবল নিরাপদে কৃত্রিম বুদ্ধিমত্তা বিকাশে সহায়তা করবে না বরং এই অঞ্চলের অন্যান্য দেশের জন্য একটি মডেল হয়ে উঠবে।

এটি জাতীয় উন্নয়ন কৌশলে নির্ধারিত ভিয়েতনামকে "আঞ্চলিক ও বৈশ্বিক ডিজিটাল প্রযুক্তি কেন্দ্র" হিসেবে গড়ে তোলার লক্ষ্যের সাথে সঙ্গতিপূর্ণ।

বিদ্যমান আইনি ভিত্তির সাথে, ভিয়েতনামকে দ্রুত AI চিন্তাধারা পর্যবেক্ষণের জন্য গবেষণা এবং ব্যবহারিক প্রয়োগ স্থাপন করতে হবে। কেবলমাত্র এটি করার মাধ্যমেই আমরা নিশ্চিত করতে পারি যে AI ডিজিটাল প্রযুক্তি শিল্প আইনের চেতনা অনুসারে "মানব সমৃদ্ধি এবং সুখ" পরিবেশন করবে।

সূত্র: https://dantri.com.vn/cong-nghe/giam-sat-chuoi-tu-duy-cua-tri-tue-nhan-tao-20250731151403739.htm

![[ছবি] হ্যানয়ের শিক্ষার্থীরা উত্তেজিত এবং আনন্দের সাথে ২০২৫-২০২৬ নতুন স্কুল বছর শুরু করছে](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/5/ecc91eddd50a467aa7670463f7b142f5)

![[ছবি] "ডিজিটাল নাগরিকত্ব - ডিজিটাল স্কুল" এর উদ্বোধনী অনুষ্ঠান এবং সাইবারস্পেসে সভ্য আচরণের প্রতি অঙ্গীকার](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/5/222ec3b8892f443c9b26637ef2dd2b09)

![[ছবি] ঢোল বাজিয়ে নতুন স্কুল বছরের সূচনা করা হচ্ছে এক বিশেষ উপায়ে।](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/5/b34123487ad34079a9688f344dc19148)

মন্তব্য (0)