가짜 AI 이미지는 어떻게 작동하나요?

요즘 AI는 어디에나 있습니다. 전쟁 속에서도 말이죠. 올해 인공지능 애플리케이션은 엄청나게 발전해서 거의 누구나 AI 생성기를 사용하여 적어도 첫눈에 보기에는 사실적으로 보이는 이미지를 만들 수 있게 되었습니다.

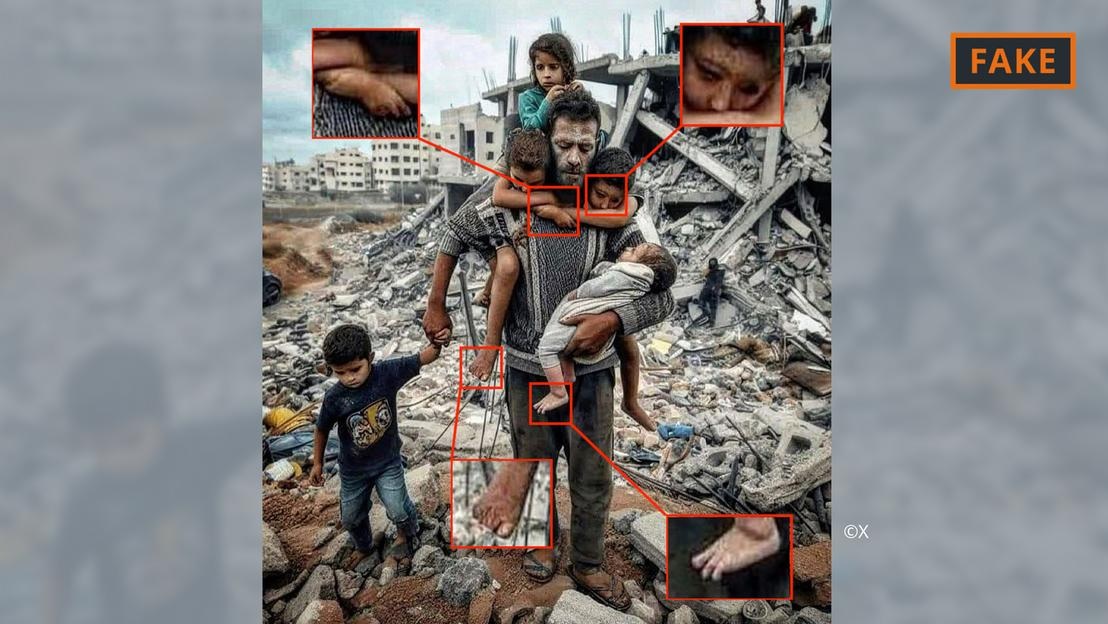

AI가 생성한 가자 전쟁의 가짜 사진.

사용자는 Midjourney나 Dall-E와 같은 도구에 사양과 정보를 포함한 몇 가지 프롬프트를 입력하기만 하면 됩니다. 그러면 AI 도구가 텍스트나 음성 프롬프트를 이미지로 변환합니다.

이 이미지 생성 과정은 머신러닝이라는 기술을 활용합니다. 예를 들어, 제작자가 70세 노인이 자전거를 타는 모습을 보여달라고 요청하면, 제작자는 데이터베이스에서 검색어와 이미지를 매칭합니다.

AI 알고리즘은 이용 가능한 정보를 기반으로 노인 자전거 운전자의 이미지를 생성합니다. 점점 더 많은 입력과 기술 업데이트를 통해 이러한 도구는 크게 개선되었으며 끊임없이 학습하고 있습니다.

이 모든 것이 중동 분쟁 관련 이미지에 적용되고 있습니다. AI 전문가 하니 파리드는 "감정이 매우 격앙된" 분쟁에서 AI 이미지를 통한 허위 정보 확산을 포함한 잘못된 정보는 막대한 영향을 미친다고 말합니다.

캘리포니아 대학교 버클리 캠퍼스의 디지털 분석학 교수인 파리드는 치열한 싸움이 가짜 콘텐츠를 만들고 유포하며 감정을 조장하는 완벽한 온상이라고 말했습니다.

이스라엘-하마스 전쟁의 AI 이미지

인공지능의 도움으로 만들어진 이미지와 영상은 우크라이나 내전과 관련된 허위 정보를 부추겼고, 이스라엘-하마스 전쟁에서도 그런 일이 계속 일어나고 있습니다.

전문가들에 따르면, 소셜 미디어에 유포되는 전쟁 관련 AI 이미지는 대체로 두 가지 유형으로 나뉜다. 하나는 인간의 고통에 초점을 맞추고 공감을 불러일으키는 이미지이고, 다른 하나는 사건을 과장하여 갈등을 조장하고 폭력을 심화시키는 가짜 AI 이미지이다.

가자지구의 잔해 속에 있는 아버지와 아이의 가짜 사진을 AI가 생성했습니다.

예를 들어, 첫 번째 카테고리에는 잔해 더미 앞에 선 아버지와 다섯 자녀의 사진이 포함됩니다. 이 사진은 X(구 트위터)와 인스타그램에 여러 번 공유되었고, 수십만 번 조회되었습니다.

이 이미지는 적어도 X 커뮤니티에서 가짜로 신고되었습니다. AI 이미지에서 흔히 볼 수 있는 다양한 오류와 불일치를 통해 이 이미지를 식별할 수 있습니다(위 이미지 참조).

비슷한 변칙성은 아래 X에서 바이러스처럼 퍼진 가짜 AI 이미지에서도 볼 수 있는데, 이 이미지에는 팔레스타인 가족이 폐허에서 함께 식사를 하는 모습이 나와 있습니다.

AI가 생성한 팔레스타인 정당의 가짜 사진.

한편, 폭격으로 파괴된 주택이 가득한 정착촌을 행진하면서 이스라엘 국기를 흔드는 군인들을 보여주는 또 다른 이미지는 증오와 폭력을 조장하기 위해 고안된 두 번째 범주에 속합니다.

이런 AI 이미지는 어디서 나오는 걸까?

AI가 생성한 갈등 이미지는 대부분 소셜 미디어 플랫폼에 게시되지만, 다른 여러 플랫폼과 조직, 심지어 일부 뉴스 사이트에서도 볼 수 있습니다.

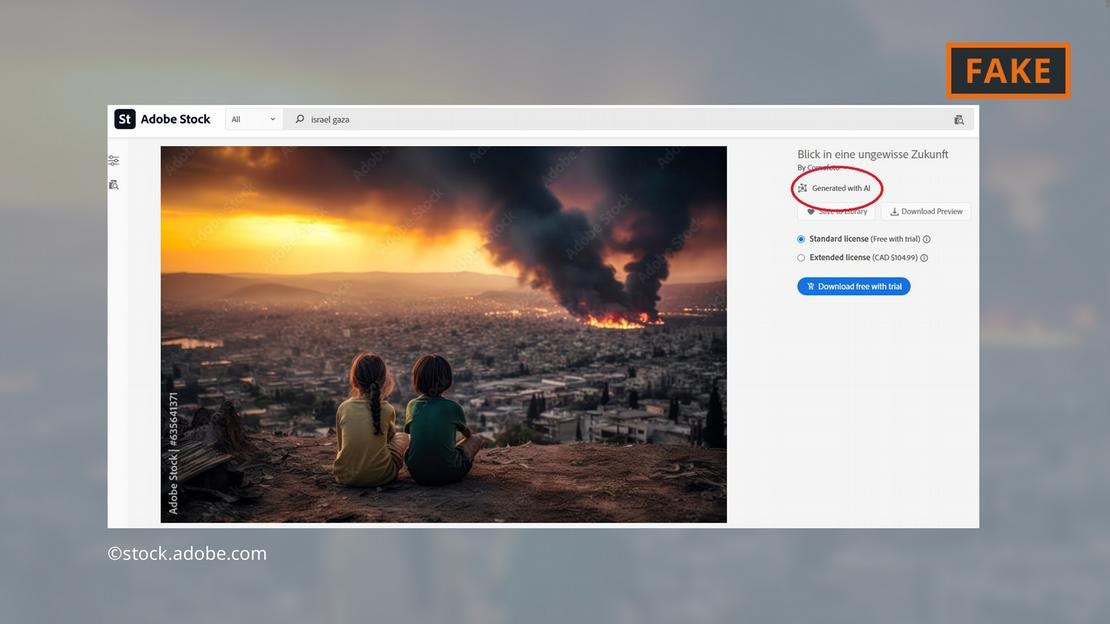

소프트웨어 회사인 어도비는 2022년 말까지 자사 스톡 사진 제품군에 AI가 생성한 이미지를 추가하여 큰 화제를 모았습니다. 데이터베이스에는 이에 따라 레이블이 지정되어 있습니다.

Adobe는 중동 전쟁의 AI 이미지를 판매하기 시작했습니다. 폭발, 시위하는 사람들, 알-아크사 모스크 뒤편에서 피어오르는 연기 등이 그 예입니다.

어도비는 가자지구 전투의 AI 생성 이미지를 제공하고 있습니다.

일부 사이트들이 AI 생성 이미지라는 표시 없이 이미지를 계속 사용하고 있어 비평가들은 이를 우려하고 있습니다. 예를 들어, "뉴스브레이크" 페이지에 게재된 이미지는 AI 생성 이미지라는 표시 없이 게재되었습니다.

유럽 의회의 과학 부서인 유럽 의회 조사국조차 중동 갈등에 대한 온라인 문서에 Adobe 데이터베이스의 AI 이미지를 사용했는데, 그 이미지가 AI가 생성한 것이라는 라벨은 붙이지 않았습니다.

유럽 디지털 미디어 감시기구(EDMO)는 언론인과 미디어 전문가들에게 AI 이미지를 사용할 때 매우 조심하고, 특히 가자 전쟁과 같은 실제 사건을 다룰 때는 사용하지 말 것을 권고했습니다.

AI 이미지는 얼마나 위험한가?

바이러스성 AI 콘텐츠와 이미지는 사용자들이 온라인에서 접하는 모든 것에 불안감을 느끼게 할 수밖에 없습니다. UC 버클리 연구원 파리드는 "이미지, 오디오, 비디오가 조작될 수 있는 세상이 온다면 모든 것이 의심스러워집니다."라고 설명합니다. "그러면 진실을 포함한 모든 것에 대한 신뢰를 잃게 됩니다."

다음 사례에서 정확히 그런 일이 일어났습니다. 이스라엘 아기의 탄 시체로 알려진 사진이 이스라엘 총리 베냐민 네타냐후와 다른 여러 정치인들에 의해 소셜 미디어에 공유되었습니다.

반이스라엘 인플루언서 잭슨 힝클은 이후 해당 이미지가 인공지능을 사용하여 만들어졌다고 주장했습니다. 힝클의 주장은 소셜 미디어에서 2천만 회 이상 조회되었고, 플랫폼 내에서 격렬한 논쟁을 불러일으켰습니다.

결국 많은 기관과 검증 도구들이 해당 이미지가 진짜이고 힝클의 주장은 거짓이라고 선언했습니다. 하지만 어떤 도구도 사용자가 잃어버린 신뢰를 쉽게 되찾는 데 도움을 줄 수 없다는 것은 분명합니다!

황하이 (DW에 따르면)

[광고_2]

원천

![[사진] 팜민친 총리가 정부당 상무위원회 회의를 주재하고 있다](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/23/8e94aa3d26424d1ab1528c3e4bbacc45)

![[사진] 토람 사무총장, 문화계 전통의 날 80주년 기념 행사 참석](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/23/7a88e6b58502490aa153adf8f0eec2b2)

댓글 (0)