|

Anthropic ទើបតែបានធ្វើបច្ចុប្បន្នភាពគោលនយោបាយថ្មីរបស់ខ្លួន។ រូបថត៖ GK Images ។ |

នៅថ្ងៃទី 28 ខែសីហា ក្រុមហ៊ុន AI Anthropic បានប្រកាសអំពីបច្ចុប្បន្នភាពចំពោះលក្ខខណ្ឌប្រើប្រាស់ និងគោលការណ៍ឯកជនភាពរបស់ខ្លួន។ ឥឡូវនេះ អ្នកប្រើប្រាស់អាចជ្រើសរើសយកទិន្នន័យរបស់ពួកគេ ដើម្បីកែលម្អ Claude និងពង្រឹងការការពារប្រឆាំងនឹងការរំលោភបំពានដូចជាការបោកប្រាស់ និងការក្លែងបន្លំជាដើម។

ការជូនដំណឹងនេះនឹងត្រូវបានផ្សព្វផ្សាយទៅកាន់ chatbot ចាប់ពីថ្ងៃទី 28 ខែសីហា។ អ្នកប្រើប្រាស់មានពេលមួយខែដើម្បីទទួលយក ឬបដិសេធលក្ខខណ្ឌ។ គោលនយោបាយថ្មីនឹងចូលជាធរមានភ្លាមៗនៅពេលទទួលយក។ បន្ទាប់ពីថ្ងៃទី 28 ខែកញ្ញា អ្នកប្រើប្រាស់នឹងត្រូវបានតម្រូវឱ្យជ្រើសរើសដើម្បីបន្តប្រើប្រាស់ Claude ។

ការអាប់ដេតនេះគឺមានគោលបំណងជួយផ្តល់នូវម៉ូដែល AI ដែលមានថាមពល និងមានប្រយោជន៍បន្ថែមទៀត នេះបើយោងតាមក្រុមហ៊ុន។ ការកែតម្រូវជម្រើសនេះគឺសាមញ្ញ ហើយអាចធ្វើបានគ្រប់ពេលនៅក្នុងការកំណត់ឯកជនភាព។

ការផ្លាស់ប្តូរទាំងនេះកំពុងត្រូវបានធ្វើឡើងចំពោះផែនការ Claude Free, Pro និង Max ដែលរួមមាន Claude Code ឧបករណ៍សរសេរកម្មវិធីរបស់ Anthropic ។ សេវាកម្មដែលគ្របដណ្តប់ដោយលក្ខខណ្ឌពាណិជ្ជកម្មនឹងមិនអនុវត្ត រួមទាំង Claude for Work, Claude Gov, Claude for Education ឬការប្រើប្រាស់ APIs រួមទាំងតាមរយៈភាគីទីបីដូចជា Amazon Bedrock និង Vertex AI របស់ Google Cloud ជាដើម។

តាមរយៈការចូលរួម Anthropic បាននិយាយនៅក្នុងការបង្ហោះប្លុករបស់ខ្លួន អ្នកប្រើប្រាស់នឹងជួយកែលម្អសុវត្ថិភាពរបស់ម៉ូដែលនេះ បង្កើនសមត្ថភាពរបស់វាក្នុងការស្វែងរកមាតិកាដែលបង្កគ្រោះថ្នាក់បានត្រឹមត្រូវ និងកាត់បន្ថយហានិភ័យនៃការដាក់ស្លាកការសន្ទនាដែលមិនបង្កគ្រោះថ្នាក់ដោយច្រឡំ។ កំណែនាពេលអនាគតរបស់ Claude ក៏នឹងត្រូវបានពង្រឹងជាមួយនឹងជំនាញដូចជាការសរសេរកម្មវិធី ការវិភាគ និងហេតុផលផងដែរ។

វាមានសារៈសំខាន់ដែលអ្នកប្រើប្រាស់មានការគ្រប់គ្រងពេញលេញលើទិន្នន័យរបស់ពួកគេ ហើយថាតើពួកគេអនុញ្ញាតឱ្យវេទិកាប្រើប្រាស់វានៅក្នុងបង្អួចដែលលេចឡើងឬអត់។ គណនីថ្មីអាចកំណត់វាជាជម្រើសក្នុងអំឡុងពេលដំណើរការចុះឈ្មោះ។

|

បង្អួចលេចឡើងលក្ខខណ្ឌថ្មីនៅក្នុង chatbot ។ រូបថត៖ Anthropic ។ |

រយៈពេលរក្សាទុកទិន្នន័យត្រូវបានកើនឡើងដល់ប្រាំឆ្នាំ ដែលអនុវត្តចំពោះការសន្ទនាថ្មី ឬបន្ត ឬវគ្គសរសេរកូដ ក៏ដូចជាការឆ្លើយតបទៅនឹងការឆ្លើយតបរបស់ chatbot ។ ទិន្នន័យដែលបានលុបនឹងមិនត្រូវបានប្រើដើម្បីបណ្តុះបណ្តាលគំរូនាពេលអនាគតទេ។ ប្រសិនបើអ្នកប្រើប្រាស់មិនជ្រើសរើសក្នុងការផ្តល់ទិន្នន័យសម្រាប់ការបណ្តុះបណ្តាលទេ ពួកគេនឹងបន្តជាមួយនឹងគោលការណ៍រក្សារយៈពេល 30 ថ្ងៃបច្ចុប្បន្ន។

ដោយពន្យល់ពីគោលការណ៍នេះ Anthropic បាននិយាយថា វដ្តនៃការអភិវឌ្ឍន៍ AI ជាធម្មតាមានរយៈពេលរាប់ឆ្នាំ ហើយការរក្សាទិន្នន័យឱ្យមានភាពស៊ីសង្វាក់គ្នាពេញមួយដំណើរការបណ្តុះបណ្តាលក៏ជួយឱ្យម៉ូដែលមានភាពស៊ីសង្វាក់គ្នាផងដែរ។ ការរក្សាទុកទិន្នន័យយូរជាងនេះក៏ធ្វើអោយប្រសើរឡើងនូវអ្នកចាត់ថ្នាក់ ប្រព័ន្ធដែលប្រើដើម្បីកំណត់អត្តសញ្ញាណអាកប្បកិរិយាបំពាន ដើម្បីរកមើលគំរូដែលបង្កគ្រោះថ្នាក់។

ក្រុមហ៊ុនបានសរសេរថា "ដើម្បីការពារភាពឯកជនរបស់អ្នកប្រើប្រាស់ យើងប្រើការរួមបញ្ចូលគ្នានៃឧបករណ៍ស្វ័យប្រវត្តិ និងដំណើរការដើម្បីត្រង ឬបិទបាំងទិន្នន័យរសើប។ យើងមិនលក់ទិន្នន័យអ្នកប្រើប្រាស់ទៅឱ្យភាគីទីបីទេ" ។

Anthropic ជារឿយៗត្រូវបានលើកឡើងថាជាអ្នកដឹកនាំម្នាក់នៅក្នុង AI សុវត្ថិភាព។ Anthropic បានបង្កើតវិធីសាស្រ្តមួយហៅថា AI រដ្ឋធម្មនុញ្ញ ដែលកំណត់គោលការណ៍សីលធម៌ និងគោលការណ៍ណែនាំដែលគំរូត្រូវតែអនុវត្តតាម។ Anthropic ក៏ជាក្រុមហ៊ុនមួយក្នុងចំណោមក្រុមហ៊ុនដែលបានចុះហត្ថលេខាលើកិច្ចសន្យាសុវត្ថិភាព AI ជាមួយ រដ្ឋាភិបាល សហរដ្ឋអាមេរិក ចក្រភពអង់គ្លេស និង G7។

ប្រភព៖ https://znews.vn/cong-ty-ai-ra-han-cuoi-cho-nguoi-dung-post1580997.html

![[រូបថត] ប្រធានរដ្ឋ Luong Cuong ទទួលជួបប្រធានសភា New Zealand លោក Gerry Brownlee](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/29/7accfe1f5d85485da58b0a61d35dc10f)

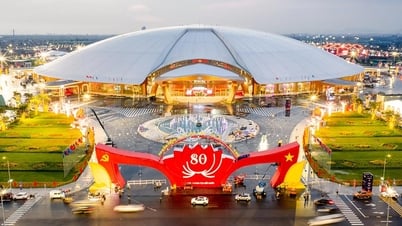

![[រូបថត] ទីក្រុងហាណូយបានត្រៀមខ្លួនជាស្រេចដើម្បីបម្រើដល់ឱកាសនៃការប្រារព្ធទិវាជាតិលើកទី 80 នៅថ្ងៃទី 2 ខែកញ្ញា។](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/29/c838ac82931a4ab9ba58119b5e2c5ffe)

Kommentar (0)