साइबर हमलों और धोखाधड़ी को अंजाम देने के लिए हैकर्स द्वारा एआई को "हथियार" बनाने की प्रवृत्ति के बारे में आप क्या सोचते हैं?

डॉ. गुयेन तुआन खांग: आईबीएम के 2024 एक्स-फोर्स थ्रेट इंटेलिजेंस इंडेक्स के अनुसार, वियतनाम सहित एशिया- प्रशांत वह क्षेत्र है जो 2023 में दुनिया में सबसे अधिक साइबर हमलों का शिकार होगा। इनमें से विनिर्माण उद्योग साइबर हमलों से सबसे अधिक प्रभावित उद्योग है।

बदमाशों का मुख्य तरीका अभी भी फ़िशिंग हमले हैं जो कमज़ोर लोगों को निशाना बनाते हैं और मैलवेयर इंस्टॉल करने के लिए कमज़ोरियों का फायदा उठाते हैं। इसके अलावा, 2024 में उभरता हुआ चलन कृत्रिम बुद्धिमत्ता (एआई) से जुड़े साइबर हमले हैं।

वायर्ड की रिपोर्ट बताती है कि कई बुरे लोग हैकिंग में मदद करने, धोखाधड़ी वाले चैटबॉट बनाने या डीपफेक का उपयोग करके अन्य लोगों के चेहरे और आवाज की नकली तस्वीरें और वीडियो बनाने के लिए जनरेटिव एआई का उपयोग कर रहे हैं।

हालाँकि, इस प्रवृत्ति के साथ-साथ, सूचना सुरक्षा प्रणालियाँ भी वाटसनएक्स जैसी एआई सुविधाओं को एकीकृत करना शुरू कर रही हैं। कृत्रिम बुद्धिमत्ता का दोहन किया जा सकता है, लेकिन यह विश्लेषण, निगरानी, संख्याओं की पहचान, हमले के परिदृश्यों की भविष्यवाणी करने में मनुष्यों की जगह भी ले सकती है, जिससे रक्षा क्षमताओं में सुधार होता है और सूचना सुरक्षा जोखिमों को कम किया जा सकता है।

डीपफेक घोटाले ज़्यादा आम होते जा रहे हैं। एआई के तेज़ी से विकास के साथ, भविष्य में ये हमले कितने ख़तरनाक होंगे?

डॉ. गुयेन तुआन खांग: मूलतः, डीपफेक एक ऐसी तकनीक है जो हैकर्स को नकली डिजिटल पहचान बनाने में मदद करती है, जिससे वे दूसरों की नकल कर सकते हैं। डीपफेक एक खतरनाक समस्या होगी क्योंकि यह तकनीक दिन-प्रतिदिन और अधिक परिष्कृत होती जा रही है।

डीपफेक से निपटने के लिए, सबसे पहले यह पता लगाना ज़रूरी है कि किसी व्यक्ति की तस्वीर या आवाज़ एआई द्वारा जनित है या नहीं। फ़िलहाल ऐसा कोई सार्वभौमिक उपकरण नहीं है जो डीपफेक का तुरंत पता लगा सके क्योंकि हमलावर लगातार नए मॉडल विकसित कर रहे हैं।

डीपफेक का पता लगाने के अलावा, इससे निपटने के लिए एक और तकनीक है, जो व्यवहार विश्लेषण के लिए तकनीक का उपयोग करती है। संगठनात्मक और व्यावसायिक दृष्टिकोण से, एक ऐसी प्रणाली विकसित करना आवश्यक है जो इन दोनों तकनीकों को एक साथ ला सके।

हाल के दिनों में, ऐसे साइबर हमले हुए हैं जिनमें हैकर्स ने कंपनी के सिस्टम में गुप्त रूप से मैलवेयर डाल दिया है। यह मैलवेयर घात लगाकर सभी गतिविधियों का विश्लेषण करता है, जिससे दुर्भावनापूर्ण इरादों को अंजाम देने के लिए एक नकली पहचान बन जाती है। डीपफेक तकनीक के विकास और एआई द्वारा वीडियो बनाने की क्षमता के साथ, भविष्य में इस प्रकार के हमले और भी खतरनाक हो जाएँगे।

डीपफेक साइबर हमलों में वृद्धि के साथ, हम बुजुर्गों, बच्चों और अन्य कमजोर समूहों को स्कैमर्स से कैसे बचा सकते हैं?

डॉ. गुयेन तुआन खांग: सोशल इंजीनियरिंग नामक तकनीक का इस्तेमाल करके स्कैमर्स अक्सर बुज़ुर्गों और बच्चों पर हमला करते हैं। यह शब्द मानव व्यवहार में हेरफेर करके किए गए हमलों को दर्शाता है।

हैकर अब डेटा संग्रह, माइनिंग और विश्लेषण के साथ एआई का इस्तेमाल करके उन लोगों की पहचान कर सकते हैं जिनके साथ धोखाधड़ी होने की संभावना है और फिर उन पर हमला करने के तरीके खोज सकते हैं। समुदाय में जागरूकता बढ़ाने के अलावा, हमें यह भी स्वीकार करना होगा कि उपयोगकर्ताओं के साथ धोखाधड़ी की स्थितियाँ उत्पन्न होंगी, और हमें इसका पता लगाने और इसे रोकने के लिए तकनीक का इस्तेमाल करना होगा।

हाल ही में एक ऐसा मामला सामने आया जहाँ एक बैंक कर्मचारी को पैसे ट्रांसफर करने आई एक बुज़ुर्ग महिला पर शक हुआ कि उसके साथ धोखाधड़ी हो रही है। इस व्यक्ति ने तुरंत लेन-देन रोक दिया और अधिकारियों को इसकी सूचना दी। बैंकों के आईटी सिस्टम में अब ऐसी तकनीक आ गई है जो ऐसे कामों में इंसानों की जगह ले सकती है।

तकनीक की भूमिका यह है कि भले ही भेजने वाला असली व्यक्ति ही हो, फिर भी अगर किसी और के द्वारा हेरफेर किए जाने का संदेह हो, तो सिस्टम इस व्यवहार को रोक देगा। ऐसे उपकरणों को धोखाधड़ी और जालसाजी शमन प्रणालियाँ कहा जाता है।

क्या अब समय आ गया है कि वियतनाम पर एआई के प्रबंधन के लिए प्रतिबंध लगाए जाएं, तथा एआई अनुसंधान, विकास और उपयोग को एक ढांचे में रखा जाए?

डॉ. गुयेन तुआन खांग: एआई प्रबंधन पर प्रतिबंधों का ज़िक्र तो लंबे समय से होता रहा है, लेकिन फिर भी कई विवाद हैं। उदाहरण के लिए, मेरे इलाके की पार्किंग में लाइसेंस प्लेट पहचानने वाला एआई सिस्टम लगा है, फिर भी चोरी की घटनाएँ हो रही हैं। उस समय, इस बात पर विवाद शुरू हुआ कि गलती किसकी थी। क्या अपार्टमेंट मालिक, सुरक्षा गार्ड या एआई सिस्टम विकसित करने वाली इकाई ज़िम्मेदार होनी चाहिए?

तब से, इमारत ने अपने नियम बदल दिए हैं, और कहा है कि निवासी सुविधानुसार लाइसेंस प्लेट पहचानने के लिए एआई का इस्तेमाल कर सकते हैं, लेकिन उन्हें जोखिम भी उठाना होगा। जो लोग सहमत होंगे, वे स्वचालित दरवाजों का इस्तेमाल कर पाएँगे, और जो सहमत नहीं होंगे, उन्हें अपनी गाड़ियाँ पुराने तरीके से ही पार्क करनी होंगी। हमें ऐसे प्रतिबंध लगाने की ज़रूरत है।

इसी तरह, आईबीएम ने एक बार कैंसर की रोकथाम में मदद के लिए एक एआई सिस्टम विकसित किया था। जब सिस्टम दवा लिख देता है, लेकिन उसे लेने के बाद भी मरीज़ को बचाया नहीं जा सकता, तो क्या यह डॉक्टर की गलती है या एआई की?

मुझे लगता है कि एआई विनियमन विशिष्ट होना चाहिए, जिसमें स्पष्ट रूप से बताया जाए कि एआई अनुप्रयोगों के विकास में क्या किया जा सकता है और क्या नहीं। दुनिया को सुरक्षित बनाने के लिए, सबसे बुनियादी नियम जो हम कर सकते हैं, वह है बड़े धन हस्तांतरणों के लिए बायोमेट्रिक प्रमाणीकरण अनिवार्य करना। ऐसी स्थिति में, अपनी पहचान की जानकारी खोने वाले लोग पैसे खोने से पूरी तरह बच सकते हैं।

धन्यवाद महोदय।

[विज्ञापन_2]

स्रोत

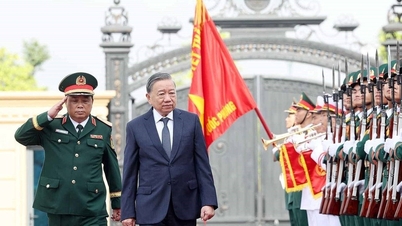

![[फोटो] महासचिव टो लैम रक्षा उद्योग के सामान्य विभाग की 80वीं वर्षगांठ में शामिल हुए](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/15/fb8fd98417bb4ec5962de4f7fbfe0f6a)

![[फोटो] राष्ट्रपति लुओंग कुओंग राष्ट्रीय रक्षा अकादमी में नए स्कूल वर्ष के उद्घाटन समारोह में शामिल हुए](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/15/c65f03c8c2984e60bd84e6e01affa8a0)

टिप्पणी (0)