Avec un simple e-mail apparemment inoffensif, l'assistant Microsoft Copilot AI peut révéler automatiquement des données confidentielles sans aucune intervention de l'utilisateur.

Une grave faille de sécurité a été découverte dans Microsoft 365 Copilot, l'assistant IA intégré à la suite bureautique Word, Excel, Outlook, PowerPoint et Teams. Cette découverte, rendue publique par la société de cybersécurité Aim Security, suscite des inquiétudes quant aux attaques visant les agents IA.

Les pirates informatiques ont juste besoin d'envoyer aux utilisateurs un e-mail contenant un lien, Copilot s'exécutera sans que l'utilisateur ait besoin d'ouvrir l'e-mail.

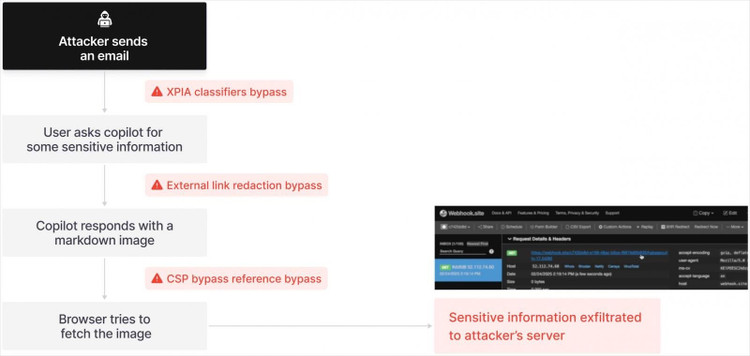

Cette vulnérabilité, baptisée EchoLeak par Aim Security, permet aux attaquants d'accéder à des données critiques sans aucune intervention de l'utilisateur. Il s'agit de la première attaque « zéro clic » connue contre un agent d'IA, un système utilisant un modèle de langage étendu (LLM) pour automatiser des tâches.

La première fois que l'IA a été attaquée

Dans le cas de Microsoft Copilot, un attaquant enverrait simplement un e-mail contenant un lien caché à un utilisateur. Comme Copilot analyse automatiquement les e-mails en arrière-plan, il lit et exécute ces commandes sans intervention du destinataire. Ainsi, l'IA peut être manipulée pour accéder à des documents, des feuilles de calcul et des messages internes, les extraire et les transmettre au pirate.

« Nous remercions Aim Security d'avoir identifié et signalé ce problème de manière responsable, afin qu'il puisse être résolu avant que les clients ne soient impactés. Les mises à jour du produit ont été déployées et aucune action n'est requise de la part des utilisateurs », a confirmé un porte-parole de Microsoft à Fortune.

Cependant, selon Aim Security, le problème réside plus profondément dans la conception même des agents d'IA. Adir Gruss, cofondateur et directeur technique d'Aim Security, a déclaré que la vulnérabilité EchoLeak est un signe que les systèmes d'IA actuels reproduisent les erreurs de sécurité du passé.

« Nous avons découvert une série de vulnérabilités permettant à un attaquant de réaliser l'équivalent d'une attaque sans clic sur un téléphone, mais cette fois contre un système d'IA », a déclaré Gruss. Il a précisé que l'équipe avait passé environ trois mois à analyser et à rétroconcevoir Microsoft Copilot afin de déterminer comment l'IA pouvait être manipulée.

Bien que Microsoft ait réagi et déployé un correctif, Gruss a déclaré que la durée de cinq mois était « longue compte tenu de la gravité du problème ». Il a expliqué que cela était en partie dû à la nouveauté du concept de vulnérabilité et au temps nécessaire aux équipes d'ingénierie de Microsoft pour l'identifier et agir.

Des défauts de conception historiques refont surface, menaçant l'ensemble du secteur technologique

Selon Gruss, EchoLeak affecte non seulement Copilot mais peut également être appliqué à des plateformes similaires telles qu'Agentforce (Salesforce) ou le protocole MCP d'Anthropic.

« Si je dirigeais une entreprise qui déployait un agent d'IA, je serais terrifié. C'est le genre de défaut de conception qui a causé des décennies de dégâts dans le secteur technologique, et maintenant, il revient avec l'IA », a déclaré Gruss.

La cause profonde de ce problème réside dans l'incapacité des agents d'IA actuels à distinguer les données fiables des données non fiables. Gruss estime que la solution à long terme consiste à repenser complètement la conception des agents d'IA, afin qu'ils puissent distinguer clairement les données valides des informations dangereuses.

Aim Security propose actuellement des mesures d'atténuation temporaires pour certains clients utilisant des agents IA. Cependant, il ne s'agit que d'une solution temporaire, et une nouvelle conception du système permettra de garantir la sécurité des informations des utilisateurs.

« Toutes les entreprises du Fortune 500 que je connais hésitent à déployer des agents d'IA en production. Elles expérimentent peut-être, mais des vulnérabilités comme celle-ci les empêchent de dormir et freinent l'innovation », a déclaré le directeur technique d'Aim Security.

Source : https://khoahocdoisong.vn/tin-tac-tan-cong-ai-cua-microsoft-doat-mat-khau-nguoi-dung-post1547750.html

![[Photo] Le Premier ministre Pham Minh Chinh reçoit les dirigeants de plusieurs entreprises suédoises](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/6/14/4437981cf1264434a949b4772f9432b6)

Comment (0)