Falešné zprávy se stávají sofistikovanějšími díky manipulaci s umělou inteligencí

Na nedávném setkání Vietnamské asociace novinářů a Thajské asociace novinářů v Hanoji se představitelé obou asociací věnovali převážně problému „falešných zpráv“ a prohlásili, že se již nejedná o národní problém, ale o závažný problém s nepředvídatelnými dopady na region i svět.

Podle výzkumu společnosti Google DeepMind je vytváření obrázků, videí a zvukových nahrávek, které napodobují lidi, téměř dvakrát častější než vytváření dezinformací pomocí nástrojů, jako jsou chatboti s umělou inteligencí.

V posledních měsících se na TikToku, X a Instagramu objevily deepfakey britského premiéra Rishiho Sunaka a dalších světových lídrů, což vyvolává obavy, že i přes snahu sociálních sítí označit nebo odstranit obsah si diváci nemusí uvědomit, že je falešný, a že jeho šíření by mohlo ovlivnit voliče.

Před parlamentními volbami se na TikToku a Instagramu objevily falešné umělecké díla britského premiéra Rishiho Sunaka. (Foto: AFP)

Při hodnocení dopadu falešných zpráv v technologické éře uvedl MSc. Luong Dong Son, přednášející na Institutu žurnalistiky a komunikace Akademie žurnalistiky a propagandy, že produkt kombinace umělé inteligence a dezinformací, známý také jako surrealistické falešné zprávy, může zkreslovat vnímání událostí a společenských problémů veřejností, a tím ovlivňovat způsob, jakým posuzují situaci a činí rozhodnutí. To může mít vážné důsledky, od malých osobních rozhodnutí až po důležitá rozhodnutí ovlivňující komunitu a zemi.

Hyperfalešné zprávy mohou být použity jako nástroj k manipulaci s veřejným míněním, podněcování k násilí, šíření rozkolů a podkopávání sociální stability. V politické scéně mohou hyperfalešné zprávy narušit důvěru v demokratické instituce, ovlivnit výsledky voleb a dokonce i podněcovat konflikty.

Pokud jde o výzvy, kterým čelí novináři a zpravodajské organizace, MSc. Luong Dong Son uvedl, že sofistikovanost surrealistických falešných zpráv, zejména deepfake, stále více ztěžuje rozlišování mezi skutečnými a falešnými zprávami, a to i pro zkušené novináře.

„V době informační exploze veřejnost stále více požaduje, aby novináři a zpravodajské organizace poskytovali informace rychle a přesně. Tento tlak však může vést k tomu, že novináři ukvapeně zveřejňují informace, aniž by je pečlivě ověřili, což vytváří příležitosti k šíření surrealistických falešných zpráv. Novináři a zpravodajské organizace navíc čelí právním a etickým rizikům, pokud nejsou při ověřování a zveřejňování informací opatrní,“ uvedl pan Son.

Nechte si umělou inteligenci ověřit informace

Podle MSc. Luong Dong Sona je pro řešení tohoto typu falešných zpráv nesmírně důležité použití moderních technologických řešení.

„Tato řešení se nezaměřují pouze na detekci a eliminaci falešných zpráv, ale také na jejich prevenci již v raných fázích produkce,“ řekl MSc. Dong Son.

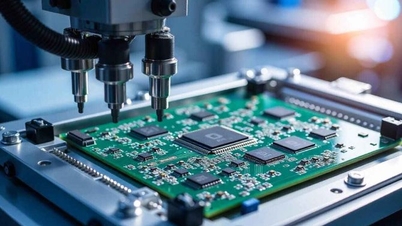

Zaprvé, jednou z nejdůležitějších technologií současnosti je podle pana Sona využití systémů umělé inteligence k detekci falešných zpráv. Moderní systémy umělé inteligence jsou schopny analyzovat kontext, porovnávat informace z více zdrojů a detekovat abnormality v informačním obsahu. Typickým příkladem je využití umělé inteligence k analýze videí a obrázků za účelem detekce známek střihu nebo produkce pomocí technologie deepfake.

Platformy sociálních médií a vyhledávače dále aktivně nasazují algoritmy strojového učení, které automaticky klasifikují a filtrují falešný zpravodajský obsah dříve, než se stane virálním. Tyto algoritmy jsou navrženy tak, aby rozpoznávaly anomálie ve vzorcích sdílení, rychlost jejich šíření nebo dokonce tón příspěvků, a tím posoudily pravděpodobnost, že je informace falešná.

Potenciálním řešením je také využití technologie blockchain ke správě původu informací. Blockchain dokáže vytvořit transparentní a neměnný systém ověřování, čímž pomáhá sledovat původ a historii všech informací a zajišťuje jejich přesnost a spolehlivost.

Umělá inteligence může vytvářet falešný obsah nebo zavádějící informace a obrázky, které je obtížné rozlišit, což způsobuje velké škody na pověsti jednotlivců i organizací a dokonce poškozuje národní a etnické zájmy.

Stejný názor sdílí s MSc. Luong Dong Sonem i pan Phan Van Tu - vedoucí katedry žurnalistiky na Fakultě žurnalistiky a komunikace Univerzity sociálních a humanitních věd v Ho Či Minově Městě - zdůraznil, že kromě poskytování dovedností pro využití silných stránek umělé inteligence v žurnalistice musíme také používat nástroje umělé inteligence k ověřování informací.

Ověřování zdrojů, což je v podstatě posouzení spolehlivosti zdroje, je důležitá dovednost, která zahrnuje ověření zdroje informací, jeho porovnání s jinými zdroji a používání nástrojů pro ověřování faktů k ověření spolehlivosti.

Je zajímavé, že nyní existuje mnoho nástrojů integrovaných s umělou inteligencí, které podporují novináře v procesu ověřování, a to kromě tradičních nástrojů, které podporují ověřovatele faktů, jako je Google Image, Tineye reverse image search, Whopostedwhat.com, Waybackmachine, Webarchive.org, InVID, WeVerify, ExifTool, Metapicz...

Pan Phan Van Tu uvedl, že vzdělávání novinářů v současném období vyžaduje zaměření na poskytování kapacit pro hodnocení informací proti útokům falešných zpráv manipulovaných umělou inteligencí. „Používání nástrojů umělé inteligence k řešení chyb souvisejících s umělou inteligencí je nejrychlejší způsob, jak pomoci novinářům a tiskovým agenturám nejen dobře plnit jejich roli, ale také přispět ke zlepšení kvality informací a ochraně veřejnosti před falešnými informacemi a negativními dopady médií,“ řekl pan Tu.

Pan Tu však také poukázal na to, že schopnost novinářů hodnotit informace se nemůže spoléhat pouze na nástroje. Je třeba hned říci, že umělá inteligence sice může podpořit analýzu zpravodajského obsahu, ale nedokáže odhalit všechny typy falešných zpráv a manipulovaných informací. Software umělé inteligence lze stále oklamat samotnými technikami umělé inteligence, které k jejich detekci používá.

„Žádný nástroj není kouzelná hůlka, ale nástroje umělé inteligence, které detekují falešné fotografie/videa, jsou stále cenným zdrojem jako součást ověřovacího procesu nebo metody due diligence,“ řekl Phan Van Tu.

Hoa Giang

Zdroj: https://www.congluan.vn/tin-gia-trong-thoi-ky-tri-tue-nhan-tao-dung-cac-cong-cu-ai-de-tri-cac-san-pham-loi-tu-ai-post308981.html

![[Foto] Kambodžské mezinárodní letiště Techo oficiálně otevřeno](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/9/330836bb28ad4ee4bdd512cc1a2d0849)

![[Foto] Generální tajemník To Lam předsedal pracovnímu zasedání politbyra se stálými výbory strany a ústředními stranickými agenturami.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/9/8343386e1e8f43c6a3c0543da7744901)

Komentář (0)